下面内容为《MySQL是怎样运行的 从根儿上理解MySQL》学习笔记。

说实话老实研究MySQL不如好好地把postgres使用搞透彻。

MySQL服务器程序的进程称为MySQL数据库实例(instance)

在安装MySQL时,无论用源码编译安装还是官方提供的安装包,无论采用哪种安装方式,一定要记住MySQL安装在哪里,一定要记住MySQL的安装目录。

[gaowanlu@vhost02 a5game_data]$ which mysql

/usr/bin/mysql

[gaowanlu@vhost02 a5game_data]$ which mysqld

/usr/sbin/mysqld

[gaowanlu@vhost02 a5game_data]$ ./bin/mysqld或者绝对路径

/usr/sbin/mysqld比如,环境变量PATH的值为 /usr/local/bin:/usr/bin:/bin:/usr/sbin:/sbin。 这个值表明,在我输入某个命令时,系统会在 /usr/local/bin、/usr/bin、/bin、/usr/sbin和/sbin目录下按照顺序依次寻找输入的这个命令.如果寻找成功,则执行该命令.

也可以修改这个环境变量PATH.把MySQL安装目录下的bin目录的绝对路径添加到PATH中.修改后的环境变量PATH的值为 /usr/local/bin:/usr/bin:/bin:/usr/sbin:/sbin:/usr/sbin/mysqld• 这样一来,无论命令行解释器的当前工作目录是啥,都可以直接输入可执行文件的名字来启动,比如下面这样.

mysqld在类UNIX系统,用来启动MYSQL服务器程序的可执行文件有很多,大部分都位于MYSQL安装目录的bin目录下。

mysqld可执行文件就表示MySQL服务器程序,运行这个可执行文件就可以直接启动一个MySQL服务器进程.但这个可执行文件并不常用。

mysqld_safe是一个启动脚本,它会间接调用my叫ld并持续监控服务器的运行状态.当服务器进程出现错误时,它还可以帮助重启服务器程序.另外,使用mysqld_safe启动MySQL服务器程序时,它会将服务器程序的出错信息和其他诊断信息输出到错误日志,以方便后期查找发生错误的原因.

[gaowanlu@vhost02 bin]$ ps -ef | grep mysqld

mysql 1595 1 0 Feb27 ? 00:00:00 /bin/sh /usr/bin/mysqld_safe --basedir=/usr

mysql 1760 1595 0 Feb27 ? 00:03:11 /usr/sbin/mysqld --basedir=/usr --datadir=/var/lib/mysql --plugin-dir=/usr/lib64/mysql/plugin --log-error=/var/log/mysqld.log --pid-file=/var/run/mysqld/mysqld.pid --socket=/var/lib/mysql/mysql.sock

gaowanlu 37846 17788 0 15:12 pts/5 00:00:00 grep --color=auto mysqld出错日志默认写到一个以.err为扩展名的文件中,该文件位于MySQL的数据目录中。

mysql.server也是一个启动脚本,它会间接调用mysqld_safe。有些安装了MySQL可能没有。

mysql.server start

mysql.server stop其实我们在一台计算机上也可以运行多个服务器实例,也就是运行多个MySQL服务器进程。mysqld_multi 可执行文件可以启动或停止多个服务器进程,也能报告它们的运行状态.

它提供了两种启动方法,手动启动和以服务的形式启动。

在Windows系统中安装完MySQL之后,MySQL安装目录的bin目录下也会存在mysqld可执行文件·在命令行解释器中输入mysqld,或者直接在bin目录下双击该文件,就可以启叨MySQL服务器程序了。

如果我们需要在计算机上长时间运行某个程序,并且无论是谁在使用这台计算机,程序的运行都不受影响,就可以把它注册为一个Windows服务,由操作系统帮我们管理。

"完整的可执行文件路径" --install [-manual] [服务名]如果我们添加了-manual边项,就表示在Windows系统启动的时候不自动启动该服务,否则会自动启动·

"C:\Program Files\MySQL\MySQL Server 5.7\bin\mysqld" --install

net start MySQL

net stop MySQL如果你喜欢图形界面,可以通过Windows的服务管理器并用鼠标点击的方式来启动和停止服务.

bin目录下有许多客户端程序,如mysqladmin、mysqldump、mysqlcheck等。主要关注mysql。

mysql -h主机名 -u用户 -p密码 -P端口连接成功后将会进入一个mysql终端输入以下任意一个命令可以退出连接

mysql> quit

mysql> exit

mysql> \q本质上是进程间的通信。

端口号是一个整数值,取值范围是0~65535,MySQL服务器在启动时会默认申请3306端口号,之后就在这个端口号上等待客户端进程进行连接。

指定监听其他端口

mysqld -P3307如果是Windows用户,本地客户端连接本地服务器,可以使用命名管道和共享内存。

如下面例子

#服务器

mysqld --socket=/tmp/a.txt

#客户端

mysqld -hlocalhost -u root --socket=/tmp/a.txt -p下面是客户端向服务器发送命令过程

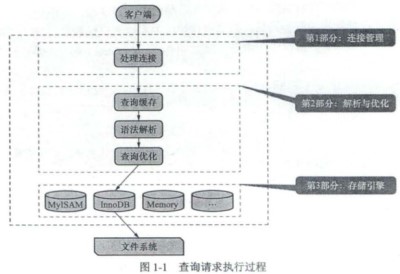

每当有一个客户端进程连接到服务器进程时,服务器进程都会创建一个线程专门处理与这个客户端的交互;当该客户端退出时会与服务器断开连接,服务器并不会立即把与该客户端交互的线程销毁,而是把它缓存起来,在另一个新的客户端再进行连接时,把这个缓存的线程分配给该新客户端.这样就不用频繁地创建和销毁线程,从而节省了开销.

在客户端程序发起连续时,需要携带主机信息、用户名、密码等信息,服务器程序会对客户端程序提供的这些信息进行认证.如果认证失败,服务辑程序会拒绝连接.另外,如果客户端程序和服务器程序不运行在一台计算机上,我们还可以通过采用传输层安全性(TransportLayer Security, TLS)协议对连接进行加密,从而保证数据传输的安全性。

MySQL服务器程序处理查询请求的过程也是这样,会把刚刚处理过的查询请求和结果缓存起来.如果下一次有同样的请求过来,直接从缓存中查找结果就好了,就不用再去底层的表中查找了.这个查询缓存可以在不同的客户端之间共享,也就是说,如果客户端A刚刚发送了一个查询请求,而客户端B之后发送了同样的查询请求,那么客户端B的这次查询就可以直接使用查询缓存中的数据了.

MySQL服务器并没有人那么聪明,如果两个查询请求有任何字符上的不同,例如空格、注释、大小写,都会导致缓存不会命中,如果查询请求中包含某些系统函数、用户自定义变量和函数、系统表,如mysql、information_schema、performance_schema数据库中的表,则这个请求不会被缓存。

不过既然是缓存,那就有缓存失效的时候.MySQL的缓存系统会监测涉及的每张衰,只要该袤的结构或者数据被修改,比如对该表使用了的INSERT、UPDATE、DELETE、TRUNCATE TABLE、ALTER TABLE、DROP TABLE或DROP DATABASE语句,则与该表有关的所有查询缓存都将变为无效并从查询缓存中删除!

从MySQL5.7.20开始,不才在荐使用查询缓存,在小贴士MySQL8.0中直接将其删除.

如果查询缓存没有命中,接下来就需要进入正式的查询阶段了.因为客户端程序发送过来的请求只是一段文本,所以MySQL服务器程序首先妥对这段文本进行分析,判断请求的语法是否正确,然后从文本中将要查询的表、各种查询条件都提取出来放到MySQL服务器内部使用的一些数据结构上.

从本质上来说,这个从指定的文本中提取出需妥的信息算是一个编译过程,涉及词曾习、法解析、语法分析、语义分析等阶段

在语法解析后,服务器程序获得到了需要的信息,比如要查询的表和列是哪些、搜索条件是什么等。这些并不够,因为我们写的MySQL语句执行起来效率可能并不是很高,MySQL的优化程序会对语句进行一些优化,如外连接转换为内连接、表达式简化、子查询转为连接等一堆东西。

MySQL服务器把数据的存储和提取操作都封装到了一个名为存储引擎的模块中.

表是由一行一行的记录组成的,但这只是一个逻辑上的概念.在物理上如何表示记录,怎么从表中读取数据,以及怎么把数据写入具体的物理存储器上,都是存储引擎负责的事情.为了实现不同的功能,MySQL提供了各式各样的存储引擎,不同存储引擎管理的表可能有不同的存储结构,采用的存取算法也可能不同.

MySQL服务器处理请求的过程简单地划分为server层和存储引擎层.连接管理、查询缓存、语法解析、查询优化这些并不涉及真实数据存取的功能划分为server层的功能,存取真实数据的功能划分为存储引擎层的功能.各种不同的存储引擎为server层提供统一的调用接口,其中包含了几十个不同用途的底层函数,比如”读取索引第一条记录1111读取索引下一条记录”“插入记录”等.

不同存储引擎对于某些功能支持情况也不相同。

InnoDB从MySQL5.5.5版本开始作为MySQL的默认存储引擎,之前版本的默认存储引擎为MyISAM.

mysql> SHOW ENGINES;

+--------------------+---------+----------------------------------------------------------------+--------------+------+------------+

| Engine | Support | Comment | Transactions | XA | Savepoints |

+--------------------+---------+----------------------------------------------------------------+--------------+------+------------+

| FEDERATED | NO | Federated MySQL storage engine | NULL | NULL | NULL |

| MRG_MYISAM | YES | Collection of identical MyISAM tables | NO | NO | NO |

| MyISAM | YES | MyISAM storage engine | NO | NO | NO |

| BLACKHOLE | YES | /dev/null storage engine (anything you write to it disappears) | NO | NO | NO |

| CSV | YES | CSV storage engine | NO | NO | NO |

| MEMORY | YES | Hash based, stored in memory, useful for temporary tables | NO | NO | NO |

| ARCHIVE | YES | Archive storage engine | NO | NO | NO |

| InnoDB | DEFAULT | Supports transactions, row-level locking, and foreign keys | YES | YES | YES |

| PERFORMANCE_SCHEMA | YES | Performance Schema | NO | NO | NO |

+--------------------+---------+----------------------------------------------------------------+--------------+------+------------+

9 rows in set (0.01 sec)Transactions 是否支持事务、XA 是否支持分布式事务、Savepoints 是否支持事务的部分回滚。

CREATE TABLE 表名(

建表语句;

) ENGINE = 存储引擎名称;ALTER TABLE 表名 ENGINE = 存储引擎名称;mysql设置选项一般都有各自的默认值,比如服务器允许同时连入的客户端的默认数量是151,表的默认存储引擎是InnoDB。 可以在程序启动的时候修改这些默认值,对于这种在程序启动时指定的设置项也称之为启动选项 startup option,启动选项一般也可以在配置文件中指定。

如在启动时就禁止各客户端使用TCP/IP网络进行通信,

mysqld --skip-networking指定存储引擎

mysqld --default-storage-engine-MyISAM不需要记忆,使用 –help查看即可

mysqld --help

mysqld_safe --help常用的长形式和短形式含义

--host -h 主机名

--user -u 用户名

--password -p 密码

--port -P 端口

--version -V 版本信息配置文件的路径

MySQL程序在启动时会在多个路径下寻找配置文件,这些路径有的是固定的,有的可以在命令行中指定。

类UNIX操作系统中的配置文件

/etc/my.cnf

/etc/mysql/my.cnf

SYSCONFDIR/my.cnf

$MYSQL_HOME/my.cnf 特定于服务器选项

default-extra-file 命令行指定的额外配置文件路径

~/.my.cnf 特定于用户的选项

~/.mylogin.cnf 特定于用户的登录路径选项配置文件内容,如下面这样

[server]

[具体的启动选项...]

[mysqld]

[具体的启动选项...]

[mysqld_safe]

[具体的启动选项...]

[client]

[具体的启动选项...]

[mysql]

[具体的启动选项...]

[mysqladmin]

[具体的启动选项...]程序的对应类别和能读取的组

mysqld [mysqld] [server]

mysqld_safe [mysqld] [server] [mysqld_safe]

mysql_server [mysqld] [server] [mysql.server]

mysql [mysql] [client]

mysqladmin [mysqladmin] [client]

mysqldump [mysqldump] [client]内容不是很重要

MySQL服务器程序在运行过程中会用到许多影响程序行为的变量,它们被称为系统变量。比如,允许同时连入的客户端数量用系统变盘max_connections表示;表的默认存储引擎用系统变量default_storage_engine表示,查询缓存的大小用系统变量query_ _cache_size表示MySQL服务器程序的系统变量有好几百个,这里不再一一列举.每个系统变量都看一个默认值,我们可以使用命令行或者配置文件中的选项在启动服务器时改变一些系统变量的值·大多数系统变量的值也可以在程序运行过程中修改,而无须停止并重新启动服务器.

SHOW VARIABLES;

mysql> SHOW VARIABLES LIKE 'default_storage_engine';

+------------------------+--------+

| Variable_name | Value |

+------------------------+--------+

| default_storage_engine | InnoDB |

+------------------------+--------+

1 row in set, 1 warning (0.00 sec)

mysql> SHOW VARIABLES LIKE 'max_connections';

+-----------------+-------+

| Variable_name | Value |

+-----------------+-------+

| max_connections | 151 |

+-----------------+-------+

1 row in set, 1 warning (0.00 sec)模糊查询

mysql> SHOW VARIABLES LIKE 'default%';

+-------------------------------+-----------------------+

| Variable_name | Value |

+-------------------------------+-----------------------+

| default_authentication_plugin | caching_sha2_password |

| default_collation_for_utf8mb4 | utf8mb4_0900_ai_ci |

| default_password_lifetime | 0 |

| default_storage_engine | InnoDB |

| default_table_encryption | OFF |

| default_tmp_storage_engine | InnoDB |

| default_week_format | 0 |

+-------------------------------+-----------------------+

7 rows in set, 1 warning (0.00 sec)设计MySQL的大叔提出了系统变量的作用范围的概念,具体来说,作用范围分为以下两种。

SET [GLOBAL|SESSION] 系统变量名 = 值

# 默认为SESSION范围的查看不同作用范围的系统变量

SHOW [GLOBAL|SESSION] VARIABLES [LIKE 匹配的模式]MySQL服务器程序中维护了许多关于程序运行状态的变量,它们被称为状态变量。

SHOW [GLOBAL|SESSION] STATUS [LIKE 匹配的模式]mysql> SHOW STATUS LIKE 'thread%' ;

+-------------------+-------+

| Variable_name | Value |

+-------------------+-------+

| Threads_cached | 0 |

| Threads_connected | 4 |

| Threads_created | 4 |

| Threads_running | 2 |

+-------------------+-------+

4 rows in set (0.00 sec)一般是以下情况直接比较二进制数据,如果不区分大小写的话,则

共收录128个字符,包括空格、标点符号、数字、大小写字母和-些不可见字符。由于ASCJJ字符集总共才128个字符,所以可以使用一个字节来进行编码.我们来看几个字符的编码方式:

'L' -> 01001100 (十六进制 0x4c 十进制76)

'M' -> 01001101 (十六进制 0x4D 十进制77)共收录256个字符,它在ASCIl字符集的基础上又扩充了128个西欧常用字符(包括德法两国的字母).ISO 8859-1字符集也可以使用一个字节来进行编码 这个字符集也有一个别名Latin1.

收录了汉字以及拉丁字母、希腊字母、日文平假名及片假名字母、俄i吾西里尔字母,收录汉字6763个,收录其他文字符号682个.这种字符集同时又兼容ASCJJ字符集,所以在编码方式上显得有些奇怪:如果该字符在ASCIl字符集中,则采用一字节编码:否则采用两字节编码. 这种使用不同字节数来表示一个字符的编码方式称为变长编码方式.

GBK字符集只是在收录的字符范围上对GB2312字符集进行了扩充,编码方式兼容GB2312字符集.

几乎收录了当今世界各个国家/地区使用的字符,而且还在不断扩充.这种字符集兼容ASCII字符集,采用变长编码方式,编码一个字符时需要使用1-4字节,比如下面这样:

'L' -> 01001100 (1宇节,十六进制0x4C)

'啊'-> 111001011001010110001010 (3宇节,十六进制0xE5958A)UTF-8只是Unicode字符集的一种编码方案,Unicode字符集可以采用UTF-8、UTF-16、UTF-32这几种编码方案。UTF-8使用1~4字节编码一个字符,UTF-16使用2 或4字节编码一个字符,UTF-32使用4字节编码一个字符。

对同一个字符,不同字符集可能采用不同的编码方式,对于汉字 ‘我’,ASCII字符集中没有这个字符,UTF-8和GB2312字符集对汉字 ’我’的编码方式不同

UTF-8 3字节,十六进制形式为 0xE68891

GB2312 2字节,十六进制形式为 0xCED2MySQL定义了下面两个概念。

在MySQL中,utf8是utf8mb3的别名,所以后文在MySQL中提到utf8时,就意味着使用1~3字节来表示一个字符。如果有使用4字节编码一个字符的情况,比如存储一些emoji表情,请使用uf8mb4。

在MySQL8.0中,设计MySQL的大叔已经很大程度地优化了utf8mb4字符集的性能,而且已经将其设置为默认的字符集。

查看当前MySQL中支持的字符集

SHOW (CHARACTER SET|CHARSET) [LIKE 匹配的模式]mysql> SHOW CHARSET;

+----------+---------------------------------+---------------------+--------+

| Charset | Description | Default collation | Maxlen |

+----------+---------------------------------+---------------------+--------+

| armscii8 | ARMSCII-8 Armenian | armscii8_general_ci | 1 |

| ascii | US ASCII | ascii_general_ci | 1 |

| big5 | Big5 Traditional Chinese | big5_chinese_ci | 2 |

| binary | Binary pseudo charset | binary | 1 |

| cp1250 | Windows Central European | cp1250_general_ci | 1 |

| cp1251 | Windows Cyrillic | cp1251_general_ci | 1 |

| cp1256 | Windows Arabic | cp1256_general_ci | 1 |

| cp1257 | Windows Baltic | cp1257_general_ci | 1 |

| cp850 | DOS West European | cp850_general_ci | 1 |

| cp852 | DOS Central European | cp852_general_ci | 1 |

| cp866 | DOS Russian | cp866_general_ci | 1 |

| cp932 | SJIS for Windows Japanese | cp932_japanese_ci | 2 |

| dec8 | DEC West European | dec8_swedish_ci | 1 |

| eucjpms | UJIS for Windows Japanese | eucjpms_japanese_ci | 3 |

| euckr | EUC-KR Korean | euckr_korean_ci | 2 |

| gb18030 | China National Standard GB18030 | gb18030_chinese_ci | 4 |

| gb2312 | GB2312 Simplified Chinese | gb2312_chinese_ci | 2 |

| gbk | GBK Simplified Chinese | gbk_chinese_ci | 2 |

| geostd8 | GEOSTD8 Georgian | geostd8_general_ci | 1 |

| greek | ISO 8859-7 Greek | greek_general_ci | 1 |

| hebrew | ISO 8859-8 Hebrew | hebrew_general_ci | 1 |

| hp8 | HP West European | hp8_english_ci | 1 |

| keybcs2 | DOS Kamenicky Czech-Slovak | keybcs2_general_ci | 1 |

| koi8r | KOI8-R Relcom Russian | koi8r_general_ci | 1 |

| koi8u | KOI8-U Ukrainian | koi8u_general_ci | 1 |

| latin1 | cp1252 West European | latin1_swedish_ci | 1 |

| latin2 | ISO 8859-2 Central European | latin2_general_ci | 1 |

| latin5 | ISO 8859-9 Turkish | latin5_turkish_ci | 1 |

| latin7 | ISO 8859-13 Baltic | latin7_general_ci | 1 |

| macce | Mac Central European | macce_general_ci | 1 |

| macroman | Mac West European | macroman_general_ci | 1 |

| sjis | Shift-JIS Japanese | sjis_japanese_ci | 2 |

| swe7 | 7bit Swedish | swe7_swedish_ci | 1 |

| tis620 | TIS620 Thai | tis620_thai_ci | 1 |

| ucs2 | UCS-2 Unicode | ucs2_general_ci | 2 |

| ujis | EUC-JP Japanese | ujis_japanese_ci | 3 |

| utf16 | UTF-16 Unicode | utf16_general_ci | 4 |

| utf16le | UTF-16LE Unicode | utf16le_general_ci | 4 |

| utf32 | UTF-32 Unicode | utf32_general_ci | 4 |

| utf8mb3 | UTF-8 Unicode | utf8mb3_general_ci | 3 |

| utf8mb4 | UTF-8 Unicode | utf8mb4_0900_ai_ci | 4 |

+----------+---------------------------------+---------------------+--------+

41 rows in set (0.08 sec)其中Default collation列表示这种字符集中一种默认的比较规则,Maxlen列,它代表这种字符集最多需要几个字节来表示一个字符。

查看MySQL中支持的比较规则

SHOW COLLATION [LIKE 匹配的模式];mysql> SHOW COLLATION LIKE 'utf8%';

+-----------------------------+---------+-----+---------+----------+---------+---------------+

| Collation | Charset | Id | Default | Compiled | Sortlen | Pad_attribute |

+-----------------------------+---------+-----+---------+----------+---------+---------------+

| utf8mb3_bin | utf8mb3 | 83 | | Yes | 1 | PAD SPACE |

| utf8mb3_croatian_ci | utf8mb3 | 213 | | Yes | 8 | PAD SPACE |

| utf8mb3_czech_ci | utf8mb3 | 202 | | Yes | 8 | PAD SPACE |

| utf8mb3_danish_ci | utf8mb3 | 203 | | Yes | 8 | PAD SPACE |

| utf8mb3_esperanto_ci | utf8mb3 | 209 | | Yes | 8 | PAD SPACE |

...

...

117 rows in set (0.00 sec)后缀 英文意义 描述

_ai accent insensitive 不区分重音

_as accent sensitive 区分重音

_ci case insensitive 不区分大小写

_cs case sensitive 区分大小写

_bin binary 以二进制方式比较在执行 SHOW COLLATION语句后返回的结果中,Default列的值为YES的比较规则,就是该字符集的默认比较规则,比如utf8字符集默认的比较规则就是utf8_general_ci。

MySQL有4个级别的字符集和比较规则,分别是服务器级别、数据库级别、表级别、列级别。

MySQL提供了两个系统变量表示服务器级别的字符集和比较规则

系统变量 描述

character_set_server 服务器级别的字符集

collation_server 服务器级别的比较规则mysql> SHOW VARIABLES LIKE 'character_set_server';

+----------------------+---------+

| Variable_name | Value |

+----------------------+---------+

| character_set_server | utf8mb4 |

+----------------------+---------+

1 row in set (0.15 sec)

mysql> SHOW VARIABLES LIKE 'collation_server';

+------------------+--------------------+

| Variable_name | Value |

+------------------+--------------------+

| collation_server | utf8mb4_0900_ai_ci |

+------------------+--------------------+

1 row in set (0.01 sec)在启动服务器程序时,可以通过启动选项或者在服务器程序运行过程中使用SET语句来修改这两个变量的值。

在创建和修改数据库时可以指定该数据库的字符集和比较规则

CREATE DATABASE 数据库名

[[DEFAULT] CHARACTER SET 字符集名称]

[[DEFAULT] COLLATE 比较规则名称];

ALTER DATABASE 数据库名

[[DEFAULT] CHARACTER SET 字符集名称]

[[DEFAULT] COLLATE 比较规则名称];其中DEFAULT可以省略。

如果想查看当前数据库使用的字符集和比较规则,可以查看两个系统变量的值,前提是使用USE语句选择当前的默认数据库。如果没有默认数据库,则变量与服务器级别下相应的系统变量具有相同的值。

系统变量 描述

character_set_database 当前数据库的字符集

collation_database 当前数据库的比较规则mysql> use db_log;

Reading table information for completion of table and column names

You can turn off this feature to get a quicker startup with -A

Database changed

mysql> SHOW VARIABLES LIKE 'character_set_database';

+------------------------+---------+

| Variable_name | Value |

+------------------------+---------+

| character_set_database | utf8mb4 |

+------------------------+---------+

1 row in set (0.00 sec)

mysql> SHOW VARIABLES LIKE 'collation_database';

+--------------------+--------------------+

| Variable_name | Value |

+--------------------+--------------------+

| collation_database | utf8mb4_0900_ai_ci |

+--------------------+--------------------+

1 row in set (0.00 sec)不能通过修改这两个变量的值来改变当前数据库的字符集和比较规则.

在数据库的创建语句中不指定字符集和比较规则,将使用服务器级别的字符集和比较规则作为数据库的字符集和比较规则。

可以在创建和修改表的时候指定表的字符集和比较规则

CREATE TABLE 表名(列的信息)

[[DEFAULT] CHARACTER SET 字符集名称]

[COLLATE 比较规则名称];

ALTER TABLE 表名

[[DEFAULT] CHARACTER SET 字符集名称]

[COLLATE 比较规则名称];如果创建表的语句中没有指明字符集和比较规则,贝u使用该表所在数据库的字符集和比较规则作为该袤的字符集和比较规则.

CREATE TABLE 表名(

列名 字符串类型 [CHARACTER SET 字符集名称] [COLLATE 比较规则名称],

其他列...

);

ALTER TABLE 表名 MODIFY 列名 字符串类型 [CHARACTER SET 字符集名称] [COLLATE 比较规则名称];在修改列的字符集时需要注意,如果列中存储的数据不能用修改后的字符集进行表示,则会发生错误.比如,最初使用的字符集是utf8,列中存储了一些汉字,现在把列的字符集转换为回CII的话就会出错,因为脑Cll字符集并不能表示汉字字符.

由于字符集和比较规则之间相互关联,因此如果只修改字符集,比较规则也会跟着变化:如果只修改比较规则,字符集也会跟着变化.具体规则如下

对于给定的表,应该知道它的各个列的字符集和比较规则是什么,从而根据这个列的类型来确定每个列存储的实际数据所占用的存储空间大小。

mysql> INSERT INTO t(col) VALUES('我我');如果列col使用的字符集是gbk,一个字符’我’在gbk中的编码为0xCED2,占用2字节,则两个字符就占用了4字节,如果把该列字符集修改为utf8,这两个字符实际占用的存储空间就是6字节了。

如果使用不同地字符集去解码这个字节序列,最后得到地结果可能让你挠头。

如UTF-8字符集下编码地字节序 0xE68891,程序A把字节序发送到程序B,程序B使用不同的字符集解码这个字节序列使用GBK字符集。

看第一个字节0xE6,它的值大于0x7F(127),说明待取字符是两字节编码,GBK编码表查找0xE688对应字符。

继续读0x91,值也大于0x7F试图读下一个字节,发现后面没有了,所以这是个半字符。根本解不出来字符’我’。

如果接收 0xE68891 这个字节序列的程序按照UTF-8字符集进行解码,然后又把它按照GBK字符集进行编码,则编码后的字节序列就是 0xCED2.我们把这个过程称为字符集的转换,也就是字符串’我’从UTF-8字符集转换为GBK字符集.

用户角度看,客户端发送的请求以及服务器返回的响应都是一个字符串。机器角度看,客户端发送的请求和服务器返回的响应本质就是一个字节序列。

一般情况下,客户端编码请求字符串时使用的字符集与操作系统当前使用的字符集一致。

当使用类UNIX操作系统时,环境变量 LC_ALL LC_CTYPE LANG 的值决定了操作系统当前使用的是那种字符集。

优先级 LC_ALL > LC_CTYPE > LANG

root@kTY-HK3-QL-86139:/home/root/note# echo $LC_ALL

root@kTY-HK3-QL-86139:/home/root/note# echo $LC_CTYPE

root@kTY-HK3-QL-86139:/home/root/note# echo $LANG

C.UTF-8获取类UNIX操作系统当前使用的字符集时,调用的是系统函数 nl_langinfo(CODESET), man 3 nl_langinfo 可以查看详情

服务器接收到的请求就是一个字节序列,服务器将这个字节序列看作是使用系统变量 character_set_client代表的字符集进行编码的字节序列,每个客户端与服务器建立连接后,服务器都会为该客户端维护一个单独的 character_set_client变量,这个变量是SESSION级别的。

加入客户端实际使用UTF-8字符集来编码请求的字符串,可以通过命令将character_set_client设置为latin1字符集

SET character_set_client=latin1;服务器解析失败是会发出警告的。

mysql> SET character_set_client=ascii;

Query OK, 0 rows affected (0.00 sec)

mysql> SELECT '我';

+-----+

| ??? |

+-----+

| ??? |

+-----+

1 row in set, 1 warning (0.00 sec)

mysql> SHOW WARNINGS\G

*************************** 1. row ***************************

Level: Warning

Code: 1300

Message: Cannot convert string '\xE6\x88\x91' from ascii to utf8mb4

1 row in set (0.00 sec)服务器会将请求的字节序当作采用 character_set_client 对应的字符集进行编码的字节序,在真正处理请求时又会将其转换为使用SESSION级别的系统变量 charater_set_connection 对应的字符集进行编码的字节序列。

假如有一个表

CREATE TABLE tt(

c VARCHAR(100)

) ENGINE=INNODB CHARSET=utf8;列c采用字符集和表级别字符集utf8一致,这里采用默认的比较规则utf8_general_ci。

mysql> SELECT * FROM tt;

+--+

|c |

+--+

|我|

+--+如果现在将 character_set_connection 和 collation_connection 的值分别设置为 gbk 和 gbk_chinese_ci

SELECT * FROM tt WHERE c = '我';上面语句中’我’时gbk编码的,列c是utf8编码的,MySQL规定,在这种情况下,列的字符集和排序规则的优先级更高,这里需要将请求中的字符串 从gbk转换为utf8,然后再使用列c的比较规则utf8_genneral_ci进行比较。

服务器为客户端响应发送的结果编码,这取决于SESSION级别的系统变量 character_set_results的值。

系统变量 描述

character_set_client 服务器认为请求是按照该系统变量指定的字符集进行编码的

character_set_connection 服务器在处理请求时,会把请求字节序列从character_set_client转换为character_set_connection

character_set_results 服务器采用该系统变量指定的字符集对返回给客户端的字符串进行编码每个MySQL客户端都维护着一个客户端默认字符集,客户端在启动时会自动检测所在操作系统当前使用的字符集,并按照一定的规则映射成MySQL支持的字符集,然后将该字符集作为客户端默认的字符集.

通常的情况是,操作系统当前使用什么字符集,就映射为什么字符集.但是总存在一些特殊情况.假如操作系统当前使用的是asCll字符集,则会被映射为MySQL支持的latinl字符集.如果MySQL不支持操作系统当前使用的字符集,则会将客户端默认的字符集设置为MySQL的默认字符集.

在MySQL5.7以及之前的版本中,MySQL的默认字符集为latin1,自MySQL8.0开始默认字符集为utf8mb4。

另外,如果在启动MySQL客户端时设置了default-cbaracter-set启动选项,那么服务器会忽视操作系统当前使用的字符集,直接将default-cbaracter-set启动选项中指定的值作为客户端的默认字符集。

在连接服务器时,客户端将默认的字符集信息与用户名、密码等信息一起发送给服务器,服务器接收到后将三个系统变量的值初始化为客户端的默认字符集。

SET NAMES charset_name;

上面这条语句与下面这3条语句的效果一样:

set character_set_client = charset_name;

set character_set_connection = charset_name;

set character_set_results = charset_name;SET NAMES

不会改变客户端实际使用的字符集。客户端需要自行确保发送的字符串与声明的字符集一致。

如果客户端的默认字符集与 SET NAMES

声明的字符集不一致,可能会导致字符编码问题。

为了避免字符集不一致的问题,建议在客户端连接时明确指定字符集。例如,在 MySQL 客户端连接时可以使用:

mysql --default-character-set=utf8mb4 -u username -p或者在代码中设置字符集

<?php

$mysqli = new mysqli("localhost", "username", "password", "database");

$mysqli->set_charset("utf8mb4");如果操作系统当前使用的字符集为UTF-8,在启动MySQL客户端时使用了--default-character-set=gbk,客户端默认字符集会被设置为gbk,服务器的character_set_results也会被设置为gbk,假设服务器发送

‘我’,发送的为 gbk编码 0xCED2

对于类UNIX操作系统来说,会把接收到的字节序列(也就是0xCED2)直接写到黑框框中,并默认使用操作系统当前使用的字符集(UTF-8)来解释这个字符·很显然无法解释,所以我们在屏幕上看到的就是乱码。

大多数用于字符串字符排序

SELECT * FROM t ORDER BY col;MySQL 服务器中负责对表中的数据进行读取和写入工作的部分是存储引擎,而服务器又支持不同类型的存储引擎,比如 InnoDB、MyISAM、MEMORY啥的。用的最多的就是InnoDB我们下面就学这个。

InnoDB是一个将表中的数据存储在磁盘上的存储引擎,从磁盘中读到内存也是它做的事情。当我们想从表中获取某些记录时,InnoDB不可能一条条把记录从磁盘上读出来,InnoDB采取的方式是, 将数据划分为若干个页,以页作为磁盘和内存之间交互的基本单位。InnoDB中页的大小一般为16KB。也就是在一般情况下,一次最少从磁盘中读取16KB的内容到内存中,一次最少把内存中的16KB内容刷新到磁盘中。

服务器运行过程中不可以更改页面大小。系统变量 innodb_page_size表明了InnoDB存储引擎中的页大小,默认值为16384,该变量只能在第一次初始化MySQL数据目录时指定。

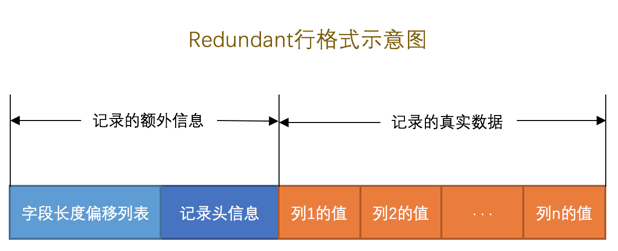

目前为止,设计了4中不同类型的行格式,分别为 COMPACT、REDUNDANT、DYNAMIC、COMPRESSED。

📌 行格式常见选项说明:

| 格式名 | 说明 |

|---|---|

| COMPACT | 默认格式,InnoDB 默认使用的行格式(5.0 以后) |

| REDUNDANT | 老旧格式,仅用于兼容 MySQL 4.1 之前版本 |

| DYNAMIC | 支持更长的行,TEXT/BLOB 存储在页外,推荐使用 |

| COMPRESSED | 数据压缩存储,节省磁盘空间 |

可以在创建或修改表的语句中指定记录所使用的行格式。

CREATE TABLE 表名(列的信息) ROW_FORMAT=行格式名称;

ALTER TABLE 表名 ROW_FORMAT=行格式名称。例如

CREATE TABLE users (

id INT PRIMARY KEY AUTO_INCREMENT,

name VARCHAR(100),

email VARCHAR(100)

) ENGINE=InnoDB ROW_FORMAT=DYNAMIC;

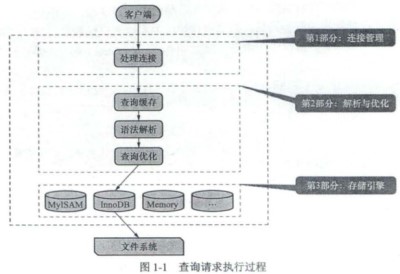

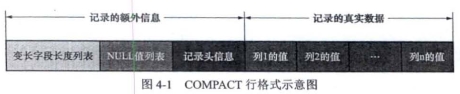

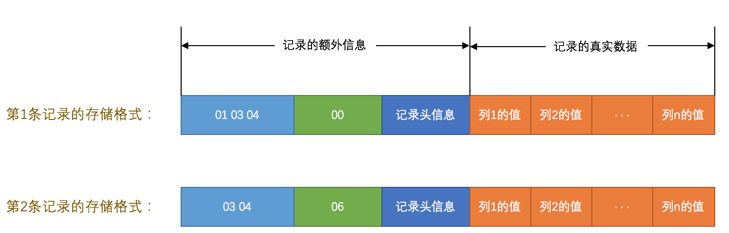

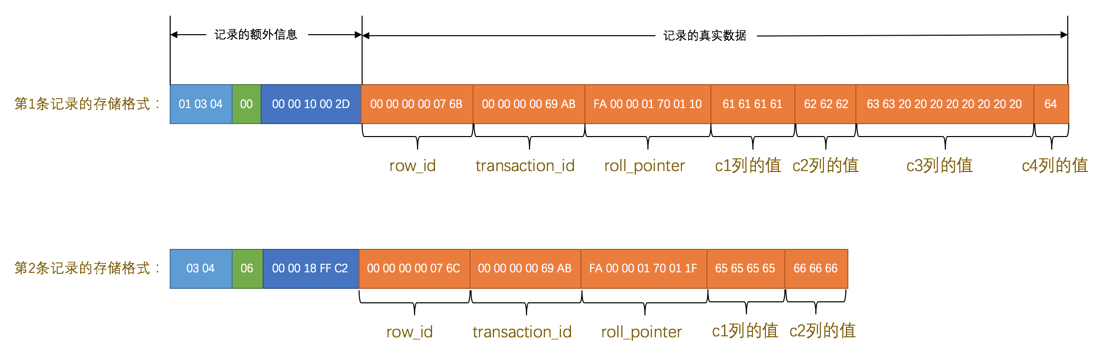

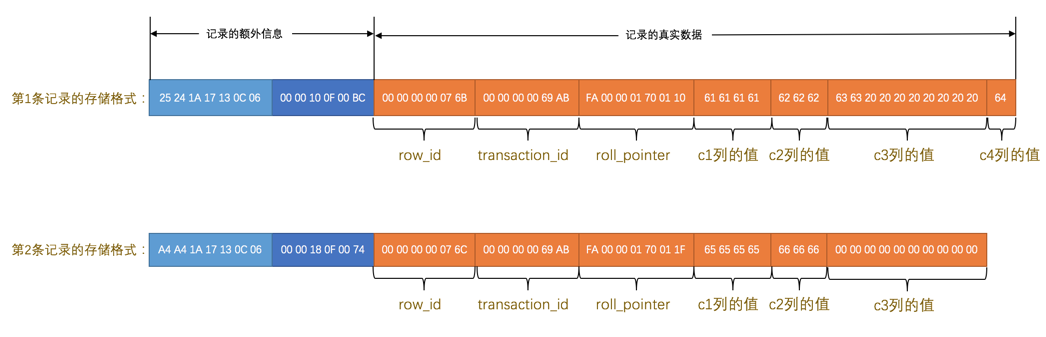

ALTER TABLE users ROW_FORMAT=COMPRESSED;一条完整的记录分为记录的额外信息和记录的真实数据两大部分。

分别是变长字段长度列表、NULL值列表和记录头信息。

MySQL支持一些变长的数据类型,比如 VARCHAR(M)、VARBINARY(M)、各种TEXT类型、各种BLOB类型。这些变长字段占用的存储空间分为两部分。

在COMPACT行格式中,所有变长字段的真实数据占用的字节数都存放在记录的开头位置,从而形成一个变长字段长度列表,各变长字段的真实数据占用的字节数按照列的顺序逆序存放.再次强调一遍,是逆序存放!

例如有个表

c1 VARCHAR(10) | c2 VARCHAR(10) | c3 VARCHAR(10)

'aaaa'|'bbb'|'d'

实际占用字节数

0x04 0x03 0x01在COMPACT行,头部变长信息部分就会存储

01 03 04这三个字段的长度较短,其实际长度用一个字节就可以存储,但是长度大的话一个字就存不下了,InnoDB有一套字节的规则。

引入W、M和L这几个符号,先分别看看这些符号的意思.

InnoDB在读取记录的变长字段长度列表时会先看表结构,先查看表结构,如果变长字段允许存储的最大字节数不大于255,则直接认为使用1个字节表示真实数据占用的字节数。

InnoDB 第一个二进制位作为标志位:如果字节的第一个位为0,那该字节就是一个单独的字段长度(使用一个字节表示不大于127的二进制的第一个位都为0),如果该字节第一个位为1,那么该字节就是半个字段长度。

对于占用字节数非常多的字段,比如某个字段长度大于16KB,那么如果记录在单个页面内无法存储时,InnoDB会把一部分数据存放到所谓的溢出页中,在变长字段长度列表处只存储留在本页面中的长度。

mysql> SELECT * FROM record_format_demo;

+------+-----+------+------+

| c1 | c2 | c3 | c4 |

+------+-----+------+------+

| aaaa | bbb | cc | d |

| eeee | fff | NULL | NULL |

+------+-----+------+------+

2 rows in set (0.00 sec)

mysql>

并不是所有记录都有这个 变长字段长度列表 部分,比如表中所有的列都不是变长的数据类型,这一部分就不需要有。

COMPACT行格式把一条记录中值为NULL的列统一管理起来,存储到NULL值列表中。

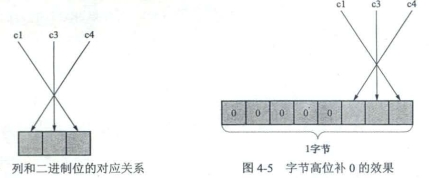

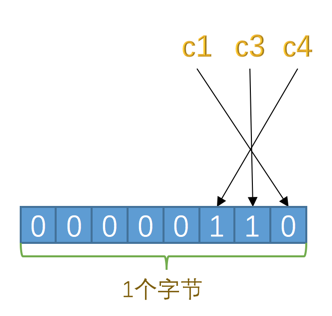

一个位就能表示一个字段是否为NULL,标记NOT NULL的列不用存标记位。在顺序按照列的顺序的逆序。高位补零。

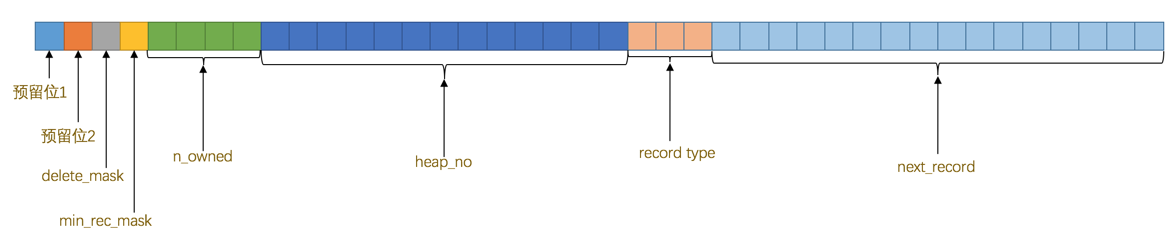

除了 变长字段长度列表、NULL值列表 之外,还有一个用于描述记录的记录头信息,由固定的5个字节组成,40个二进制位。

| 大小bit | 名称 | 描述 |

|---|---|---|

| 1 | 预留位1 | 没有使用 |

| 1 | 预留位2 | 没有使用 |

| 1 | delete_mask | 标记该记录是否被删除 |

| 1 | min_rec_mask | B+树的每层非叶子节点中的最小记录都会添加该标记 |

| 4 | n_owned | 表示当前记录拥有的记录数 |

| 13 | heap_no | 表示当前记录在记录堆的位置信息 |

| 3 | record_type | 0表示普通记录、1表示B+树非叶子节点记录、2表示最小记录、3表示最大记录 |

| 16 | next_record | 表示下一条记录的相对位置 |

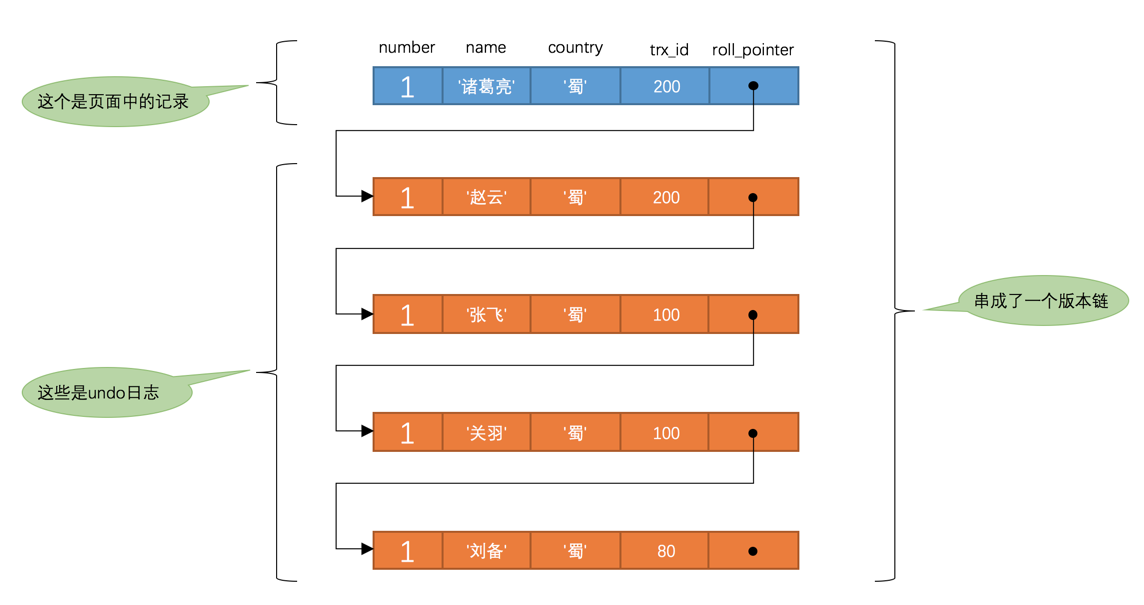

记录的真实数据 除了 c1、c2、c3、c4 这几个我们自己定义的列的数据以外,MySQL会为每个记录默认的添加一些列(也称为隐藏列)

| 列名 | 是否必须 | 占用空间 | 描述 |

|---|---|---|---|

| row_id | 否 | 6字节 | 行ID,唯一标识一条记录 |

| transaction_id | 是 | 6字节 | 事务ID |

| roll_pointer | 是 | 字节 | 回滚指针 |

实际上这几个列真正名称是: DB_ROW_ID、DB_TRX_ID、DB_ROLL_PTR。

InnoDB 表对主键的生成策略:优先使用用户自定义主键作为主键,如果用户没有定义主键,则选取一个 Unique 键作为主键,如果表中连 Unique 键都没有定义,InnoDB会为表默认添加一个名为 row_id 的隐藏列作为主键。

表使用的是 ascii 字符集,其中 0x61616161 就表示字符串

aaaa。第一条记录c3列的值它是 CHAR(10)

类型的,实际存储的字符串是 cc, ascii字符集中字节表示是

0x6363,虽然只用2字节,

但整个c3列仍然占用了10个字节空间。其他字符都用空格字符填充ascii字符集表示就是

0x20。

第2条记录中,c3和c4列的值都为NULL,它们被存在了前边的NULL值列表处。

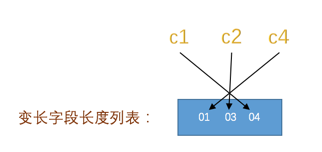

c1、c2、c4 列的类型是 VARCHAR(10),而 c3 列的类型是 CHAR(10)。Compact行格式下只会把变长类型的列的长度逆序存到变长字段长度列表中,

但如果不是 ascii 这种定长字符集,那么存N个字符所需的空间可能是变长的。

mysql> ALTER TABLE record_format_demo MODIFY COLUMN c3 CHAR(10) CHARACTER SET utf8;

Query OK, 2 rows affected (0.02 sec)

Records: 2 Duplicates: 0 Warnings: 0上面将 c3 列的字符编码改为 utf8。

对于 CHAR(M) 类型的列来说,当列用的字符集为定长字符集时,该列占用的字节数不会被加到变长字段长度列表,而如果采用变长字符集时,该列占用的字节数也会被加到变长字段长度列表。

变长字符集的 CHAR(M) 类型的列要求至少占用M个字节,而 VARCHAR(M) 却没有这个要求。例如,使用utf8字符集的 CHAR(10) 的列来说, 该列存储的数据字节长度的范围是10~30个字节。

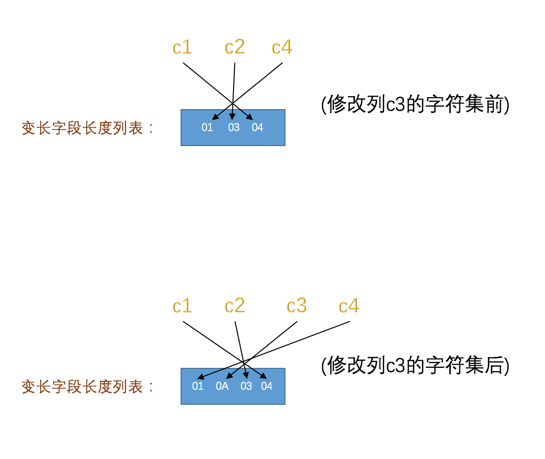

Redundant 译为 冗余的。

Redundant行是 MySQL5.0之前用的一种行格式,也就是说它已经非常老了,看看乐呵就好。

把表 record_format_demo 的行格式修改为 Redundant

mysql> ALTER TABLE record_format_demo ROW_FORMAT=Redundant;

Query OK, 0 rows affected (0.05 sec)

Records: 0 Duplicates: 0 Warnings: 0Redundant行格式的开头是 字段长度偏移列表

比如第一条记录的 字段长度偏移列表 就是:

25 24 1A 17 13 0C 06因为它是逆序排放的,所以按照列的顺序排列就是

06 0C 13 17 1A 24 25说实话这些东西如果不是真正的是数据库底层开发者,我想快速过一遍了解下已经很不错了,先把上层的经验搞充足,这些都是留给DB开发来做的事情,况且Redundant行格式几乎现在已经不用了。

“一行记录 约等于 塞进16KB的盒子,如果塞不下,就必须外包。”

VARCHAR(M) 类型的列最多可以占用65536个字节。

MySQL对一条记录占用的最大存储空间是有限制的,处理 BLOB或者TEXT类型的列以外, 其他的所有列(不包括隐藏列和记录头信息)占用的字节长度加起来不能超过65536个字节。

页并不是16KB都给你,一页里 还有 页头、页目录、行指针、行记录元数据,真正留给一行数据的空间大约只有8KB左右(经验值)。

MySQL中磁盘和内存交互的基本单位是页,MySQL是以页为基本单位来管理存储空间的,

记录都会被分配到某个页中存储,而一个页大小一般是16KB,也就是 16384 字节,

而一个 VARCHAR(M) 类型的列最多可以存 65535

个字节,这样就可能造成一个页存不下情况,

无论是 Compact和Reduntant 行格式,对于占用存储空间非常大的列, 在记录的真实数据只会存储该列的一部分数据,其他剩余部分分散存储在几个其他页中, 然后记录的页的地址。

数据处只会存储该列的前 768 个字节的数据和一个指向其他页的地址,然后把剩下的数据存放到其他页中,这个过程也叫做 行溢出 ,存储超出 768 字节的那些页面也被称为 溢出页 。

你不用关注这个临界点是什么,只要知道如果我们想要一个行中存储了很大的数据时, 可能发生 行溢出 的现象。

这两格式和Compact行格式挺像,但在处理 行溢出 数据它们不会记录真实数据存储字段真实数据的前 768字节,而是把所有字节都存储到其他页面中,只记录数据储存其他页面的地址。

Compressed行格式和Dynamic不同的一点是,Compressed行格式会采用压缩算法对页面进行压缩,以节省空间。

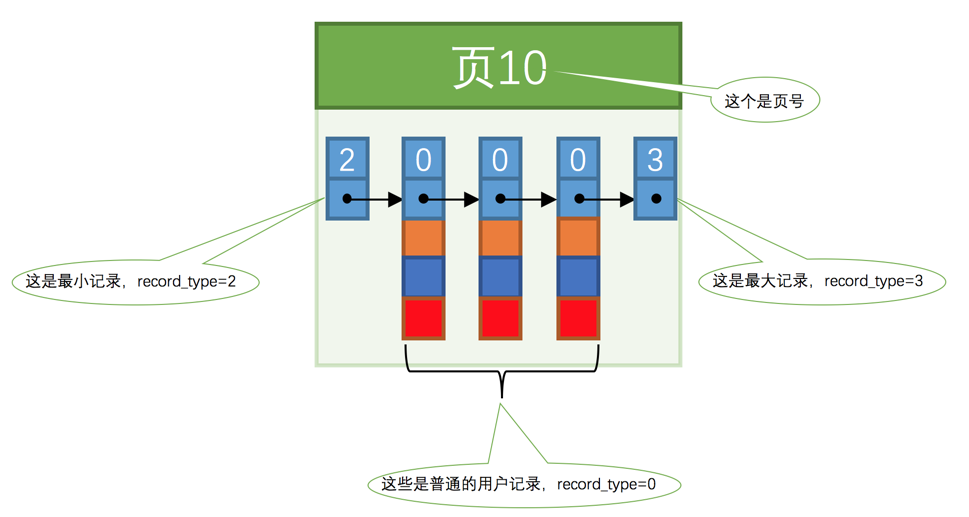

InnoDB为了不同地目的而设计了许多种不同类型地页,先聚焦 存放表种记录的那种页,官方称为这种存放记录的页为索引(INDEX)页。

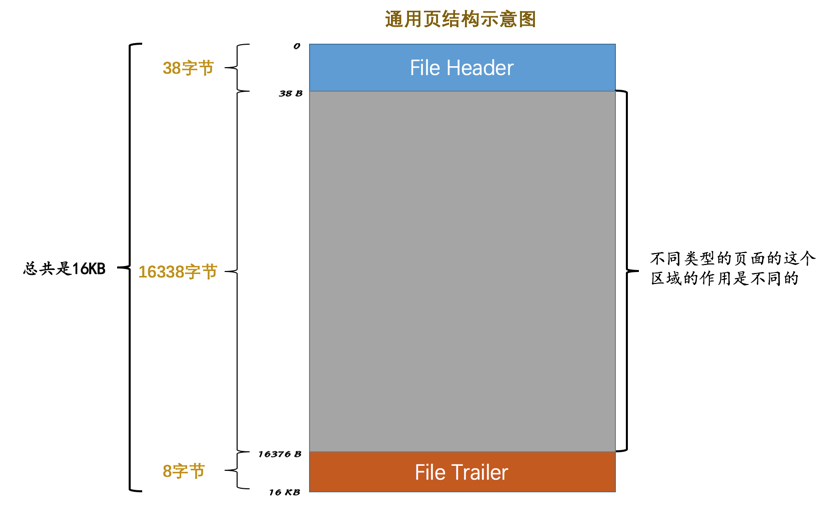

数据页代表的16KB大小的存储空间可以被划分为多个部分,如

| 区域 | 中文名 | 大致大小 | 作用 |

|---|---|---|---|

| File Header | 文件头 | 38 B | 页级元信息(页号、LSN、校验等) |

| Page Header | 页头 | 56 B | 页内状态、记录数量、链表指针 |

| Infimum + Supremum | 最小/最大记录 | 26 B | 页内记录边界哨兵 |

| User Records | 用户记录 | 不固定 | 真正的行数据 |

| Free Space | 空闲空间 | 不固定 | 插入新记录用 |

| Page Directory | 页目录 | 不固定 | 记录槽(slot),加速查找 |

| File Trailer | 文件尾 | 8 B | 校验页完整性 |

看看就行了,没必要钻牛角尖。

一开始生成新的页时,是没有UserRecords的,只有FreeSpace,当 记录多了 UserRecord会使用剩余FreeSpace。

InnoDB 的行记录头(record header)当成一张“微型身份证”来看。它藏在每一行记录的最前面,体积极小,却决定了这行数据在 B+Tree 里怎么活、怎么死、怎么被遍历。

在 InnoDB 的索引页(page)里,记录是按链表串起来的,同时又服务于 B+Tree。记录头就是“链表 + 树结构 + MVCC”的交汇点。

这是“这行是不是已经被判死刑”的标志位。

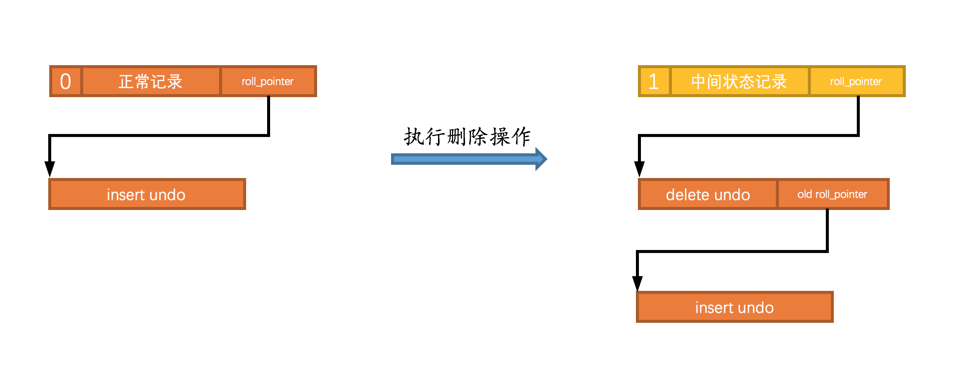

当你执行 DELETE FROM t ... 时,InnoDB

并不会立刻物理删除这行,而是把 delete_mask 置 1。

它的哲学是:“先宣布死亡,等合适的实际再收尸。”

好处:

delete_mask = 1 ≠ 这行不存在,只是“逻辑已删”。

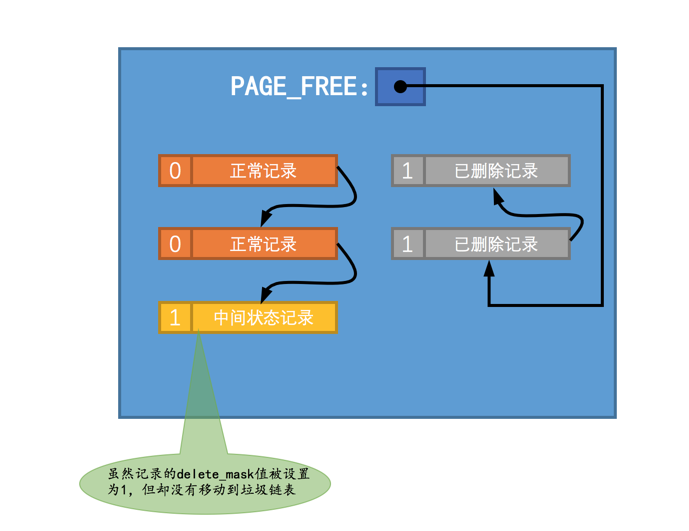

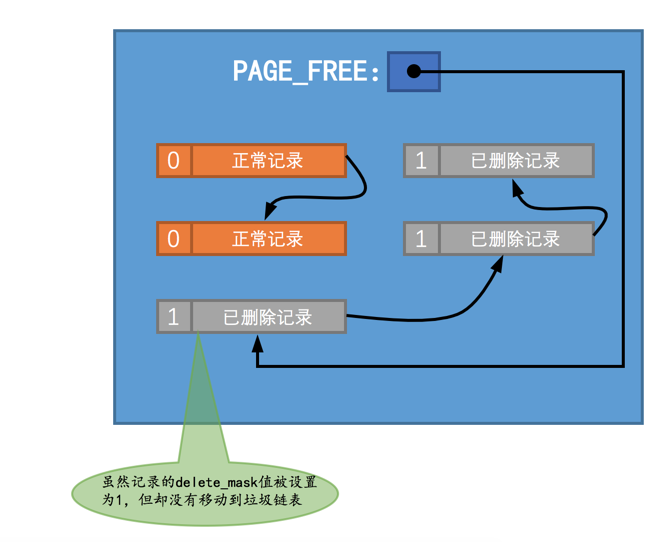

当数据页中存在多条被删除的记录时,这些记录的next_record属性将会把这些被删除掉的记录组成一个垃圾链表,已备之后重用这部分存储空间。

这是一个非常冷门但很关键的标志。 它只会出现在非叶子节点(internal node)中。

在 B+Tree 的内部页里,每个子节点都需要一个“下界 key”。

min_rec_mask = 1 表示:

这条记录是这个 page 中的“最小 key 代表”

换句话说,它是路标,不是普通居民。

普通表数据的叶子节点里,这个标志永远是 0。

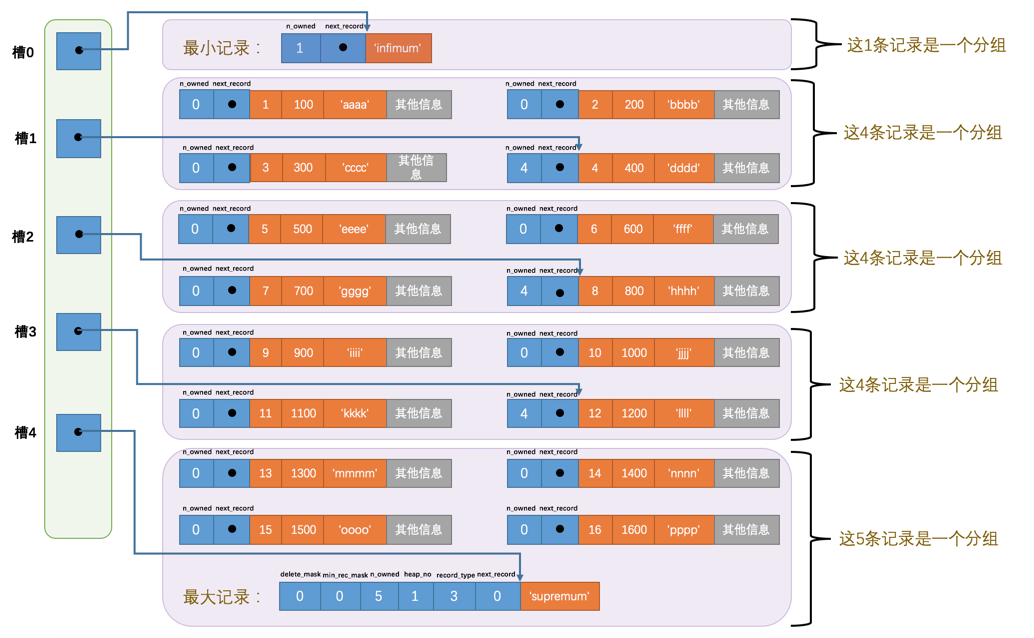

这个字段和 page directory(二分查找加速结构)有关。

在一个 page 里,并不是每条记录都会出现在 page directory 中。 directory 里的某条记录,会“代表”它后面的一小段记录。

n_owned 表示:

这条记录在 directory 视角下,管着后面多少条记录

可以把它理解成:“你是小组长,名下有几个人?”

它的存在,让 InnoDB 能在 page 内做二分查找 + 链表遍历,避免从头扫到尾。

这是记录在页内的逻辑编号,按插入顺序分配。

几个重要事实:

所以 heap_no 不是“当前顺序”,而是“出生编号”。 它更像对象 ID,不是座位号。

这个字段决定了:“你到底是个什么东西?”

常见取值语义是:

infimum / supremum 这两条是 InnoDB 的“宇宙边界”, 保证链表永远有头有尾,算法可以少写很多 if。

这是页内单向链表的核心。

每条记录都知道:

“我后面是谁(以字节偏移量表示)”

而且next_record刚好指下一个记录的,记录头和真实数据的中间,向左就是记录头向右就是真实数据。

注意关键点:

当你做 WHERE id BETWEEN 10 AND 20, MySQL

找到第一条后,就顺着 next_record 一路溜达。

InnoDB的一行记录,本质上是

典型的“数据库世界观”:空间换时间,复杂换确定性。

Page Directory 是 InnoDB 在每个 16KB 页里,悄悄塞的一层微型索引,用极小的代价,让页内查找从“盲走”变成“先定位再微调”。

把 Page Directory(页目录) 想成 InnoDB 在一个 page 里偷偷放的一本“索引的索引”。 page 里已经有记录了,但记录太多、全靠链表走会慢,于是 InnoDB 在页尾又加了一层结构,专门用来加速页内查找。

大白话版结论:

Page Directory = 用很少的指针,帮你在一个 page 内做“近似二分查找”。

不是完整索引,是“路标集合”。

一个 InnoDB page(16KB)的大致布局是:

| File Header |

| Page Header |

| Infimum |

| User Records (链表) |

| Free Space |

| Page Directory | <-- 在页尾,倒着长

| File Trailer |关键点:

page 内的记录是这样组织的:

物理上:乱序存放(heap)

逻辑上:靠 next_record 串成 有序链表

如果没有 Page Directory: 查一条记录 = 从 infimum 开始顺链表一个个走 最坏情况 ≈ 几百条比较

Page Directory 的目标只有一个:别从头扫。

它是一个数组,每个元素是:

2 字节:record offset(相对 page 起始位置)这些 offset 指向的是 “某些关键记录”,而不是全部记录。

这些被选中的记录,满足两个条件:

n_owned,正是为 Page Directory 服务的。

从这条记录开始,后面有多少条记录归它“管”

Directory 指向:

R1 (n_owned = 4) -> R1, R2, R3, R4

R5 (n_owned = 4) -> R5, R6, R7, R8

R9 (n_owned = 3) -> R9, R10, R11Directory 里只有 R1、R5、R9 三个入口。

查找流程

当你在一个 page 里查 key = 7:

于是复杂度变成:

O(log D) + O(k)D = 目录项数量(很小) k = n_owned(通常 4~8)

这就是 InnoDB 的“折中艺术”。

如果每条记录一个目录项:

InnoDB 的取舍是:

少量目录项 + 少量线性扫描 = 总体最优

工程上,这是极其成熟的选择。

重要但容易混淆的一点:

一个管“城市导航”,一个管“楼内导视”。

InnoDB 存储引擎,它不存“业务数据”,而是存“关于这个页面本身的信息”。

它主要回答这些问题:

没有 Page Header,InnoDB 连“怎么在这一页里走路”都不知道。

PAGE_N_RECS

这一页里有多少条用户记录 * 不包括 Infimum / Supremum

* 插入、删除都会更新

* B+Tree 分裂时,它是判断“这页是不是太挤了”的重要指标

一句话:页的人口普查表

PAGE_FREE

空闲记录链表的头指针 * 页里被删除的记录不会立刻抹掉 * 而是挂到“free list”里,等下次复用 * PAGE_FREE 指向这条链表的第一条记录 这就是 InnoDB “删除不是真删除”的物理原因之一。

PAGE_LAST_INSERT

最近一次插入的位置 * 用来优化顺序插入(典型:自增主键) * 如果你一直往右边插,InnoDB 会偷懒少做查找 这也是为什么 自增主键 对 InnoDB 非常友好。

PAGE_DIRECTION + PAGE_N_DIRECTION

插入趋势统计 * 记录最近插入是:向左?向右?随机? * 连续多少次同一方向 它不参与逻辑正确性,只参与性能优化。可以理解为:页在“观察人类的插入习惯”。

PAGE_HEAP_TOP

当前堆空间的顶部

PAGE_GARBAGE

页内碎片大小 * 删除、更新(变长字段)会产生碎片 * 超过阈值,InnoDB 可能会触发页整理 碎片不是 bug,是生命周期的副作用。

PAGE_LEVEL

当前页在B+树中所处的层级

这是判断“这一页是存数据行,还是存索引指针”的关键字段。

PAGE_INDEX_ID

这个页属于哪个索引

把 InnoDB 页想成一个小型城市:

城市运转,全靠它。

你平时写 SQL 不会直接碰它,但很多“数据库玄学问题”都和它有关:

在 InnoDB 里,几乎所有“文件型对象”——表空间页(page)、undo 页、索引页——开头 38 个字节都是同一套结构,这一段就叫 FIL Header。给存储引擎和崩溃恢复用的“生命体征监测仪”。

File Header = 每个 InnoDB 页的“身份证 + 体检表”

无论这是:

开头一定是同样的 38 字节。

按字节偏移来讲最清楚:

偏移 长度 含义

0 4 FIL_PAGE_SPACE_OR_CHKSUM

4 4 FIL_PAGE_OFFSET

8 4 FIL_PAGE_PREV

12 4 FIL_PAGE_NEXT

16 8 FIL_PAGE_LSN

24 2 FIL_PAGE_TYPE

26 8 FIL_PAGE_FILE_FLUSH_LSN

34 4 FIL_PAGE_ARCH_LOG_NO_OR_SPACE_IDFIL_PAGE_SPACE_OR_CHKSUM(4B)

页校验和

用来判断:“这页是不是在磁盘上被写坏了?”

InnoDB 会在读页时校验它,校验失败就认为页损坏。

FIL_PAGE_OFFSET(4B)

文件偏移 = page_no * 16KBFIL_PAGE_PREV / FIL_PAGE_NEXT(各 4B)

比如:

B+Tree、undo、free list 全靠这个“页级指针”在磁盘上跳转。

FIL_PAGE_LSN(8B)

恢复时逻辑是:

redo log 的 LSN > 页的 LSN,说明这页没来得及刷盘,要 redo。

FIL_PAGE_TYPE(2B)

FIL_PAGE_INDEX 索引页(最常见)

FIL_PAGE_UNDO_LOG undo 页

FIL_PAGE_INODE 段 inode 页

FIL_PAGE_IBUF_FREE_LIST

FIL_PAGE_TYPE_SYS 系统页看到这个字段,InnoDB 才知道:“哦,这是索引页,那我按 B+Tree 结构解析。”

FIL_PAGE_FILE_FLUSH_LSN(8B)

普通数据页基本不关心,系统页才重要。

FIL_PAGE_ARCH_LOG_NO_OR_SPACE_ID(4B)

这就是为什么:同一个页号,在不同表空间里不会冲突

它不只存在于 .ibd 文件

它存在于:

只要是InnoDB页,就有File Header。

这套设计解决了三个硬核问题:

LSN + redo log

不需要 fsync 每一页

页号 → 直接定位

prev / next → 页级遍历

checksum 防 silent corruption

page type 防解析错位

在 MySQL 里,File Trailer 是个听起来像“文件尾巴”的东西,实际上也确实如此,但它不是随便加的尾注,而是 InnoDB 数据文件里一个非常关键的安全装置。

一个直觉版结论:

File Trailer 是 InnoDB 页(page)末尾的 8 个字节,用来防止“写了一半就断电”的那种宇宙级尴尬。

InnoDB 的每个 page 默认是 16KB,结构大概是:

| File Header | Page Header | Page Body | Page Directory | File Trailer |File Trailer 固定占 8 字节,内容是:

这 8 字节和 File Header 里的对应字段是镜像关系。

想象一个经典灾难场景:

如果没有 File Trailer,InnoDB 很可能把这个 残缺 page 当成完整 page 使用,那就不是报错,是直接悄悄写坏数据。

File Trailer 的作用就是:“你写完了吗?写完整了吗?和我头部说的一样吗?”

启动或读page时,InnoDB会做三件事:

如果不一致,结论只有一个:这个Page在写入过程中被中断过

接下来就轮到 redo log 登场,尝试恢复;实在不行,这个 page 会被标记为损坏。

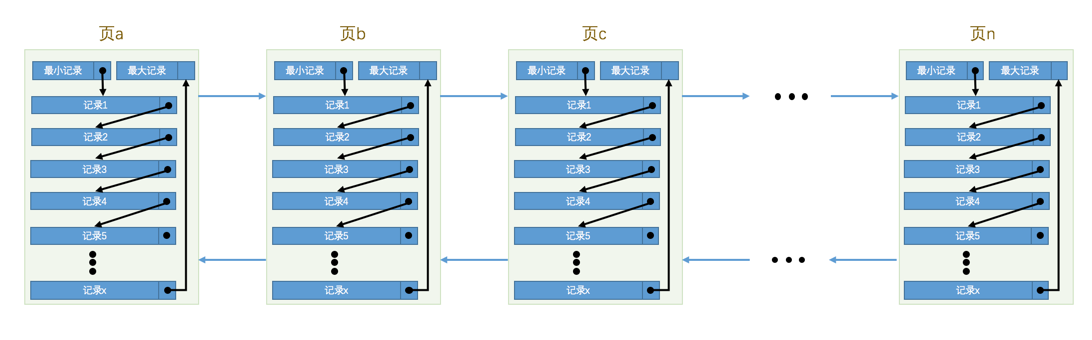

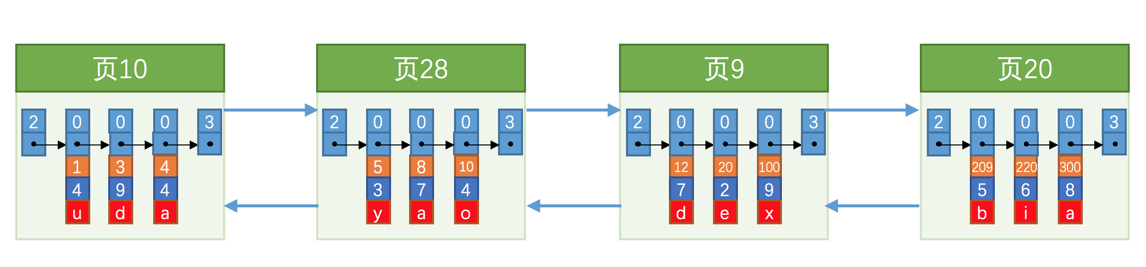

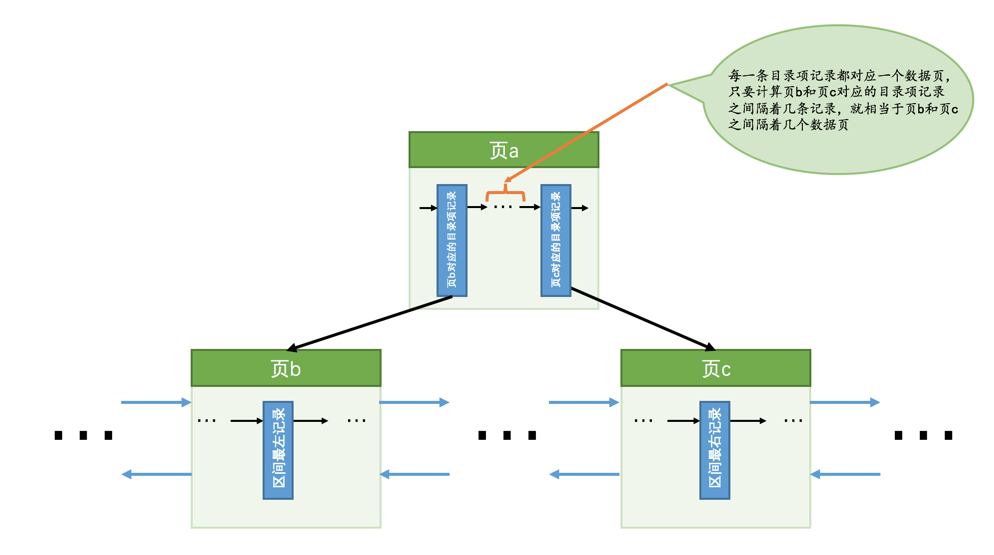

前面说了,InnoDB数据页的7个组成部分,知道各数据页可以组成一个双向链表,而每个数据页 中的记录会按照主键值从小到大的顺序组成一个 单向链表 ,每个数据页都会为存储在它里边儿的记录生成一个 页目录 ,在通过主键查找某条记录的时候可以在 页目录 中使用二分法快速定位到对应的槽,然后再遍历该槽对 应分组中的记录即可快速找到指定的记录。

下面的查找假设以

SELECT [列名列表] FROM 表名 WHERE 列名 = xxx

以主键为搜索条件,可以在 页目录 中使用二分法快速定位到对应的槽,然后再遍历该槽对应分组中的记录即可快速找到指定的记录。

以其他列作为搜索条件对非主键列的查找的过程可就不这么幸运了,因为在数据页中并没有对非主键列建立所谓的 页目录 ,所以我们无法通过二分法快速定位相应的 槽 。这种情况下只能从 最小记录 开始依次遍历单链表中的每条记录,

可分为两个步骤:

在没有索引的情况下,不论是根据主键列或者其他列的值进行查找,由于我们并不能快速的定位到记录所在的页,所以只能从第一个页沿着双向链表一直往下找

因为要遍历所有的数据页,所以这种方式显然是超级耗时的。

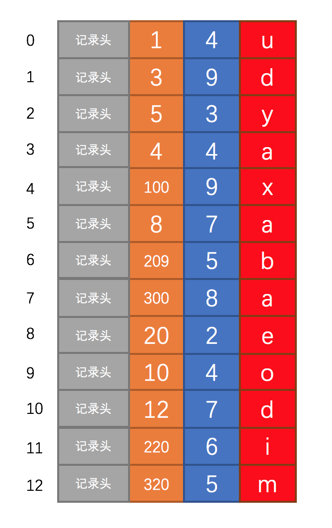

先按照下面的表来说

mysql> CREATE TABLE index_demo(

-> c1 INT,

-> c2 INT,

-> c3 CHAR(1),

-> PRIMARY KEY(c1)

-> ) ROW_FORMAT = Compact;

“下一个数据页中用户记录的主键必须大于上一个页中用户记录的主键值。”

如果进行一些增删改操作,必须通过通过一些诸如记录移动的操作来始终保 证这个状态一直成立:下一个数据页中用户记录的主键值必须大于上一个页中用户记录的主键值。这个过程 我们也可以称为 页分裂 。

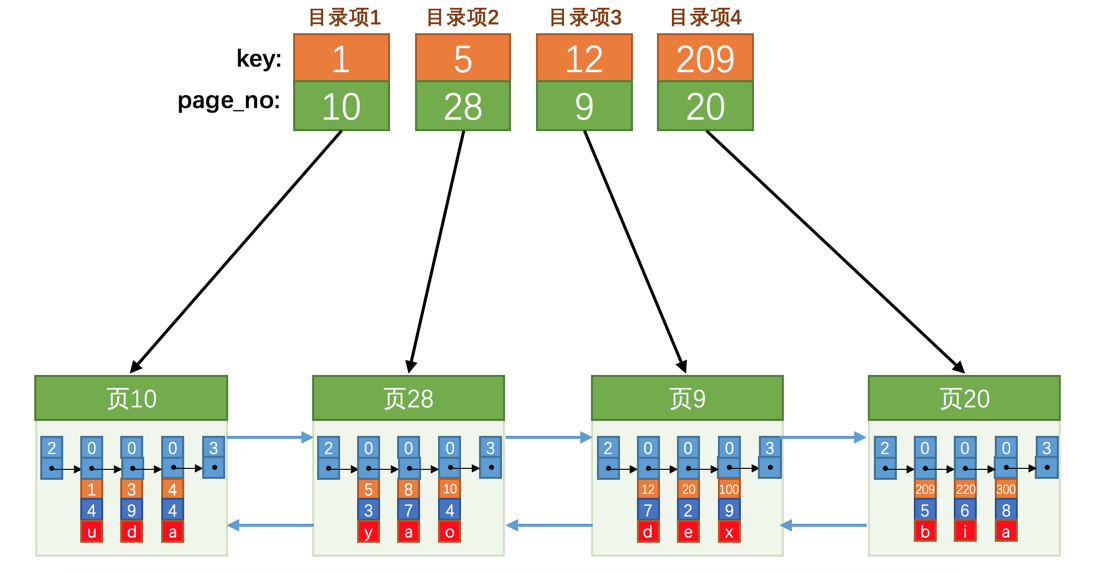

给所有的页建立一个目录项。

这样就能根据主键值快速查找某条记录了。

上面介绍了一个简易粗暴的索引方案,为了在根据主键值进行查找时使用二分法快速定位具体的目录 项而假设所有目录项都可以在物理存储器上连续存储,但是这样做有几个问题:

复用之前存储用户记录的数据页来存储目录项。

用页里的record_type属性区分

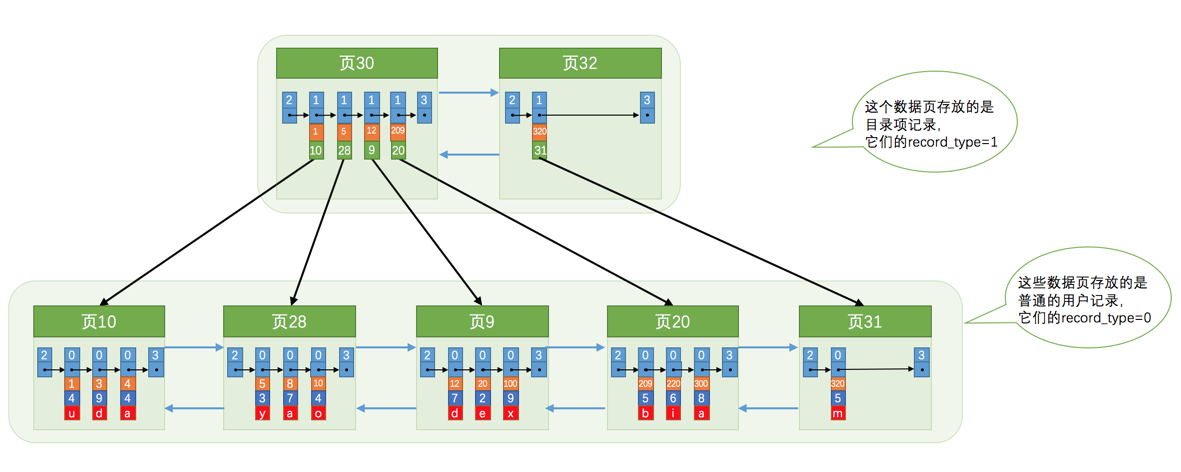

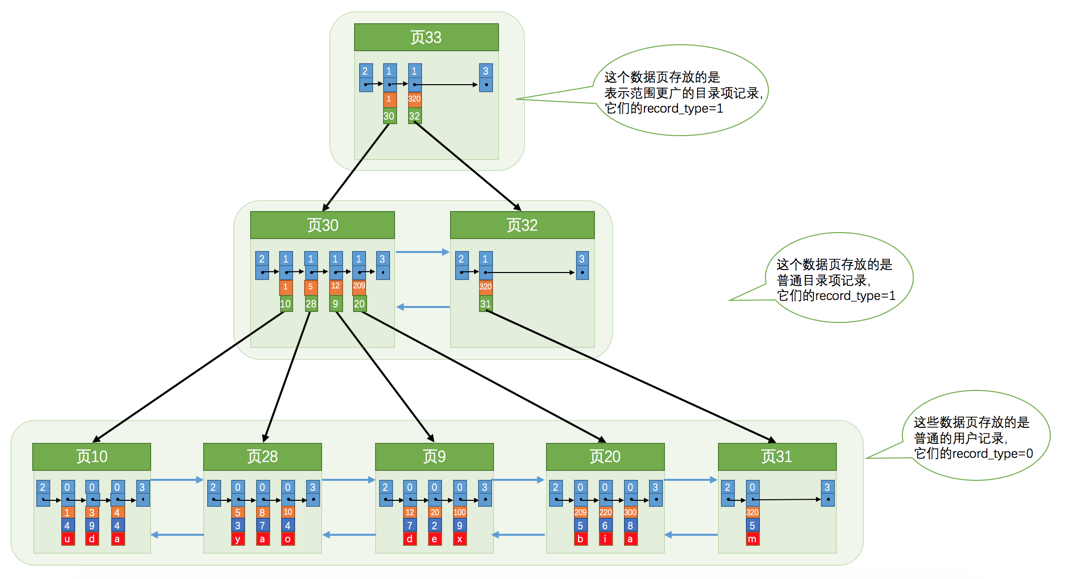

但是随着数据越来越多,目录项记录也太多了,无法支撑快速查找了,能不是在为目录再建立一层索引。

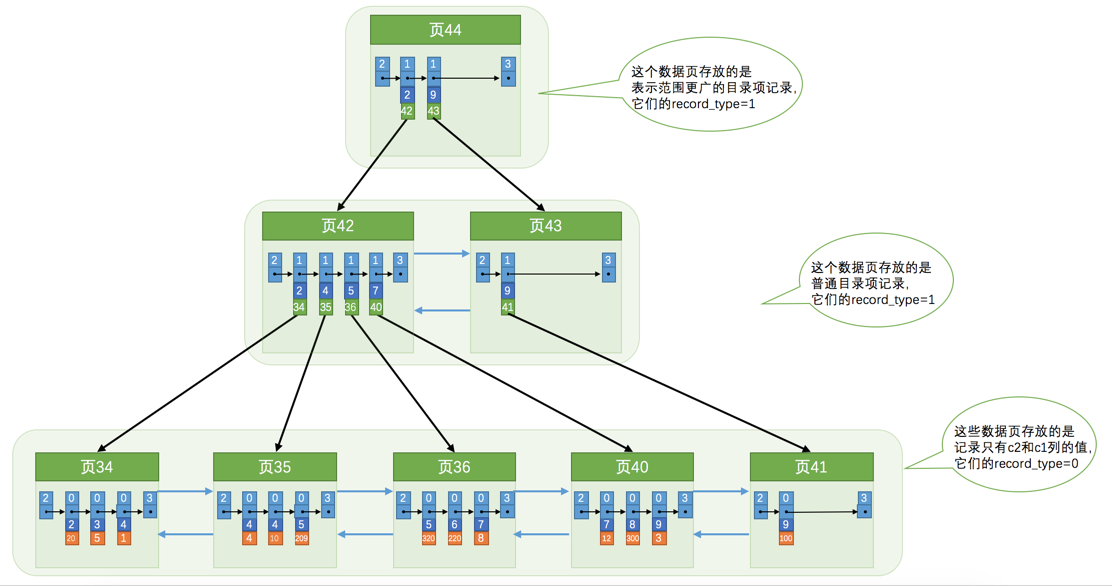

这玩意就是数据结构中的 B+ 树。注意是 B+树 不是 B树。

实际用户记录其实都存放在B+树的最底层的节点上,这些节点也被称为 叶子节点 或 叶节点,其余用来存放目录项的 节点称为 非叶子节点 或者 内节点,其中 B+ 树最上面的节点也称为根节点。

我们来算一下,树层数和能容纳的最大记录量。

存放用户记录的页最多存放3条记录,存放目录项记录的页最多存放4条记录。其实真实环境中一个页存放的记录数量是非常大的。

假设,假设,假设所有存放用户记录的叶子节点代表的数据页可以存放100条用户记录,所有存放目录项记录的内节点代表的数据页可以存放1000条目录项记录,那么:

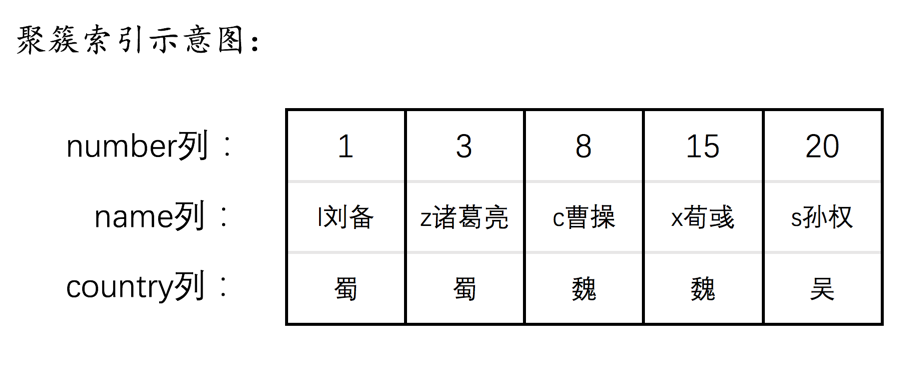

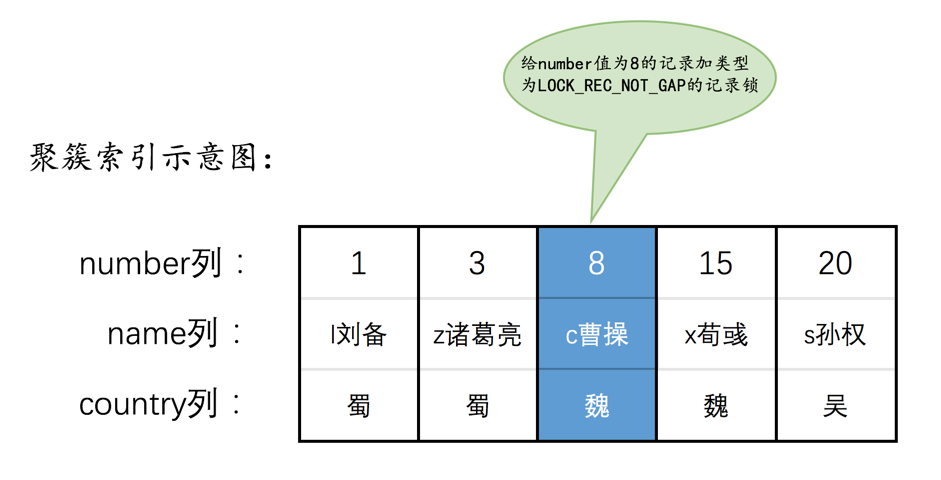

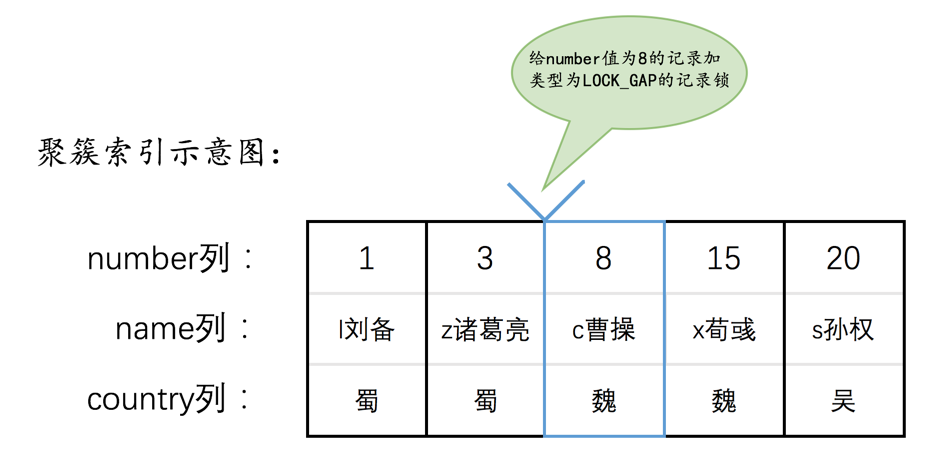

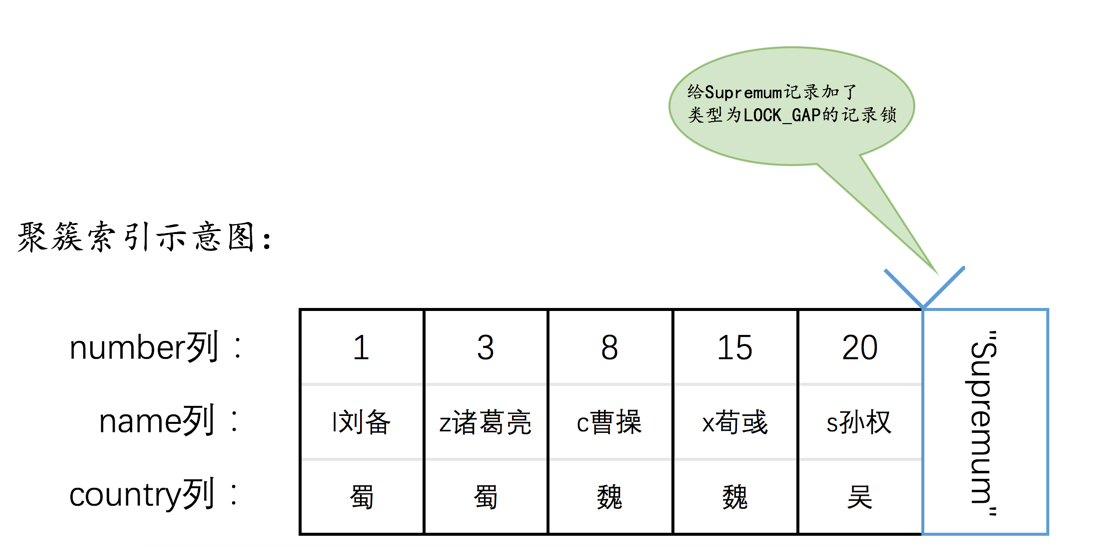

上边介绍的 B+ 树本身就是一个目录,或者说本身就是一个索引。它有两个特点:

我们把具有这两种特性的 B+ 树称为 聚簇索引 ,所有完整的用户记录都存放在这个 聚簇索引 的叶子节点处。

这种聚簇索引并不需要我们在MySQL语句中显式使用INDEX语句去创建。

InnoDB存储引擎会自动地为我们创建聚簇索引。在 InnoDB 存储引擎中, 聚簇索引 就是数据的存储方式(所有的用户记录都存储在了 叶子节点 ),也就是所谓的索引即数据,数据即索引。

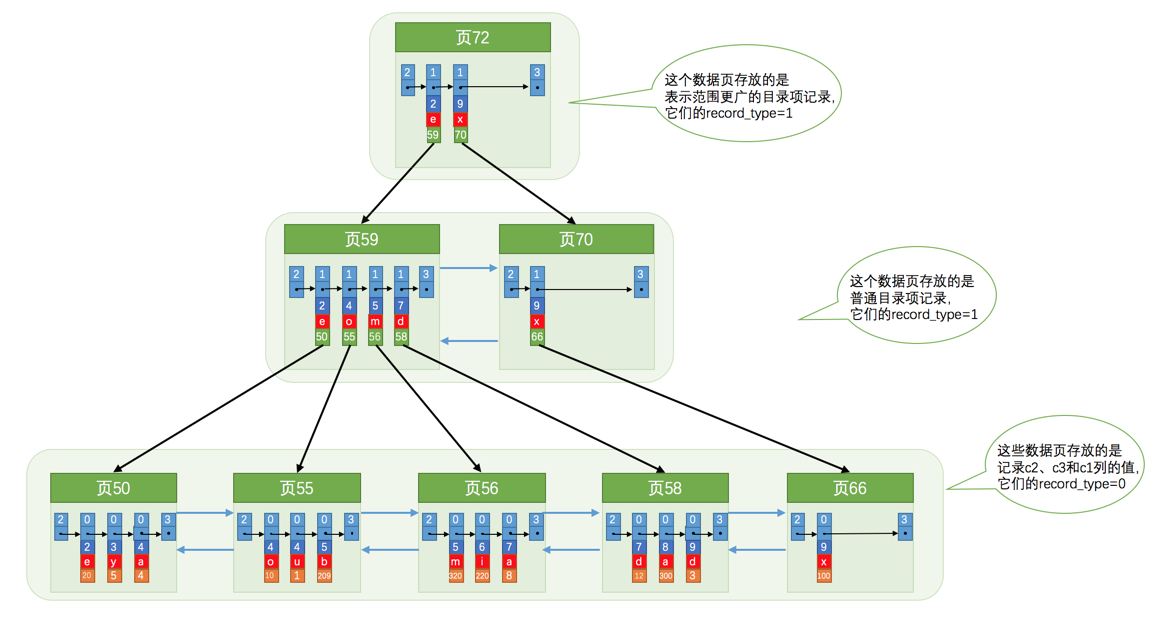

上边地 聚簇索引 只能在搜索条件是主键值时才能发挥作用,其他搜索条件怎么办。

可以多建几棵B+树,不同地B+树中的数据采用不同的排序规则。

数据叶子节点只有,这棵树的排序方式还有主键,没有其他列。

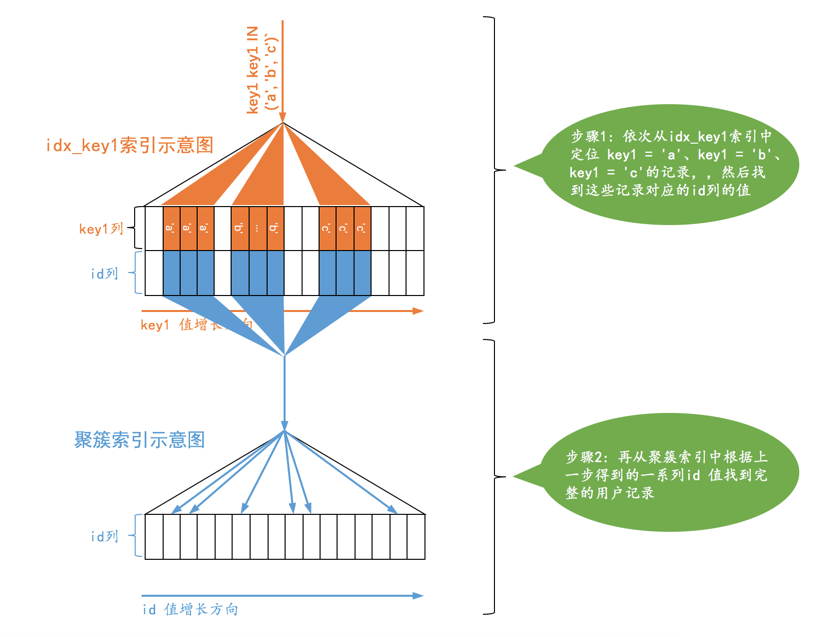

在根据c2查找时,只会查找c2数据对应的主键,然后再拿主键去主键的B+树去查找。

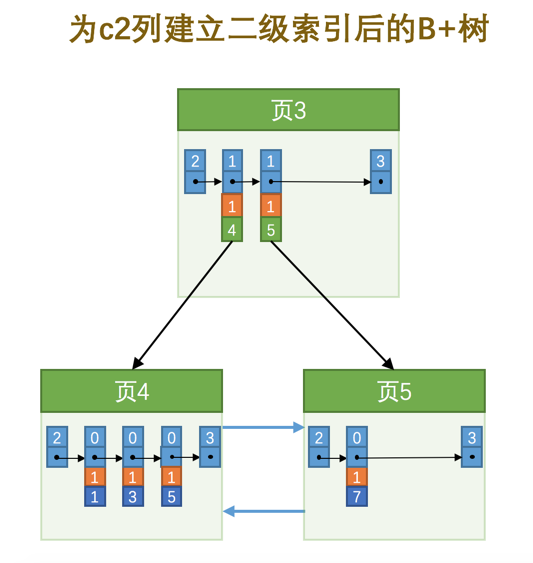

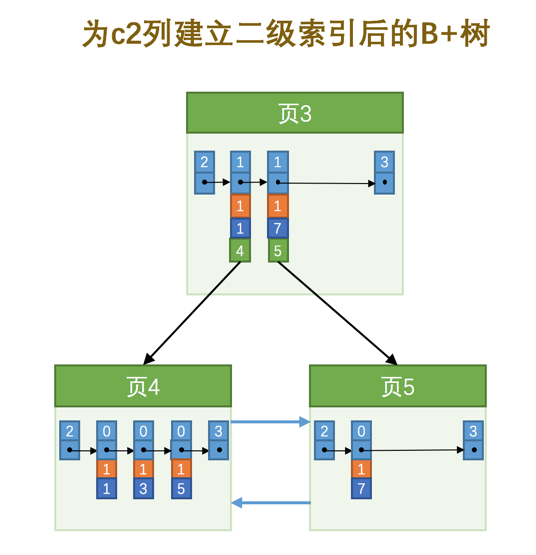

由于使用的是c2列的大小作为B+树的排序规则,所以我们也称这个B+树为 为c2列建立的索引。

也可以同时以多个列的大小作为排序规则,也就是同时为多个列建立索引,比如想让B+树按照c2和c3列的大小排序:

千万要注意一点,以c2和c3列的大小为排序规则建立的B+树称为 联合索引 ,本质上也是一个二级索引。

实际上B+树的形成过程是这样的:

一个B+树索引的根节点自诞生之日起,便不会再移动。这样只要我们对某个表建立一个索引,那么它的 根节点 的页号便会被记录到某个地方,然后凡是 InnoDB 存储引擎需要用到这个索引的时候,都会从那个固定的地方取出 根节点 的页号,从而来访问这个索引。

对于二级索引,只拿 索引列 + 页号 的搭配是不靠谱的。

例如又想插入 9 1 c,该插到 页4还是页5,懵逼了。

为了让新插入记录能找到自己在那个页里,对于二级索引的节点的目录项记录的内容实际上是由三部分组成的

插入时,先把新记录的c2列的值和页3中各目录项记录的c2列值作比较,如果c2相同可以接着比较主键值, 因为B+树同一层中不同目录记录的c2列+主键的值肯定是不一样的,所以最后肯定能定位唯一的一条目录项记录。

InnoDB 的一个数据页至少可以存放两条记录。

聚簇索引的那棵 B+ 树的叶子节点中已经把所有完整的用户记录都包含了,而 MyISAM 的索引方案虽然也使用树形 结构,但是却将索引和数据分开存储:

将表中的记录按照记录的插入顺序单独存储在一个文件中,称之为 数据文件 。这个文件并不划分为若干个 数据页,有多少记录就往这个文件中塞多少记录就成了。我们可以通过行号而快速访问到一条记录。

由于在插入数据的时候并没有刻意按照主键大小排序,所以我们并不能在这些数据上使用二分法进行查找。

使用 MyISAM 存储引擎的表会把索引信息另外存储到一个称为 索引文件 的另一个文件中。 MyISAM 会单独为 表的主键创建一个索引,只不过在索引的叶子节点中存储的不是完整的用户记录,而是 主键值 + 行号 的组 合。也就是先通过索引找到对应的行号,再通过行号去找对应的记录!

这一点和 InnoDB 是完全不相同的,在 InnoDB 存储引擎中,我们只需要根据主键值对 聚簇索引 进行一次查 找就能找到对应的记录,而在 MyISAM 中却需要进行一次 回表 操作,意味着 MyISAM 中建立的索引相当于全 部都是 二级索引。

如果有需要的话,我们也可以对其它的列分别建立索引或者建立 联合索引,原理和 InnoDB 中的索引差不 多,不过在叶子节点处存储的是 相应的列 + 行号 。这些索引也全部都是 二级索引 。

MyISAM中却是索引是索引、数据是数据。

InnoDB和MyISAM会自动为 主键 或 声明为 UNIQUE 的列去自动建立B+树索引,但如果想为其他列建立索引就需要我们 显式的去指明。

每建立一个索引都会建立一棵B+树,每插入一条记录都要维护各个记录、数据页的排序关系,这很费性能和存储空间。

可以在创建表时指定需要建立索引的 单个列 或 建立联合索引的多个列

CREATE TALBE 表名 (

各种列的信息 ··· ,

[KEY|INDEX] 索引名 (需要被索引的单个列或多个列)

)

# 其中的 KEY 和 INDEX 是同义词,任意选用一个就可以。也可以在修改表结构的时候添加索引:

ALTER TABLE 表名 ADD [INDEX|KEY] 索引名 (需要被索引的单个列或多个列);也可以在修改表结构的时候删除索引:

ALTER TABLE 表名 DROP [INDEX|KEY] 索引名;比如在创建 index_demo 表时就为 c2 和 c3 列添加一个联合索引

CREATE TABLE index_demo(

c1 INT,

c2 INT,

c3 CHAR(1),

PRIMARY KEY(c1),

INDEX idx_c2_c3 (c2, c3)

);后续删除这个索引

ALTER TABLE index_demo DROP INDEX idx_c2_c3;虽然索引是个好东西,可不能乱建,如何更好的使用索引之前要了解一下使用它的代价。

空间上的代价

每建立一个索引都要为它建立一棵B+树,每一棵B+树的每一个节点都是一个数据页,一个页默认16KB,一棵很大的B+ 树由许多数据页组成。

时间上的代价

每次对表中的数据进行增删改操作,都需要去修改各个B+树索引。

B+ 树每层节点都是按照索引列的值从小到大的顺序排序而组成了双向链表。不论是叶子节点中的记录,还是内节点中的记录 也就是不论是用户记录还是目录项记录)都是按照索引列的值从小到大的顺序而形成了一个单向链表。

增、删、改操作可能会对节点和记录的排序造成破坏,所以存储引擎需要额外的时间进行一些记录移位,页面分裂、页面回收啥的操作来维护好节点和记录的排序。

一个表上索引建的越多,就会占用越多存储空间,在增删改记录时性能越差。

CREATE TABLE person_info(

id INT NOT NULL auto_increment,

name VARCHAR(100) NOT NULL,

birthday DATE NOT NULL,

phone_number CHAR(11) NOT NULL,

country varchar(100) NOT NULL,

PRIMARY KEY (id),

KEY idx_name_birthday_phone_number (name, birthday, phone_number)

);对于这个 person_info 表:

索引 idx_name_birthday_phone_number 先按照 name 列的值进行排序, 如果name列相同,则按照birthday列值排序,如果birthday列的值也相同则按照phone_number值进行排序。

SELECT * FROM person_info WHERE name = 'Ashburn' AND birthday = '1990-09-27' AND phone_number = '15123983239';你能够想象查询过程,先看name再看birthday再看phone_numer,有疑问,如果WHERE子句中的几个搜索条件顺序对查询结果有影响吗, 调换name、birthday、phone_number

SELECT * FROM person_info WHERE birthday = '1990-09-27' AND phone_number = '15123983239' AND name = 'Ashburn';没什么影响,MySQL有一个查询优化器的东西,会分析这些搜索条件并且按照可以使用的索引中列的顺序来 决定使用哪个搜索条件,后使用哪个搜索条件。

在搜索语句中也可以不用包含全部联合索引中的列,只包含左边的就行

SELECT * FROM person_info WHERE name = 'Ashburn';或者包含多个左边的列也行

SELECT * FROM person_info WHERE name = 'Ashburn' AND birthday = '1990-09-27';如果这样就不行了

SELECT * FROM person_info WHERE birthday = '1990-09-27'; 因为直接看 birthday 索引是无序的,因为先按照name先排的序。

需要特别注意的一点是,如果我们想使用联合索引中尽可能多的列,搜索条件中的各个列必须是联合索引中尽可能多的列,

搜索条件中的各个列必须是联合索引中从左边连续的列,比如联合索引

idx_name_birthday_phone_number 中列的定义顺序是

name、birthday、phone_number

SELECT * FROM person_info WHERE name = 'Ashburn' AND phone_number = '15123983239'; 很不幸这样就只能利用到 name 列的索引,birthday和phone_number的索引就用不上了。

比较字符串大小就用到了该列的字符集和比较规则,所以一个排好序的字符串列其实有这样的特点:

也就是前缀都是排好序的,所以对于字符串类型的索引列来说,我们只匹配它的前缀也是可以快速定位记录的

SELECT * FROM person_info WHERE name LIKE 'As%';如果只给出后缀或者中间的某个字符串,比如这样:

SELECT * FROM person_info WHERE name LIKE '%As%';MySQL就无法快速定位了,只能全表扫描。

有些情况下我们需要思考如果 有一个url列 存了许多url

www.baidu.com

www.google.cn

www.gov.cn检索出com后缀的

WHERE url LIKE '%com';很明显索引会失效,可以优化为逆序存储

moc.udiab.www

moc.elgoog.www

nc.vog.www然后使用前缀匹配

WHERE url LIKE 'moc%';例如

SELECT * FROM person_info WHERE name > 'Asa' AND name < 'Barlow';查询过程是这样的,找到name值为Asa的记录,找到name值为Barlow的记录,所有记录用链表连起来的(记录之间单链表、数据页之间双链表),找到这些记录的主键值,再到 聚簇索引 中回表查找完整记录。

如果对多个列同时进行范围查找,只有对索引最左边的那个列进行范围查找的时候才能用到B+树索引。

SELECT * FROM person_info WHERE name > 'Asa' AND name < 'Barlow' AND birthday > '1980-01-01';birthday索引是失效的,只有name值相同情况下才能用birthday列的值进行排序。

如果左边的列是精确查找,右边列可以进行范围查找

SELECT * FROM person_info WHERE name = 'Ashburn' AND birthday > '1980-01-01' AND birthday

< '2000-12-31' AND phone_number > '15100000000'; 上面的 name、birthday索引都能被利用,phone_number就不行了。

SELECT * FROM person_info WHERE name = 'Ashburn' AND birthday = '1980-01-01' AND AND phone_number > '15100000000';上面的完全利用了,idx_name_birthday_phone_number联合索引。

查询语句经常需要对查询出来的记录通过 ORDER BY 子句按某种规则排序,

一般情况下,需要把记录加载到内存,用排序算法,进行排序,结果集太大还要暂时借助磁盘空间,MySQL中把在内存中或磁盘上进行排序的方式统称为文件排序。

但如果ORDER BY子句里使用到了我们的索引列,就有可能省去在内存或文件中排序的步骤。

SELECT * FROM person_info ORDER BY name, birthday, phone_number LIMIT 10; idx_name_birthday_phone_number,这个B+树索引本身就是按照上述规则排好序的,所以直接从索引中提取数据,然后进行回表取出该索引中不包含的列就好了。

联合索引情况

ORDER BY phone_number, birthday, name上面是用不了B+树索引的,原因很明显。和上面说的WHERE条件差不多。

同理,下面两个就可以

ORDER BY name

ORDER BY name, birthday当联合索引左边列的值为常量,也可以使用后边的列进行排序

SELECT * FROM person_info WHERE name = 'A' ORDER BY birthday, phone_number LIMIT 10;这个查询能使用联合索引进行排序是因为name列的值相同的记录是按照birthday,phone_number排序的。

ASC、DESC混用

B+树索引的排序升序降序规则是一致的,所有字段要升序都升序,要降序都降序。

ORDER BY name, birthday LIMIT 10;上面情况,直接从索引的最左边往右读10行记录就可以了,

ORDER BY name DESC, birthday DESC LIMIT 10,这种情况从索引最右边开始往左读10行记录就可以了。

SELECT * FROM person_info ORDER BY name, birthday DESC LIMIT 10;上面的 name默认是ASC,过程是这样的

先从索引的最左边确定name列最小的值,然后找到name列等于该值的记录,然后从name列等于该值的最右边的那条记录开始往左找10条记录。

如果name列等于最小值的记录不足10条,再继续往右找name值第二小的,重复过程,知道找到10条记录或找完所有记录位置。

WHERE子句中出现了非排序使用到的索引列

SELECT * FROM person_info WHERE country = 'China' ORDER BY name LIMIT 10;这个查询只能将 country='China'

记录提取出来再进行排序。

但下面的可以正确利用索引

SELECT * FROM person_info WHERE name = 'A' ORDER BY birthday, phone_number LIMIT 10; 排序列包含非同一个索引的列

有时候用来排序的多个列不是一个索引里的,这种情况也不能使用索引进行排序

SELECT * FROM person_info ORDER BY name, country LIMIT 10; 排序列使用了复杂的表达式

这很明显根本没法利用索引,使用了UPPER函数修饰过的列就不是单独的列了。

SELECT * FROM person_info ORDER BY UPPER(name) LIMIT 10;对表中的记录按某些列进行分组

SELECT name, birthday, phone_number, COUNT(*) FROM person_info GROUP BY name, birthday, phone_number;这也和 WHERE、ORDER BY 什么时候正确利用 B+树 索引差不多。

SELECT * FROM person_info WHERE name > 'Asa' AND name < 'Barlow';从二级索引idx_name_birthday_phone_number 中检索主键时很快就行检索出来,因为是顺序I/O。

但是用拿到的一些主键去聚簇索引那记录时,就变成了随机IO。

需要回表的记录越多,使用二级索引的性能就越低,甚至让某些查询宁愿使用全表扫描也不适用二级索引。

什么时候采用全表扫描,什么时候使用二级索引+回表,这就是查询优化器做得工作,查询优化器会事先对表中的记录计算一些统计数据,然后再利用这些统计数据根据查询的条件来计算一下需要回表的记录数,需要回表的记录数越多,就越倾向于使用全表扫描,反之倾向于使用 二级索引 + 回表 的方式。

SELECT * FROM person_info WHERE name > 'Asa' AND name < 'Barlow' LIMIT 10; 添加了 LIMIT 10 的查询更容易让优化器采用 二级索引 + 回表 的方式进行查询。

对于有排序需求的查询

SELECT * FROM person_info ORDER BY name, birthday, phone_number;由于查询列表是 *

,所以如果使用二级索引进行排序的话,需要把排序完的二级索引记录全部进行回表操作,这

样操作的成本还不如直接遍历聚簇索引然后再进行文件排序( filesort

)低,所以优化器会倾向于使用 全表扫 描 的方式执行查询。

SELECT name, birthday, phone_number FROM person_info WHERE name > 'Asa' AND name < 'Barlo w';上面的结果字段都在 idx_name_birthday_phone_number中,通过二级索引就能拿到全部字段,不必再回表了。

同样排序操作也优先使用 覆盖索引 的方式进行查询

SELECT name, birthday, phone_number FROM person_info ORDER BY name, birthday, phone_number;在建立索引时或编写查询语句时应该注意的一些事项。

只为出现在WHERE中子句中的列、连接子句中的连接列,或者出现在ORDER BY或GROUP BY子句中的列创建索引, 而出现在查询列表中的列就没必要建立索引了。

SELECT birthday, country FROM person_info WHERE name='Ashbrun';像查询列表中的birthday、country这两列就不需要建立索引了。

列的基础 指的是某列中不重复数据的个数,比如说某个列包含值 2,5,8,2,5,8,2,5,8 虽然有9条记录,但该列的基数是3.

在记录行数一定的情况下,列的基数越大,该列的值越分散,列的基数越小,该列中的值越集中。

假设某个列的基数为 1 ,也就是所有记录在该列中的值都一样,那为该列建立索引是没有用的,因为所有值都一样就无法排序,无法进行快速查找了。

而且如果某个建立了二级索引的列的重复值特别多,那么使用这个二级索引查出的记录还可能要做回表操作,这样性能损耗就更大了。

结论:最好为那些列的基数大的列建立索引,为基数太小列的建立索引效果可能不好。

数据类型越小,在查询时进行的比较操作越快,能用 TINYINT存得下得就不用 MEDIUMINT,能用 INT的就不用BIGINT

数据类型越小,索引占用的空间越少,在一个数据页内可以放下更多的记录,减少磁盘I/O带来的性能损耗,意味着可以把更多的数据页缓存在内存中,加快读写效率。

这个建议对表的主键更加使用,不仅是聚簇索引中会存储主键值,其他所有的二级索引的节点处都会存储一份记录的主键值。

字符串列,字符串长度可能非常长,只在B+树中存储字符串的前几个字符的编码,既节约空间,又减少了字符串的比较时间, 还能大概解决排序的问题,何乐而不为

CREATE TABLE person_info(

name VARCHAR(100) NOT NULL,

birthday DATE NOT NULL,

phone_number CHAR(11) NOT NULL,

country varchar(100) NOT NULL,

KEY idx_name_birthday_phone_number (name(10), birthday, phone_number)

);name(10)就表示在建立的B+树索引中只保留记录的前10个字符的编码,这种只索引字符串值前缀的策略是非常鼓励的,尤其是字符串类型能存储的字符比较多的时候。

索引列前缀对排序的影响

如果使用了索引列前缀,比如之前把name列的前10个字符放到了二级索引中,下面查询就尴尬了

SELECT * FROM person_info ORDER BY name LIMIT 10;因为二级索引中不包含完整的name列信息,无法对前十个字符相同,后面的字符不同的记录进行排序。

假设表中有一个整数列 my_col,我们为这个列建立了索引,下面两个WHERE子句虽然语义是一致的,但效率上却有差别

WHERE my_col * 2<4

WHERE my_col < 4/2第一个,my_col列不是以单独列形式出现的,无法使用索引,第二个可以。

InnoDB,表中的数据实际上都存在聚簇索引的叶子节点,而记录又是存储在数据页中,数据页和记录又是按照记录主键值从小到大顺序进行排列,

如果插入的记录的主键值依次增大,没插满一个数据页就换到下一个数据页继续插,如果插入的主键值忽大忽小,就比较麻烦。

依次增大,插入效率比较高,可以让主键具有 AUTO_INCREMENT ,让存储引擎自己为表生成主键,而不是我们手动插入。

例如

CREATE TABLE person_info(

id INT UNSIGNED NOT NULL AUTO_INCREMENT,

name VARCHAR(100) NOT NULL,

birthday DATE NOT NULL,

phone_number CHAR(11) NOT NULL,

country varchar(100) NOT NULL,

PRIMARY KEY (id),

KEY idx_name_birthday_phone_number (name(10), birthday, phone_number)

);有时候有意或无意的就对同一个列创建了多个索引,比如

CREATE TABLE person_info(

id INT UNSIGNED NOT NULL AUTO_INCREMENT,

name VARCHAR(100) NOT NULL,

birthday DATE NOT NULL,

phone_number CHAR(11) NOT NULL,

country varchar(100) NOT NULL,

PRIMARY KEY (id),

KEY idx_name_birthday_phone_number (name(10), birthday, phone_number),

KEY idx_name (name(10))

);很明显name列索引冗余了,维护这个索引只会增加维护成本,并不会对搜索有什么好处。

CREATE TABLE repeat_index_demo (

c1 INT PRIMARY KEY,

c2 INT,

UNIQUE uidx_c1 (c1),

INDEX idx_c1 (c1)

);c1既是主键、又给它定义为一个唯一索引,还给它定义了一个普通索引,可主键本身就会生成聚簇索引,所以定义的唯一索引和普通索引是重复的,这种情况要避免。

InnoDB、MyISM存储引擎把表存储在磁盘上,而操作系统用来管理磁盘的东西叫 文件系统。

InnoDB、MyISAM存储引擎把表存储在文件系统上。

MySQL服务器程序启动时回到文件系统某个目录加载一些文件,之后运行过程产生的数据也存储在那个目录下的某些文件, 这个目录就称为 数据目录。

安装目录:下非常重要的bin目录,存储着许多关于控制客户端程序和服务器程序的命令,如 mysql、mysqld、mysqld_safe等。

数据目录:用来存储MySQL在运行过程中产生的数据。

通过系统变量查看。当然你用Docker容器数据到底存在哪里那就是另一回事了。

mysql> SHOW VARIABLES LIKE 'datadir';

+---------------+-----------------+

| Variable_name | Value |

+---------------+-----------------+

| datadir | /var/lib/mysql/ |

+---------------+-----------------+

1 row in set (0.098 sec)

mysql> 当使用CREATE DATABASE 创建一个数据库时,每个数据库都对应数据目录下的一个子目录

bash-5.1# pwd

/var/lib/mysql

bash-5.1# ls

'#ib_16384_0.dblwr' auto.cnf ca-key.pem dbname mysql performance_schema server-key.pem

'#ib_16384_1.dblwr' binlog.000001 ca.pem ib_buffer_pool mysql.ibd private_key.pem sys

'#innodb_redo' binlog.000002 client-cert.pem ibdata1 mysql.sock public_key.pem undo_001

'#innodb_temp' binlog.index client-key.pem ibtmp1 mysql_upgrade_history server-cert.pem undo_002我有一个 名字为 dbname 的数据库,其下面有一个dbname的文件夹。

数据都是以记录的形式插入到表中的,每个表的信息其实可以分为两种:

表结构:如表名、表里多少列、每列数据类型、约束条件、索引、字符集、比较规则等等。

具体存在哪里,版本不同答案也不同,这些不用关心,了解就好了。

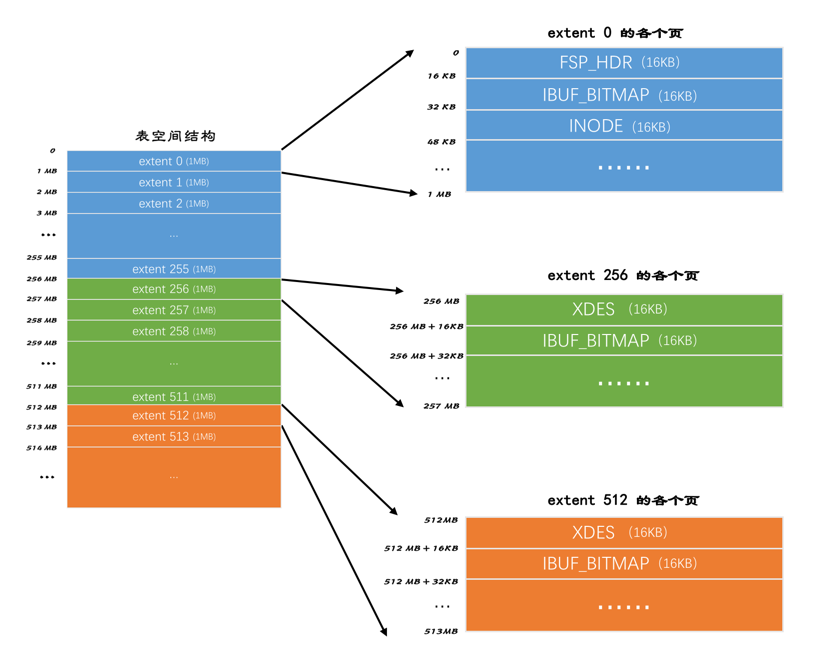

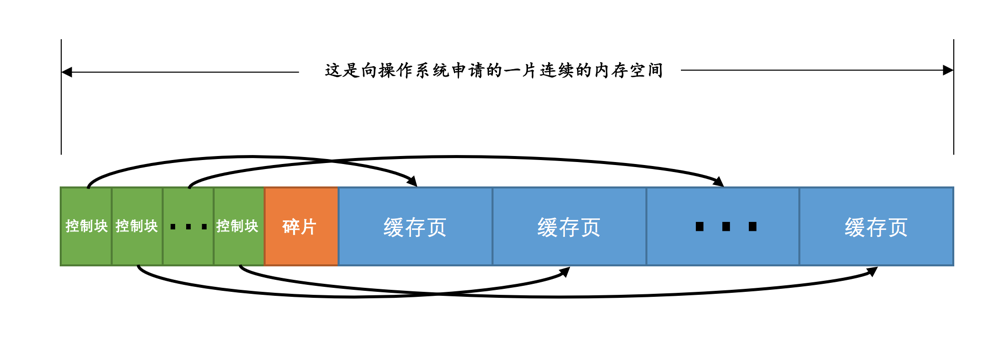

InnoDB使用页为基本单位来管理存储空间,默认页大小为16KB。

回顾一下前面内容:

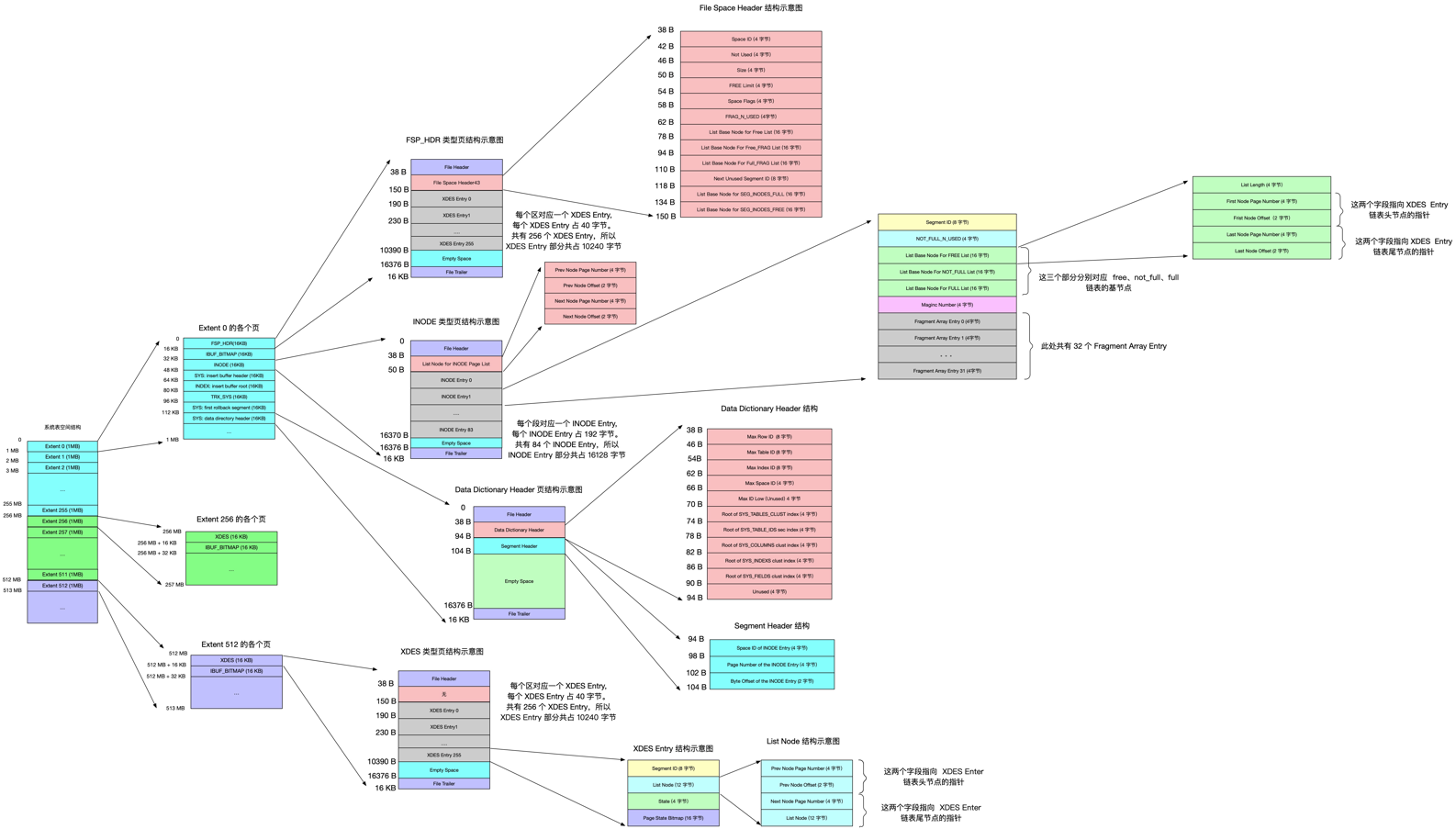

InnoDB提出了一个 表空间 或 文件空间 的概念。

每一个表空间可以划分为很多很多页,表数据就存放在某个 表空间 下的某些页里。

系统表空间

数据目录下有一个名为 ibdata1 的文件,就是对应的 系统表空间 在文件系统上的表示。

独立表空间

在MySQL5.6.6之后,InnoDB不会默认把各个表数据存在系统表空间,而是每个表建立一个独立表空间,

在数据库目录下有表对应的.ibd文件。

bash-5.1# cd dbname

bash-5.1# ls

dbuserrecord.ibd这些表空间可以转换,把表从系统表空间移到独立表空间、从独立表空间移到系统表空间。

除了上面两种表空间,还有一些 如 通用表空间、undo表空间、临时表空间 等等。

MyISAM中的索引全部都是二级索引,该存储引擎的数据和索引是分开存放的,在文件系统中使用不同的文件来存储数据文件和索引文件。

MyISAM并没有所谓的表空间,表数据都存到数据库子目录下

如有个test表

test.frm test.MYD(数据文件) test.MYI(索引文件)MYSQL中的视图是虚拟的表,也就是某个查询语句的别名而已,存储视图时不需要存储真实数据,只需要 把其结构存储起来。描述视图结构的文件会被存在所属数据库对应的子目录下 视图名.frm 问文件。

如服务器进程文件存进程PID、服务器日志文件 如查询日志、错误日志、二进制日志、redo日志等等。

默认、自动生成的SSL和RSA证书和密钥文件。

MySQL数据都是存在文件系统中的,不得不受文件系统的一些制约,在数据库和表命名、表的大小和性能方面体现比较明显。

MySQL的几个系统数据库,

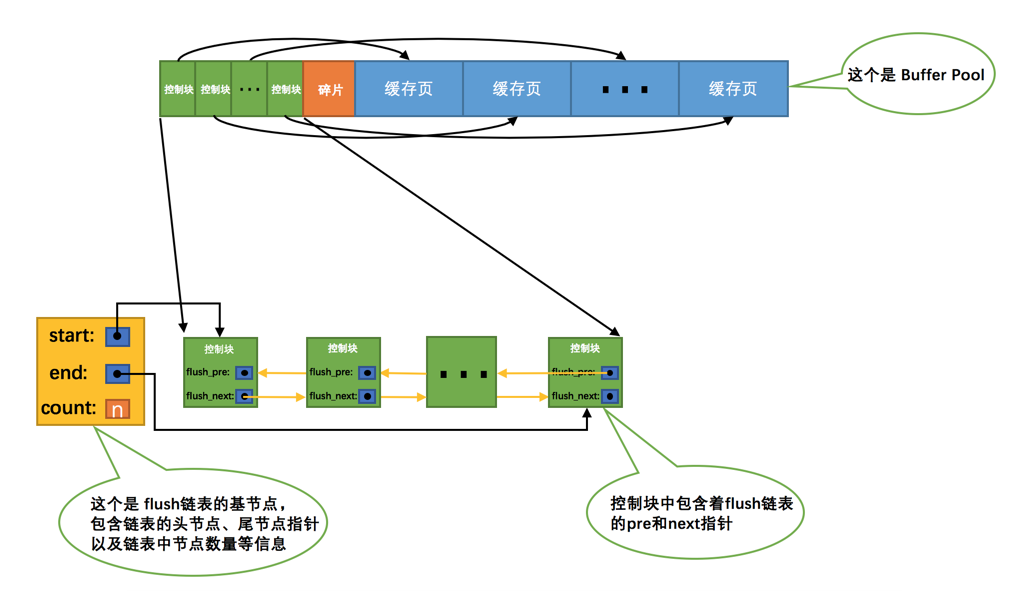

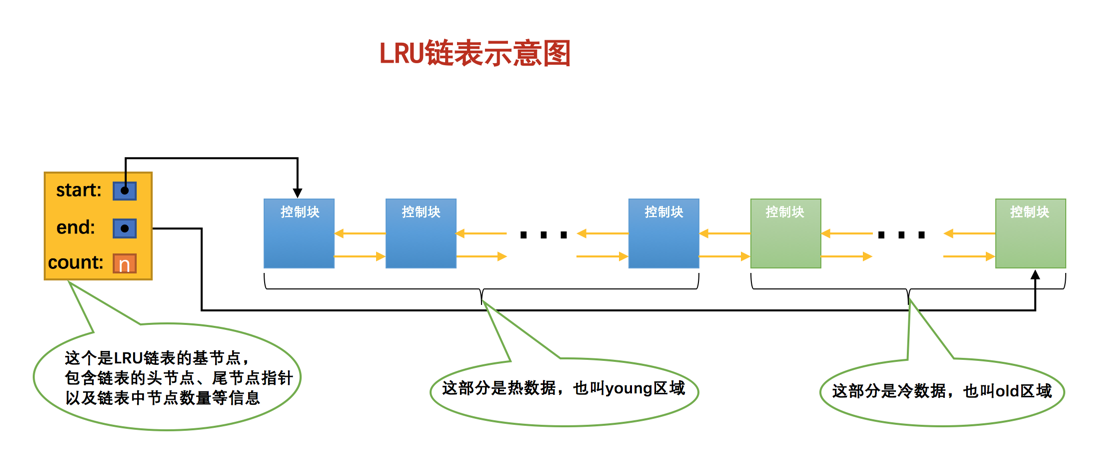

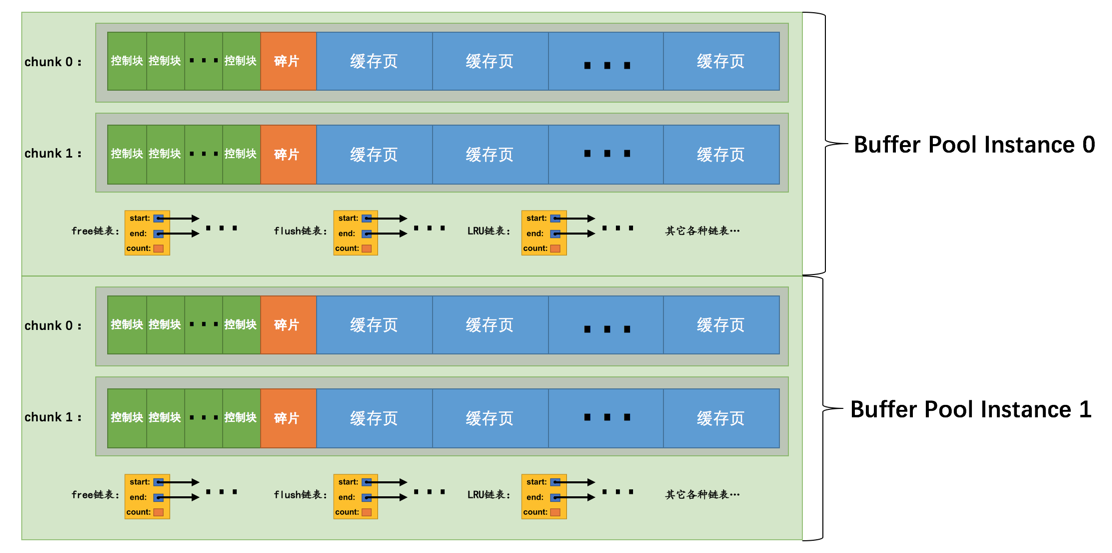

可以把表空间想象成被切分为许许多多页的池子,想为某个表插入一条记录的时候,就从池子中捞出一个对应的页把数据写进去。

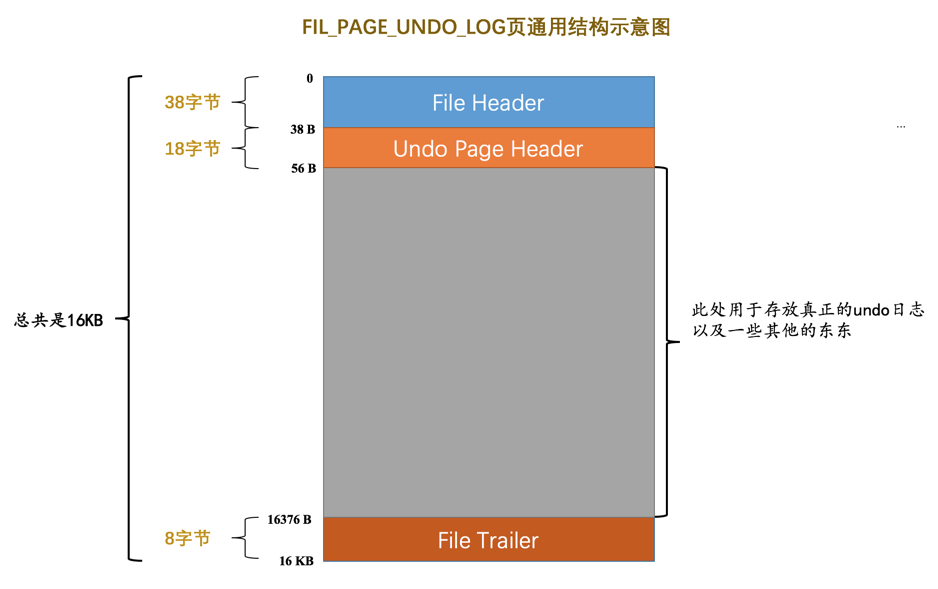

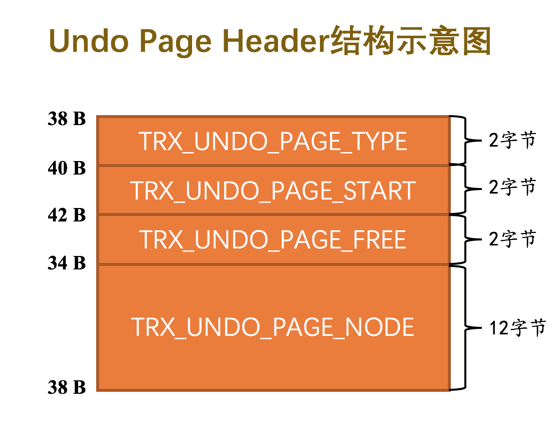

| 描述 | 数值 | 用途 |

|---|---|---|

| FIL_PAGE_TYPE_ALLOCATED | 0x000 | 最新分配,还没使用 |

| FIL_PAGE_UNDO_LOG | 0x0002 | Undo日志页 |

| FIL_PAGE_INODE | 0x0003 | 段信息节点 |

| FIL_PAGE_IBUF_FREE_LIST | 0x0004 | Insert Buffer空闲列表 |

| FIL_PAGE_IBUF_BITMAP | 0x0005 | Inser Buffer位图 |

| FIL_PAGE_TYPE_SYS | 0x0006 | 系统页 |

| FIL_PAGE_TYPE_TRX_SYS | 0x0007 | 事务系统数据 |

| FIL_PAGE_TYPE_FSP_HDR | 0x0008 | 表空间头部信息 |

| FIL_PAGE_TYPE_XDES | 0x0009 | 扩展描述页 |

| FIL_PAGE_TYPE_BLOB | 0x000A | BLOB页 |

| FIL_PAGE_INDEX | 0x45BF | 索引页 |

INDEX类型的页由7部分组成,其中的两个部分任何类型的页都会包含

FileHeader:

| 名称 | 占用空间大小 | 描述 |

|---|---|---|

| FIL_PAGE_SPACE_OR_CHKSUM | 4 字节 | 页的校验和(checksum值) |

| FIL_PAGE_OFFSET | 4 字节 | 页号 |

| FIL_PAGE_PREV | 4 字节 | 上一个页的页号 |

| FIL_PAGE_NEXT | 4 字节 | 下一个页的页号 |

| FIL_PAGE_LSN | 8 字节 | 页面被最后修改时对应的日志序列位置(英文名是:Log SequenceNumber) |

| FIL_PAGE_TYPE | 2 字节 | 该页的类型 |

| FIL_PAGE_FILE_FLUSH_LSN | 8 字节 | 仅在系统表空间的一个页中定义,代表文件至少被刷新到了对应的LSN值 |

| FIL_PAGE_ARCH_LOG_NO_OR_SPACE_ID | 4 字节 | 页属于哪个表空间 |

一个表空间最多可以拥有2的32次方个页,如果按照页默认16KB、一个表空间最多支持64TB的数据。

表空间中页很多,为更好管理这些页,InnoDB提出 区(extent)的概念,连续的64个页就是一个区,,一个区默认占用1MB大小。

每256个区为一组。

为了解决在B+树链表中相邻的两个页的物理位置离得非常远,就是所谓的随机I/O,随机I/O是非常慢的,应尽量让链表中相邻的页物理位置也相邻,尽可能的顺序I/O,为此引入了区的概念。

为某个索引分配空间的时候就不再按照页为单位分配了,而是按照 区 为单位分配,甚至在表中的数据十分非常特别多的时候,可以一次性分配多个连续的区。

如果不区分叶子节点和非叶子节点,统统把节点代表的页面放到申请到的区中的话,范围查询进行范围扫描的效果就大打折扣了。

叶子节点有自己独有的 区 ,非叶子节点也有自己独有的 区 。存放叶子节点的区的集合就算是一个 段 ( segment ),存放非叶子节点的区的集合也算是一个 段 。也就是说一个索引会生成2个段,一个叶子节点段,一个非叶子节点段。

具体来说,B+树中会分配两个不同的段:

叶子节点段:专门存储叶子节点的区。

非叶子节点段:专门存储非叶子节点的区。

这两个段分别用于存储不同类型的索引节点,使得数据的存储更加高效,尤其是在进行范围扫描时,可以减少不必要的随机I/O。

除了叶子节点和非叶子节点段,还有“碎片区”。碎片区是存储一些不连续或者不常用的数据块区域,通常用于处理空间未被充分利用的情况。

大体可分为4类:

InnoDB为这4种状态的区定义了特定的名词

|状态名|含义| |FREE|隶属于表空间 空闲的区| |FREE_FRAG|隶属于表空间 有剩余空间的碎片区| |FULL_FRAG|隶属于表空间 没有剩余空间的碎片区| |FSEG|隶属于段 附属于某个段的区|

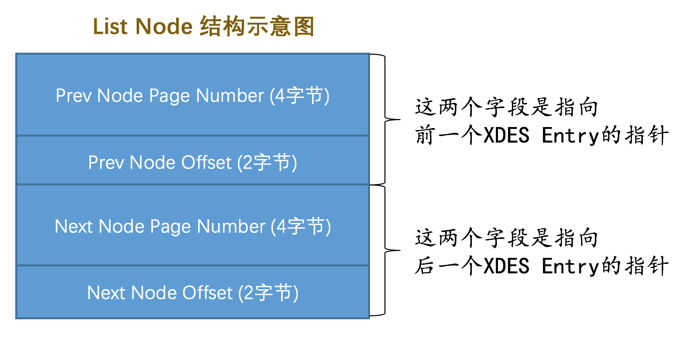

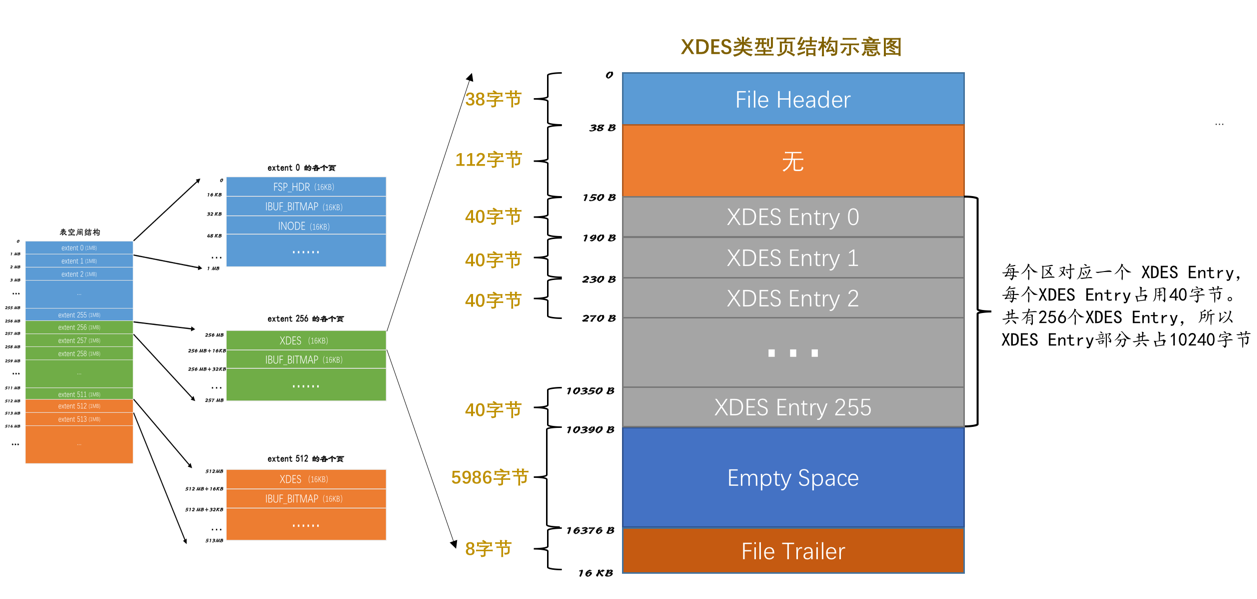

表空间<-段<-区<-页为了方便管理这些区,InnnoDB设计了XSES Entry(Extent Descriptor Entry),每个区都对应着一个XDES Entry结构,

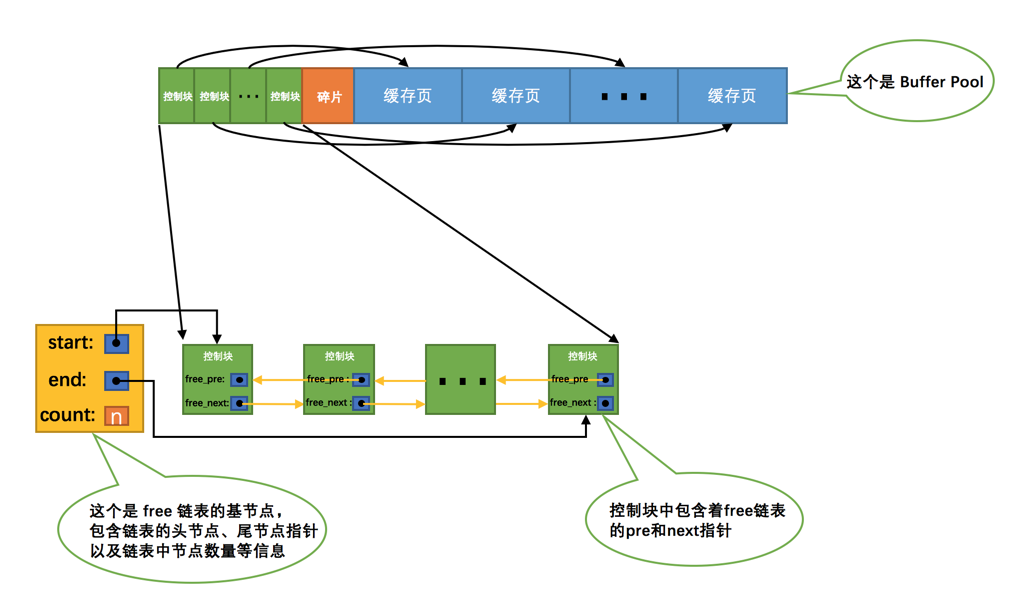

表空间会拉三个链表,

InnoDB为每个段的区对应的XDES Entry结构也建立了三个链表

每一个索引都对应两个段,每个段都会维护上述的3个链表

CREATE TABLE t (

c1 INT NOT NULL AUTO_INCREMENT,

c2 VARCHAR(100),

c3 VARCHAR(100),

PRIMARY KEY (c1),

KEY idx_c2 (c2)

)ENGINE=InnoDB;这个表有两个索引,一个聚簇索引、一个二级索引idx_c2,这个表共有4个段。每个段维护3个链表,整个独立表空间共需要维护15个链表。

优先找NOT_FULL的,用完了将其移到FULL链表中。

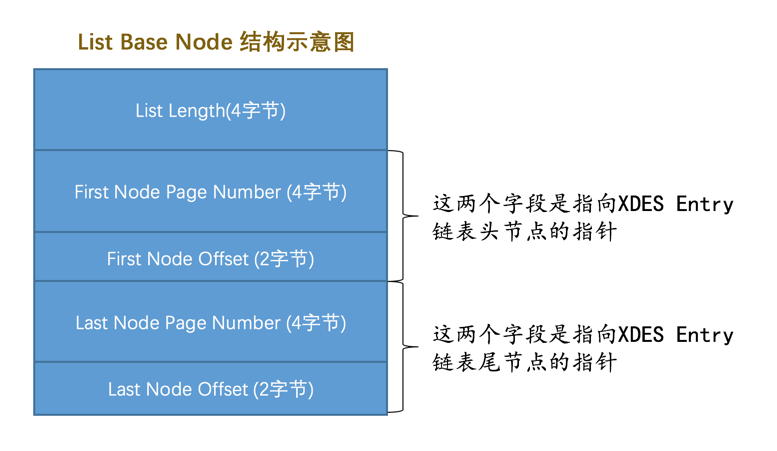

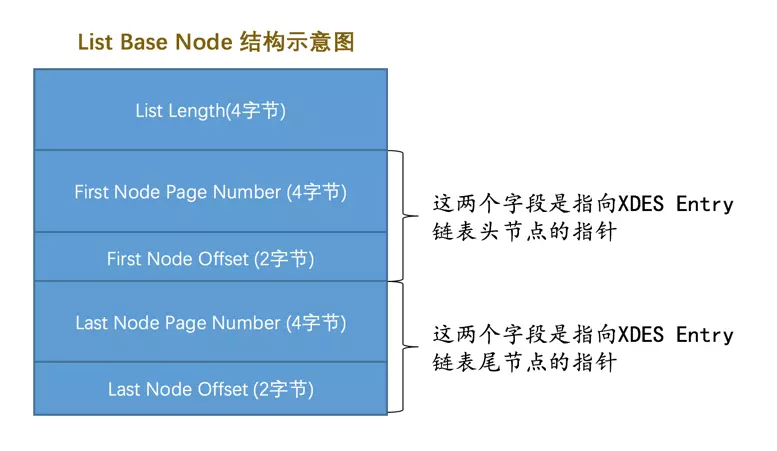

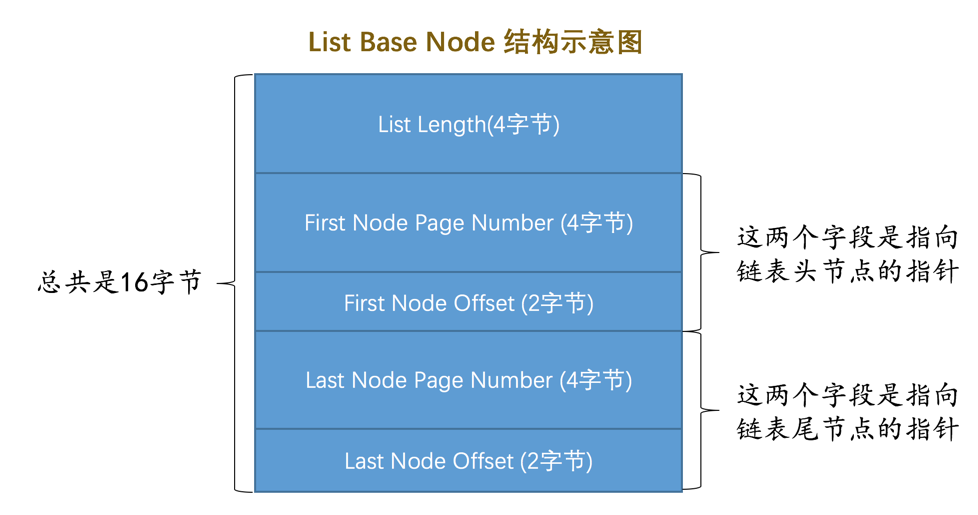

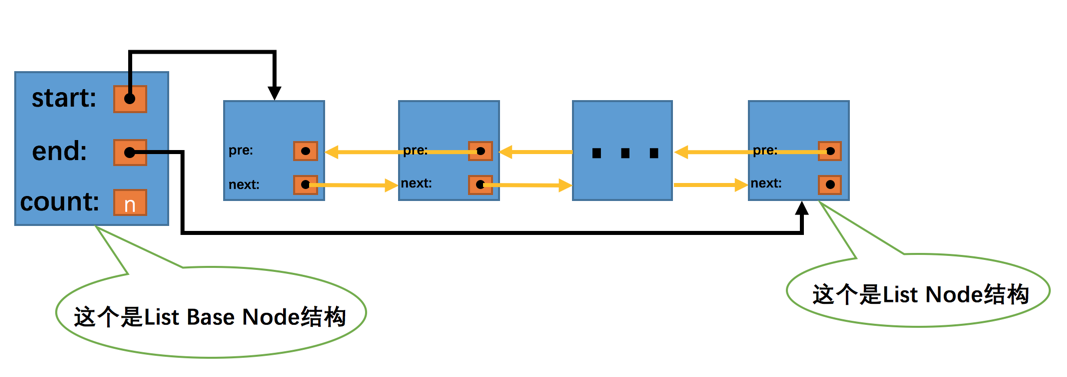

链表基节点

为了找到这些链表的头节点或尾节点,InnoDB设计了 List Base Node的结构。

结构里记录了链表的头、尾节点的位置以及链表中包含的节点数。

段不对应表空间中某一个连续的物理空间,而是一个逻辑上的概念,由若干个零散的页面以及一些完整的区组成。

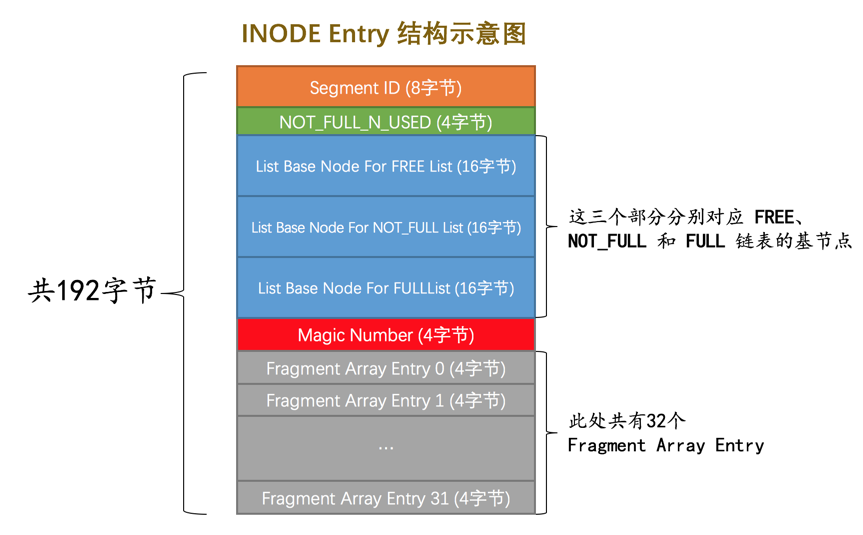

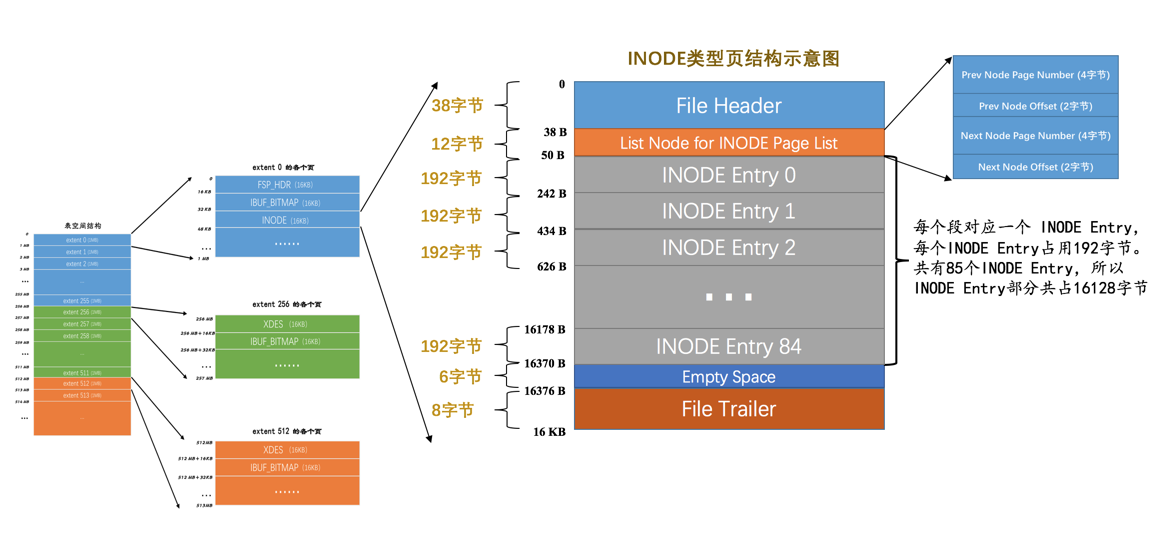

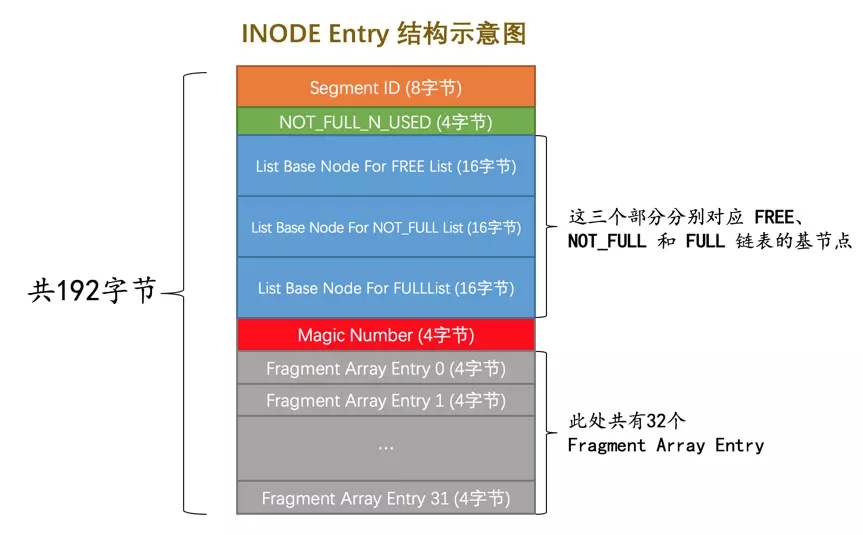

InnoDB为每个段都定义了一个INODE Entry记录段中属性。

它的各个部分解释

现在清楚了 表空间、段、区、XDES Entry、INODE Entry、各种以XDES Entry为节点的链表。

每个区对应的XDES Entry结构存储在表空间什么地方。上面看过段内的,区内也有相关

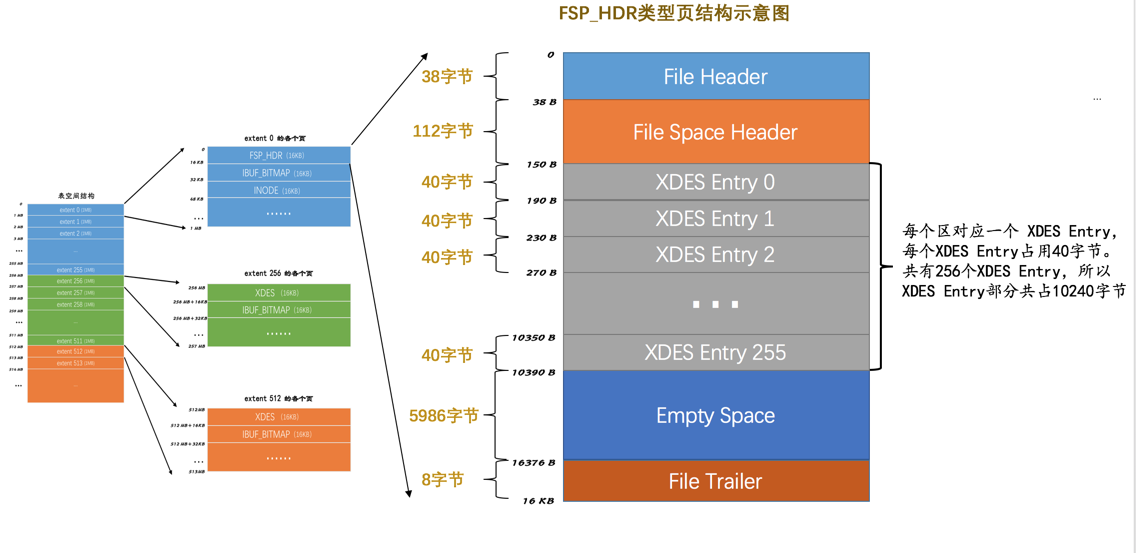

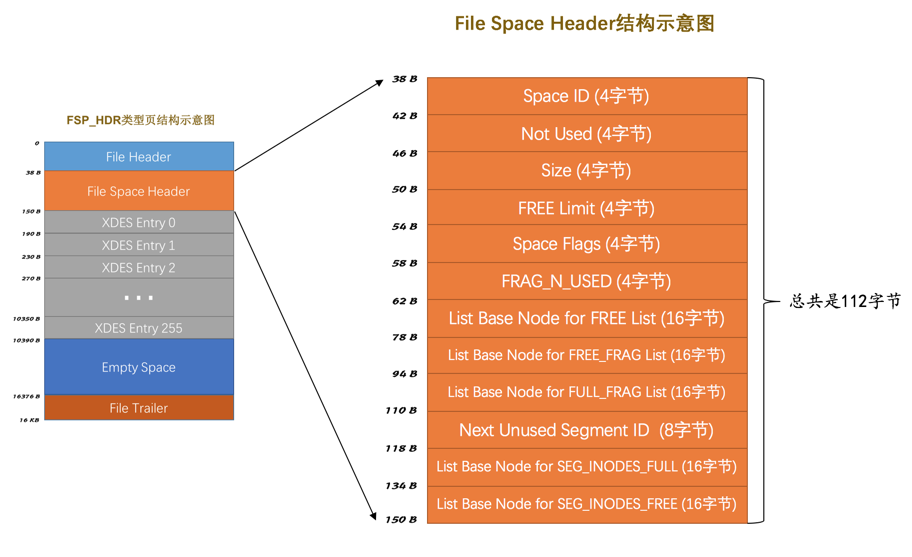

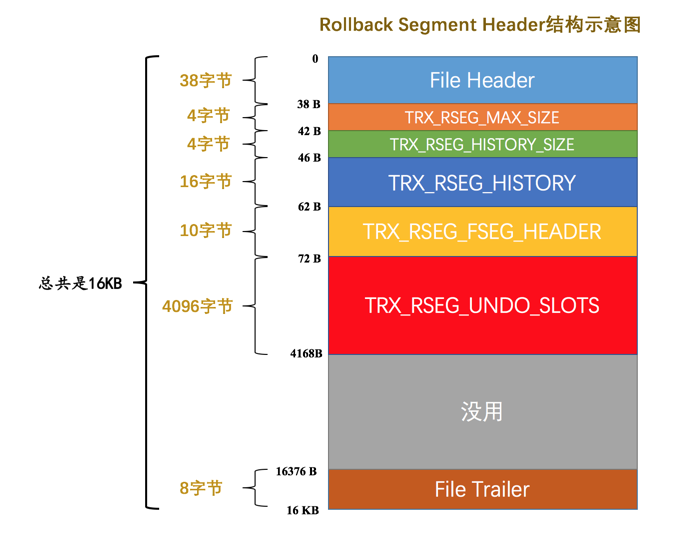

FSP_HDR 页处在表空间第一个页,它存储了表空间的一些整体属性以及组内256个区的对应XDESEntry

XDES Entry部分

XDESC Entry0对应 extent 0, XDES Entry 1对应 extent 1 以此类推。

表空间的区分为了若干个组,每组开头的一个页面记录着本组内所有的区对应的 XDES Entry 结构。

第一组第一个页面有些特殊,除了记录本组中的所有区对应XDES Entry外,还记录其他内容 就是 FSP_HDR 类型。

除去第一个分组以外,之后的每个分组的第一个页面只需要记录本组内所有的区对应的 XDES Entry 结构即可。

IBUF_BITMAP 类型

每组第二个页面都是IBUF_BITMAP

INODE 类型

第一个分组的第三个页面类型是INODE,每个段设计了一个INODE Entry结构

InnoDB将 INODE类型页面串成两个不同链表:SEG_INODES_FULL 链表:该链表中的 INODE 类型的页面中已经没有空闲空间来存储额外的 INODE Entry 结构了。 SEG_INODES_FREE 链表:该链表中的 INODE 类型的页面中还有空闲空间来存储额外的 INODE Entry 结构. 这两个链表的基节点就存储在 File Space Header 里边,这两个链表的基节点的位置是固定的。

创建一个段时,都会创建一个INODE Entry结构与之对应。

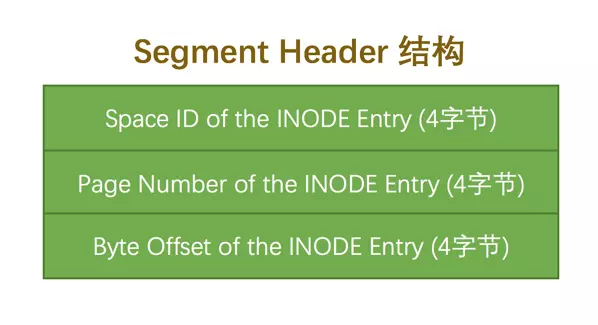

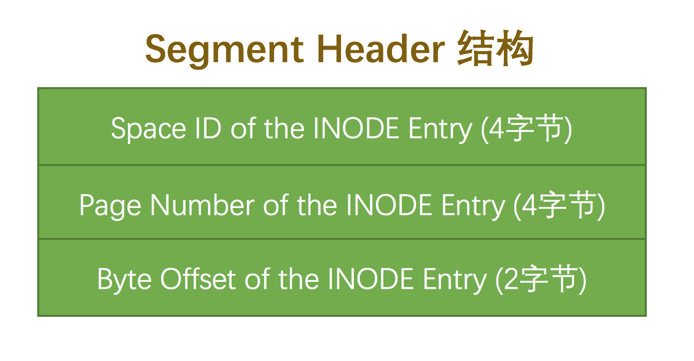

Segment Header结构

Space ID of the INODE Entry 4字节

Page Number of the INODE Entry 4字节

Bytes Offset of the INODE Entry 2字节跳过 Segment Header结构的运用

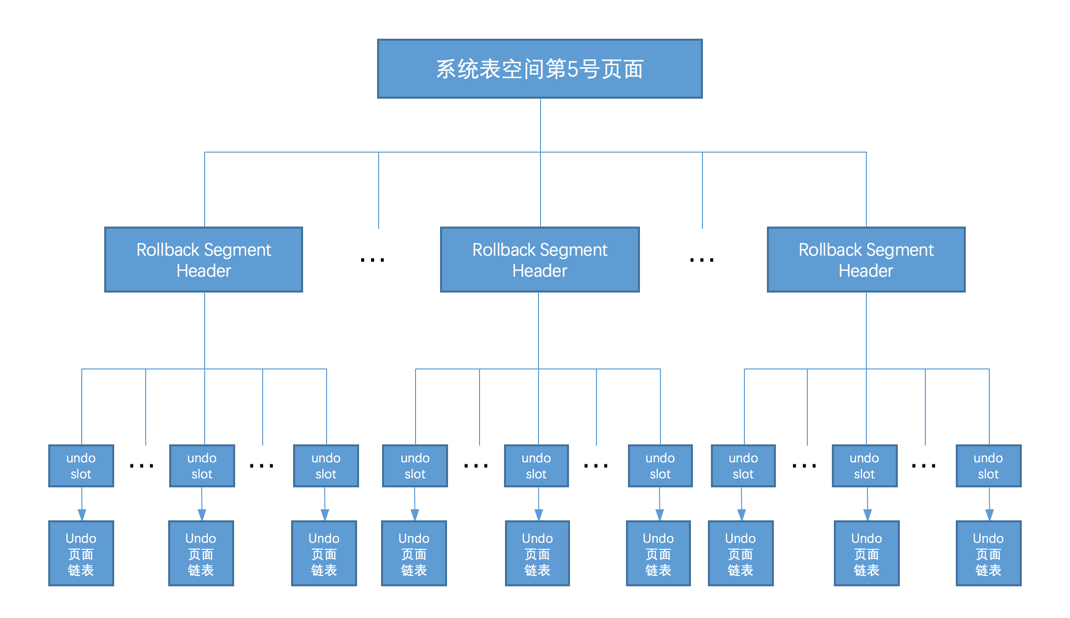

MySQL 中的 系统表 是存储在 系统表空间 上的,尤其是在 InnoDB 存储引擎下。

整个MySQL进程只有一个系统表空间,在系统表空间中会额外记录一些有关整个系统信息的页面,所以会比独立表空间多出一些记录这些信息的页面。因为这个系统表空间最牛逼,相当于是表空间之首,所以它的 表空间 ID (Space ID)是 0 。

跳过 系统表空间的整体结构

这章节直接他妈的吐了,搞得读者都是搞数据库开发的一样,像时一个看过源码的再和你说源码里的各个数据结构,每个字段干嘛的,说实话这些对于90%的开发者平时都不用考虑,这是数据库底层优化专家要做的,写应用的知道这些玩意也用处不大,只有开头的一些目录和文件介绍还有点用。

对于开发,数据库就是一个软件,平时用的最多的就是查询,DBA时不时丢过来一些慢查询让优化。

先有个表

CREATE TABLE single_table (

id INT NOT NULL AUTO_INCREMENT,

key1 VARCHAR(100),

key2 INT,

key3 VARCHAR(100),

key_part1 VARCHAR(100),

key_part2 VARCHAR(100),

key_part3 VARCHAR(100),

common_field VARCHAR(100),

PRIMARY KEY (id),

KEY idx_key1 (key1),

UNIQUE KEY idx_key2 (key2),

KEY idx_key3 (key3),

KEY idx_key_part(key_part1, key_part2, key_part3)

) Engine=InnoDB CHARSET=utf8;上面 signle_table 表建立了1个 聚簇索引 和 4个二级索引。

对于单个表的查询来说,MySQL把查询的执行方式大致分为两种:

同一个查询语句可能可以使用多种不同的访问方法来执行,虽然最后的查询结果都是一样的,但是执行的时间可能差老鼻子远了。

可以通过主键列来定位一条记录

# 将会利用聚簇索引

SELECT * FROM single_table WHERE id = 1438;利用key2二级索引

# 通过二级索引找到逐渐

# 通过主键回表 区聚簇索引查找

SELECT * FROM single_table WHERE key2 = 3841;这种通过主键或者唯一二级索引列来定位一条记录的访问方法定义为: const 意思是常数级别的,代价是可以忽略不计的。

但也有特殊情况

# 这样背后检索方式不是const访问方法

# 因为唯一二级索引列并不限制 NULL 值的数量,所以上述语句可能访问到多条记录

SELECT * FROM single_table WHERE key2 IS NULL;二级索引列与常数等值比较,采用二级索引来执行查询的访问方法称为: ref

SELECT * FROM single_table WHERE key1='abc';会先去二级索引找出符合要求的主键,再拿着主键回表。

找出的主键数量少,效率还是很高的,如果拿出主键数量多,可能就尴尬了,有可能导致再回表还不如全表扫描。

key IS NULL这种形式的搜索条件最多只能使用red访问方法,而不是const的访问方法。

只要是最左边的连续索引列是与常熟的等值比较就可能采用ref的访问方法。

SELECT * FROM single_table WHERE key_part1 = 'god like';

SELECT * FROM single_table WHERE key_part1 = 'god like' AND key_part2 = 'legendary';

SELECT * FROM single_table WHERE key_part1 = 'god like' AND key_part2 = 'legendary'

AND key_part3 = 'penta kill';但如果最左边的连续索引列并不全部是等值比较,访问方法就不能称为ref了

SELECT * FROM single_table

WHERE key_part1 = 'god like' AND key_part2 > 'legendary'; ref_or_null 像下面的查询,等值 + or + null

SELECT * FROM single_demo WHERE key1 = 'abc' OR key1 IS NULL;先从 idx_key1 索引B+树找出 key1 IS NULL 和 key1 = 'abc'

的两个连续的记录范围,再拿着主键值找完整的用户记录。

有时候面对的搜索条件更复杂,比如

SELECT * FROM single_table WHERE key2 IN (1438, 6328) OR (key2 >= 38 AND key2 <= 79);当然可以全表扫描方式执行查询,但也可以使用二级索引然后回表的方式执行。

MySQl把这种利用索引进行范围匹配的访问方法称为 range。

SELECT key_part1, key_part2, key_part3 FROM single_table

WHERE key2_part2 = 'abc';由于 key_part2 并不是联合索引 idx_key_part 最左索引列,所以无法使用 ref 或 range 访问方法。

但是查询列表只有3个列, key_part1、key_part2、key_part3, 而索引 idx_key_part 又包含这三个列。

可以直接遍历 idx_key_part 索引的叶子节点记录来比较 key_part2 是否满足,然后直接从索引叶子中获取结果列,不需要回表。

对于InnoDB表来说也就是直接扫描聚簇索引,MySQL把这种全表扫描执行查询的方式称之为:all。

一般情况下只能利用单个二级索引执行查询

SELECT * FROM single_table

WHERE key1='abc' AND key2>1000;优化器一般会根据single_table表的统计数据来判断到底使用哪个条件对应的二级索引中查询扫描的行数会少。

用key1二级索引,找到主键然后在回表然后过滤 key2条件。

对于B+树索引,只要索引列和常数使用=、<=>、IN、NOT IN、IS NULL、IS NOT NULL、>、<、>=、<=、BETWEEN、!=、<>

或者 LIKE 操作符连接起来,就可以产生一个所谓的区间。

LIKE操作符比较特殊,只有在匹配完整字符串或者匹配字符串前缀时才可以利用索引。

下面的两个语句效果是一样的。

SELECT * FROM single_table WHERE key2 IN (1438, 6328);

SELECT * FROM single_table WHERE key2 = 1438 OR key2 = 6328;# 取 (200, +∞)

SELECT * FROM single_table WHERE key2>100 AND key2>200;# 取(100, +∞)

SELECT * FROM single_table WHERE key2>100 OR key2>200;SELECT *

FROM single_table

WHERE key2>100 AND common_filed='abc';能利用的索引只有 idx_key2一个,先走idx_key2索引然后再回表然后过滤。

SELECT *

FROM single_table

WHERE key2>100 OR common_filed='abc';走过key2索引后,再回表还是的全表扫描,这样很显然直接去全表扫描效率更好。

有的查询搜索条件可能特别复杂,找出范围匹配的各个区间就挺烦

SELECT * FROM single_table WHERE

(key1 > 'xyz' AND key2 = 748) OR

(key1 < 'abc' AND key1 > 'Imn') OR

(key1 LIKE '%suf' AND key1 > 'zzz' AND (key2 < 8000 OR common_field = 'abc')) ; 查询的搜索条件涉及到了 key1、key2、common_filed这3个列,

key1有普通的二级索引 idx_key1、key2列有唯一二级索引idx_key2。

上面的查询除了有关key2和common_filed列不能使用到idx_key1索引外,key1 LIKE '%suf'也使用不到索引,

把这些搜索条件替换为TRUE

(key1 > 'xyz' AND TRUE) OR

(key1 < 'abc' AND key1 > 'lmn') OR

(TRUE AND key1 > 'zzz' AND (TRUE OR TRUE))进行简化

(key1 > 'xyz') OR

(key1 < 'abc' AND key1 > 'lmn') OR

(key1 > 'zzz')

(key1 > 'xyz') OR (key1 > 'zzz')

key1 > 'xyz'如果使用 idx_key1 索引执行查询,需要把满足 key1 > xyz

的二级索引记录都取出来,然后拿着记录主键回表,得到完整用户记录后再使用其他搜索条件进行过滤。

假设使用 idx_key2 执行查询

(TRUE AND key2 = 748 ) OR

(TRUE AND TRUE) OR

(TRUE AND TRUE AND (key2 < 8000 OR TRUE))

key2 < 8000 OR TRUE

TRUE这个结果意味着,如果使用 idx_key2 索引执行查询语句后,需要扫描 idx_key2 二级索引的所有记录, 然后再回表,得不偿失,所以这种情况下不会使用 idx_key2 索引的。

MySQL在一般情况下执行一个查询时最多只会用到单个二级索引,但也有一个查询中使用多个二级索引, MySQL把这种使用多个索引来完成查询的执行方法称为 index merge。具体有以下三种。

SELECT * FROm single_table

WHERE key1='a' AND key3='b';key1='a' 的记录key3='b' 的记录然后取交集,然后再回表

MySQL在某些特定的情况下才可能会使用到 intersection 索引合并

情况一: 二级索引列是等值匹配的情况,对于联合索引来说,在联合索引中的每个列都必须等值匹配,不能出现只出现匹配部分列的情况。

# idx_key1 和 idx_key_part1 两个二级索引可以进行 intersection 索引合并

SELECT * FROM single_table

WHERE key1 = 'a' AND

key_part1 = 'a' AND key_part2 = 'b' AND key_part3 = 'c';下面的这两个则不能

# 对key1进行了范围匹配

SELECT * FROM single_table WHERE key1 > 'a'

AND key_part1 = 'a' AND key_part2 = 'b' AND key_part3 = 'c';

# 联合索引 idx_key_part 中的 key_part2 列并没有出现在搜索条件中

SELECT * FROM single_table WHERE key1 = 'a' AND key_part1 = 'a'; 情况二: 主键列可以是范围匹配

下面的只会用 key1的索引B+树,因为id也参与了B+树节点大小比较,记录主键是有序的。

SELECT * FROM single_table WHERE id > 100 AND key1 = 'a'; 记录先是按照索引列进行排序,如果该二级索引是一个联合索引,那么会按照联合索引中的各个列依次排序。而二级索引的用户记录是由 索引列 + 主键 构成的,二级索引列的值相同的记录可能会有好多条,这些索引列的值相同的记录又是按照主键 的值进行排序的。在 索引列相同时,主键是有序的。

主键也参与二级索引的大小比较,这样二级索引检索出来的主键会是直接有序的,两个结果求主键交集效率是非常高的,也就是 O(n) 的时间复杂度。

按照有序的主键值去回表取记录有个专有名词交 Rowid Ordered Retrieval 简称 ROR

SELECT * FROM

single_table

WHERE key1='a' OR key3='b';MySQL 在某些特定的情况下才可能会使用到 Union 索引合并:

情况一: 二级索引列是等值匹配的情况,对于联合索引来说,在联合索引中的每个列都必须等值匹配,不能出现只出现匹配部分列的情况。

SELECT * FROM single_table

WHERE key1 = 'a' OR

( key_part1 = 'a' AND key_part2 = 'b' AND key_part3 = 'c');下面两个查询则就不能进行 Union 索引合并:

# 对 key1进行了范围匹配

SELECT * FROM single_table

WHERE key1 > 'a' OR (key_part1 = 'a' AND key_part2 = 'b' AND key_part3 = 'c');

# 联合索引 idx_key_part 中的 key_part2 列并没有出现在搜索条件中

SELECT * FROM single_table WHERE key1 = 'a' OR key_part1 = 'a';情况二: 主键可以是范围匹配

情况三: 使用Intersection索引合并的搜索条件

SELECT * FROM single_table

WHERE key_part1 = 'a' AND key_part2 = 'b' AND key_part3 ='c'

OR (key1 = 'a' AND key3 = 'b');这应该一眼就能看懂的。但查询条件符合了这些情况也不一定会采用 Union索引合并,得看优化器的心情,优化器只有在单独根据搜索条件从某个二级索引中获取的记录数比较少,通过 Union 索引合并后进行访问的代价比全表扫描更小时才会使用 Union 索引合并。

SELECT * FROM single_table

WHERE key1<'a' OR key3>'z';就不能从 idx_key1索引中获取二级索引记录的主键值不是排好序的,只有索引值相同的记录主键值才有序。key3同理。

这种方式称为 Sort-Union索引合并。很明显这样多了排序步骤。只有Sort-Union 没有 Sort-Intersection。

Sort-Union的适用场景是单独根据搜索条件从某个二级索引中获取的记录数比较少,这样即使对这些二级索引记录按照主键值进行排序的成本也不会太高。

SELECT * FROM single_table

WHERE key1='1' AND key3='b';这个查询之所以可能使用 Intersection 索引合并的方式执行,还不是因为 idx_key1 和 idx_key3 是两个单独 的 B+ 树索引,你要是把这两个列搞一个联合索引,那直接使用这个联合索引就把事情搞定了,何必用啥索引合 并呢,就像这样:

ALTER TABLE single_table drop index idx_key1, idx_key3, add index idx_key1_key3(key1, key3);但对于有单独对key3列进行查询的业务场景,这样不得不再把key3列的单独索引给加上。

避不开的概念就是JOIN

按下面表来讲

mysql> CREATE TABLE t1 (m1 int, n1 char(1)); Query OK, 0 rows affected (0.02 sec)

mysql> CREATE TABLE t2 (m2 int, n2 char(1));

Query OK, 0 rows affected (0.02 sec)

mysql> INSERT INTO

t1 VALUES

(1, 'a'),

(2, 'b'),

(3, 'c');

Query OK, 3 rows affected (0.00 sec)

Records: 3 Duplicates: 0 Warnings: 0

mysql> INSERT INTO

t2 VALUES

(2, 'b'),

(3, 'c'),

(4, 'd');

Query OK, 3 rows affected (0.00 sec)

Records: 3 Duplicates: 0 Warnings: 0两个表内容是这样

mysql> SELECT * FROM t1;

+------+------+

| m1 | n1 |

+------+------+

| 1 | a |

| 2 | b |

| 3 | c |

+------+------+

3 rows in set (0.00 sec)

mysql> SELECT * FROM t2;

+------+------+

| m2 | n2 |

+------+------+

| 2 | b |

| 3 | c |

| 4 | d |

+------+------+

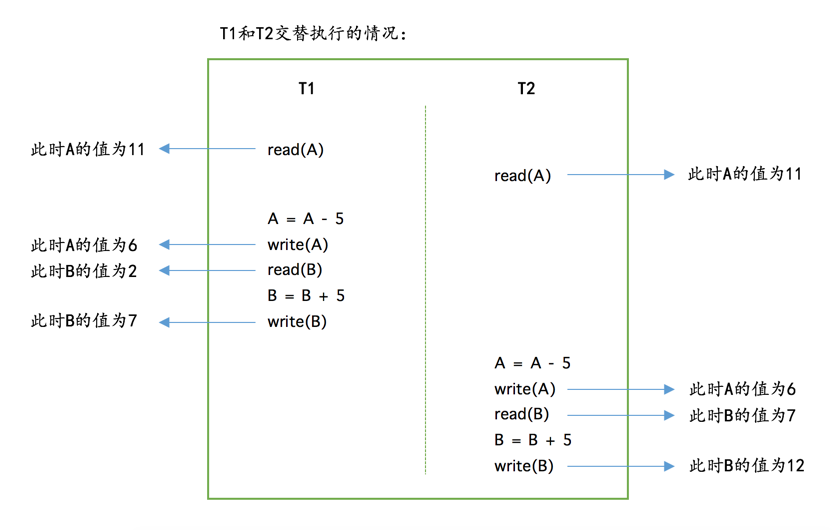

3 rows in set (0.00 sec)连接的本质就是把各个连接表中的记录都取出来一次匹配的组合加入结果集并返回给用户。

结果集中包含一个表中的每一条记录与另一个表中的每一条记录相互匹配的组合,这样的结果可以称为

之笛卡尔积。

3x3=9行记录。

| m1 | n1 | m2 | n2 |

+------+------+------+------+

| 1 | a | 2 | b |

| 2 | b | 2 | b |

| 3 | c | 2 | b |

| 1 | a | 3 | c |

| 2 | b | 3 | c |

| 3 | c | 3 | c |

| 1 | a | 4 | d |

| 2 | b | 4 | d |

| 3 | c | 4 | d |

+------+------+------+------+

9 rows in set (0.00 sec)可以连接任意数量张表,但连接起来产生的笛卡尔积可能是非常巨大的。比如3个100行记录的表连接起来产生的笛卡尔积就有 100x100x100=1000000行。

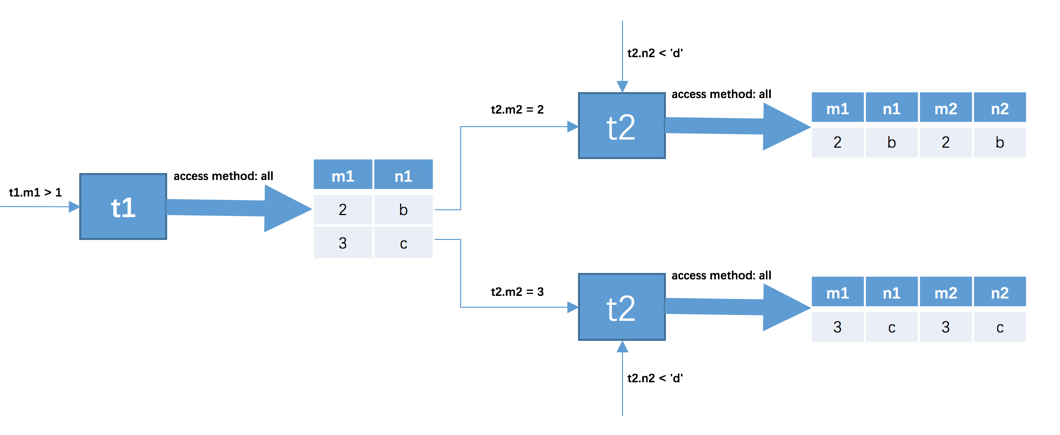

在连接的时候过滤掉特定记录组合是有必要的,在连接查询中的过滤条件可以分为两种。

t1.m1 > 1t1.m1 = t2.m2、t1.n1 > t2.n2SELECT *

FROM t1, t2

WHERE

t1.m1 > 1 AND t1.m1 = t2.m2 AND t2.n2 < 'd';

+------+------+------+------+

| m1 | n1 | m2 | n2 |

+------+------+------+------+

| 2 | b | 2 | b |

| 3 | c | 3 | c |

+------+------+------+------+从上面步骤可以看出,两表连接查询共需要查询1次t1表、2次t2表。

按下面两张表讲

CREATE TABLE student (

number INT NOT NULL AUTO_INCREMENT COMMENT '学号',

name VARCHAR(5) COMMENT '姓名',

major VARCHAR(30) COMMENT '专业',

PRIMARY KEY (number)

) Engine=InnoDB CHARSET=utf8 COMMENT '学生信息表';

CREATE TABLE score (

number INT COMMENT '学号',

subject VARCHAR(30) COMMENT '科目',

score TINYINT COMMENT '成绩',

PRIMARY KEY (number, score)

) Engine=InnoDB CHARSET=utf8 COMMENT '学生成绩表';两张表中有下面数据

mysql> SELECT * FROM student;

+----------+-----------+--------------------------+

| number | name | major |

+----------+-----------+--------------------------+

| 20180101 | 杜子腾 | 软件学院 |

| 20180102 | 范统 | 计算机科学与工程 |

| 20180103 | 史珍香 | 计算机科学与工程 |

+----------+-----------+--------------------------+

3 rows in set (0.00 sec)

mysql> SELECT * FROM score;

+----------+-----------------------------+-------+

| number | subject | score |

+----------+-----------------------------+-------+

| 20180101 | 母猪的产后护理 | 78 |

| 20180101 | 论萨达姆的战争准备 | 88 |

| 20180102 | 论萨达姆的战争准备 | 98 |

| 20180102 | 母猪的产后护理 | 100 |

+----------+-----------------------------+-------+

4 rows in set (0.00 sec)通过两表中的number连接

SELECT *

FROM student,score

WHERE student.number = score.number;

SELECT s1.number, s2.number, s2.subject, s2.score

FROM student AS s1, score AS s2

WHERE s1.number = s2.number;上面这样查询,学号 number为 20180103的同学是没有结果的因为score表中没有其记录。

为了解决这个问题,就有了内连接和外连接。

外连接可以细分为2种:

不同地方的过滤条件有不同语义:

WHERE子句种的过滤条件,不论是内连接还是外连接,凡是不符合 WHERE 子句中的过滤条件的记录都不会被加入最后的结果集。

ON子句种的过滤条件,对于外连接的驱动表的记录来说,如果无法在被驱动表中找到匹配 ON 子句中的过滤条件的记录,那么该记 录仍然会被加入到结果集中,对应的被驱动表记录的各个字段使用 NULL 值填充。

把 ON 子句放到内连接中, MySQL 会把它和 WHERE 子句一样对待,也就是说:内连接中的WHERE子句和ON子句是等价的。

一般把只涉及单表的过滤条件放到WHERE子句,涉及两表的过滤条件都放到ON子句。

SELECT *

FROM t1 LEFT [OUTER]

JOIN t2

ON 连接条件

[WHERE 普通过滤条件];放在左边的表称之为外表或者驱动表,右边的表称之为内表或者被驱动表。例子中 t1 就是外表或者驱动表, t2 就是内表或者被驱动表。

mysql>

SELECT s1.number, s1.name, s2.subject, s2.score

FROM student AS s1

LEFT JOIN score AS s2

ON s1.number = s2.number;

+----------+-----------+-----------------------------+-------+

| number | name | subject | score |

+----------+-----------+-----------------------------+-------+

| 20180101 | 杜子腾 | 母猪的产后护理 | 78 |

| 20180101 | 杜子腾 | 论萨达姆的战争准备 | 88 |

| 20180102 | 范统 | 论萨达姆的战争准备 | 98 |

| 20180102 | 范统 | 母猪的产后护理 | 100 |

| 20180103 | 史珍香 | NULL | NULL |

+----------+-----------+-----------------------------+-------+驱动表是右边的表,被驱动表是左边的表。

SELECT * FROM t1

RIGHT [OUTER] JOIN t2

ON 连接条件 [WHERE 普通过滤条件]; 内连接和外连接的根本区别就是在驱动表中的记录不符合 ON 子句中的连接条件时不会把该记录加入到最后的结果集。

有很多种写法。

SELECT *

FROM t1 [INNER|CROSS] JOIN t2

[ON 连接条件]

[WHERE 普通过滤条件];下面的几种内连接写法都是等价的。

SELECT * FROM t1 JOIN t2;

SELECT * FROM t2 INNER JOIN t2;

SELECT * FROM t1 CROSS JOIN t2;推荐写 INNER JOIN 的写法,语法目的比较明确,由于在内连接中ON子句和WHERE子句是等价的,所以内连接中不要求强制写明ON子句。

左外连接和右外连接的驱动表和被驱动表不能轻易互换,内连接即使表顺序交换后也是等价的。

上面回顾了SQL种的内连接、左外连接、右外连接。下面就是探索 MySQL 采用了什么样的算法来进行表与表之间的连接,知道原理知识, 才明白为什么有的连接查询快、有的却非常慢。

对于两表连接来说,驱动表只会被访问一遍,但被驱动表却要被访问到好多遍,具体访问几遍取决于对驱动表执行单表查询后的结果集中的记录条数。

比如有3个表进行连接

for each row in t1 { #此处表示遍历满足对t1单表查询结果集中的每一条记录

for each row in t2 { #此处表示对于某条t1表的记录来说,遍历满足对t2单表查询结果集中的每一条记录

for each row in t3 { #此处表示对于某条t1和t2表的记录组合来说,对t3表进行单表查询

if row satisfies join conditions, send to client

}

}

}这个过程就像是一个嵌套的循环,所以这种驱动表只访问一次,但被驱动表却可能被多次访问,访问次数取决于对驱动表执行单表查询后的结果集中的记录条数的连接执行方式称之为 嵌套循环连接 ( Nested-Loop Join )。

比如还是这个例子

SELECT *

FROM t1, t2

WHERE

t1.m1 > 1 AND t1.m1 = t2.m2 AND t2.n2 < 'd';在t1

能用索引就用索引,先进行单表查询出结果,再进行t2多次查询时,也可以使用t2的某些索引进行单表查询,因为在查

t2时 每次查询 t1.m1 都是已经确定的 相当于

常量 = t2.m2 AND t2.n2 < 'd'。

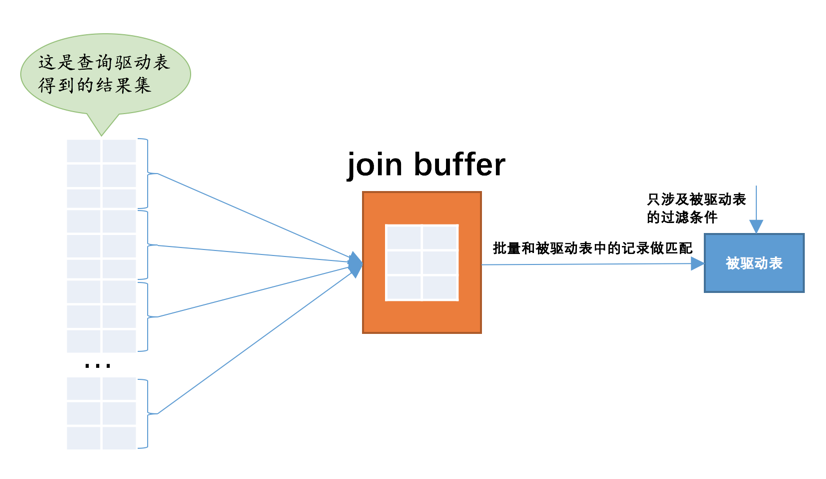

也就是驱动表查询的结果先缓存到join buffer一批,然后拿着一批去被驱动表查与过滤,减少访问被驱动表的次数。

尽量减少访问被驱动表的次数。

之前说 MySQL 执行一个查询可以有不同的执行方案,它会选择其中成本最低,或者说代价最低的那种方案去真正的执行查询。

但一条查询语句的执行成本是由 I/O成本 读磁盘、CPU成本 读取以及检测记录是否满足对应的搜索条件、结果集排序等等。

为了用值衡量,MySQL规定读取一个页面花费的成本默认为1.0,读取以及检测一条记录是否符合搜索条件的成本默认是0.2。 1.0、0.2 称为成本常数。

仍旧使用下面这张表来讲

CREATE TABLE single_table (

id INT NOT NULL AUTO_INCREMENT,

key1 VARCHAR(100),

key2 INT,

key3 VARCHAR(100),

key_part1 VARCHAR(100),

key_part2 VARCHAR(100),

key_part3 VARCHAR(100),

common_field VARCHAR(100),

PRIMARY KEY (id),

KEY idx_key1 (key1),

UNIQUE KEY idx_key2 (key2),

KEY idx_key3 (key3),

KEY idx_key_part(key_part1, key_part2, key_part3)

) Engine=InnoDB CHARSET=utf8;在一条单表查询语句真正执行之前,查询优化器会找出执行该语句所有可能使用的方案,找出成本低的

SELECT * FROM single_table WHERE

key1 IN ('a', 'b', 'c') AND

key2 > 10 AND key2 < 1000 AND

key3 > key2 AND

key_part1 LIKE '%hello%' AND

common_field = '123';B+树索引,只要索引列和常数使用

= 、 <=> 、 IN 、 NOT IN 、 IS NULL 、 IS NOT NULL 、 > 、 < 、 >= 、 <= 、 BETWEEN 、 != (不等于也可以写成 <> )或者 LIKE 操作符

连接起来,就可以产生一个所谓的 范围区间 LIKE

匹配字符串前缀也行),这些搜索条件都可能使用到索引。

把一个查询中,可能使用到的索引称为 possible keys。

key1 IN ('a', 'b', 'c') 可以使用二级索引 idx_key1key2 > 10 AND key2 < 1000 可以使用二级索引

idx_key2key3>key2

这个搜索条件的索引列由于没和常数比较不能直接使用索引,使用也是先把key2过滤掉之后再去key3索引里。key_part1 LIKE '%hello%' 不适用,不是与前缀匹配common_field = '123' 该列压根没有索引上面的 possible keys 只有 idx_key1 和 idx_key2。

全表扫描的成本代码需要两个信息:

# 查看表的统计信息

SHOW TABLE STATUS LIKE 'single_table'\G

Name: single_table

Engine: InnoDB

Version: 10

Row_format: Dynamic

Rows: 9693

Avg_row_length: 163

Data_length: 1589248

Max_data_length: 0

Index_length: 2752512

Data_free: 4194304

Auto_increment: 10001

Create_time: 2018-12-10 13:37:23

Update_time: 2018-12-10 13:38:03

Check_time: NULL

Collation: utf8_general_ci

Checksum: NULL

Create_options:

Comment:其中的Rows就是表中的记录条数,对于MyISAM的表该值是准确的,对于InnoDB表该值是估计值。

Data_length = 聚簇索引的页面数量 x 每个页面的大小

聚簇索引的页面数量 = 1589248 ÷ 16 ÷ 1024 = 97

I/O 成本

97 x 1.0 + 1.1 = 98.1

97 指的是聚簇索引占用的页面数, 1.0 指的是加载一个页面的成本常数,后边的 1.1 是一个微调值

CPU成本

9693 x 0.2 + 1.0 = 1939.6

9693 指的是统计数据中表的记录数,对于 InnoDB 存储引擎来说是一个估计值, 0.2 指的是访问一条记录所需的成本常数,后边的 1.0 是一个微调值

总成本

98.1 + 1939.6 = 2037.7表中的记录都存储在聚簇索引对应B+树的叶子节点,通过根节点获得最左边的叶子节点,沿着叶子节点组成的双向链表把所有记录都查一遍,全表扫描过程有的B+树内节点是不需要访问的。

不论某个范围区间的二级索引到底占用了多少页,查询优化器粗暴认为读取索引的一个范围区间的I/O成本和读取一个页面是相同的。

关于具体成本数值的计算在此不进行了,属实没必要,我们只要多理解被后查询原理就好了。

key2 > 10 AND key2 < 1000

内节点中的页访问也是需要成本的

通过 key2 的索引,找出范围内最左叶子节点,范围内最右叶子节点,然后左右之间的就是符合要求的,统计一下页数记录数之类的信息。然后拿到逐渐后,进行回表,每一次回表成本按一次页面I/O。回表操作后得到的完整用户记录,然后再检测其他搜索条件是否成立。

使用 idx_key1 执行查询 key1 IN ('a', 'b', 'c')

相当于3个单节点区间 ['a', 'a'] ['b', 'b'] ['c', 'c']

然后根据这些记录里的主键值到聚簇索引中做回表操作。

是否有可能使用 索引合并(Index Merge)

key1和key2搜索条件使用 AND,对于 idx_key1 和 idx_key2 都是范围查询,查到的二级索引记录并不是按照主键值进行排序的,并不满足使用 Intersection 索引合并的条件

对比全表扫描的成本,使用 idx_key2 的成本,使用 idx_key1的成本

找出成本较低的那个方案,源码真正的工作原理不一定是这样,上面的内容只是帮助我们理解背后的机制罢了不必过于认真

SELECT * FROM single_table

WHERE key1 IN ('aa1', 'aa2', 'aa3', ... , 'zzz'); 查询可能使用到的索引就是 idx_key1 ,由于这个索引并不是唯一二级索引,所以并不能确定一个单点区间对应的二级索引记录的条数有多少。

通过直接访问索引对应的B+树来计算某个范围区间对应的索引记录条数的方式称为 index dive。

如果 IN 里面有20000个参数,如果为了计算这些单点区间对应的索引记录条数,要进行20000次 index dive 操作,性能损耗就大了,搞不好比全表扫描成本都高。

有一个系统变量

mysql> SHOW VARIABLES LIKE '%dive%';

+---------------------------+-------+

| Variable_name | Value |

+---------------------------+-------+

| eq_range_index_dive_limit | 200 |会为每个表维护一份统计数据一样, MySQL 也会为表中的每一个索引维护一份统计数据,查看某个表中索引的统计数据可以使用 SHOW INDEX FROM 表名 的语法。

mysql> SHOW INDEX FROM single_table;

+--------------+------------+--------------+--------------+-------------+-----------+-------------+----------+--------+------+------------+---------+---------------+

| Table | Non_unique | Key_name | Seq_in_index | Column_name | Collation | Card inality | Sub_part | Packed | Null | Index_type | Comment | Index_comment |

+--------------+------------+--------------+--------------+-------------+-----------+-------------+----------+--------+------+------------+---------+---------------+

| single_table | 0 | PRIMARY | 1 | id | A | 9693 | NULL | NULL | | BTREE | | |

| single_table | 0 | idx_key2 | 1 | key2 | A | 9693 | NULL | NULL | YES | BTREE | | |

| single_table | 1 | idx_key1 | 1 | key1 | A | 968 | NULL | NULL | YES | BTREE | | |

| single_table | 1 | idx_key3 | 1 | key3 | A | 799 | NULL | NULL | YES | BTREE | | |

| single_table | 1 | idx_key_part | 1 | key_part1 | A | 9673 | NULL | NULL | YES | BTREE | | |

| single_table | 1 | idx_key_part | 2 | key_part2 | A | 9999 | NULL | NULL | YES | BTREE | | |

| single_table | 1 | idx_key_part | 3 | key_part3 | A | 10000 | NULL | NULL | YES | BTREE | | |

+--------------+------------+--------------+--------------+-------------+-----------+-------------+----------+--------+------+------------+---------+---------------+

7 rows in set (0.01 sec)single_table表中有10000条数据,某个索引列的 Cardinality 属性是 10000 ,那意味着该列中没有重复的值,如果 Cardinality 属性是 1 的话,就意味着该列的值全部是重复的。

平均一个值重复多少次,

一个值的重复次数 ≈ Rows ÷ Cardinality例如key1索引

9693 ÷ 968 ≈ 10(条)假设 IN 语句中有20000个参数的话,回表次数估算

20000 x 10 = 200000当查询中使用到了IN查询,但是却实际没有用到索引,应该考虑一下是不是由于 eq_range_index_dive_limit 值太小导致的。

连接查询至少要有两个表。

直接构造一个和single_table表一模一样的single_table2表,暂且把 single_table 表称为s1表,把single_table2表称为s2表。

MySQL中连接查询采用的是嵌套循环连接算法,驱动表会被访问一次,被驱动表可能会被访问多次。

两表连接查询,它的查询成本由两部分构成:

把驱动表进行查询后得到的记录条数称之为驱动表的 扇出(fanout), 很明显删除之越小,对被驱动表的查询次数越少,连接查询的成本越低。

SELECT * FROM single_table AS s1

INNER JOIN single_table AS s2;上面的查询进行了,全表x全表

SELECT * FROM single_table AS s1

INNER JOIN single_table2 AS s2

WHERE s1.key2 > 10 AND s2.key2 < 1000;上面的查询,删除值是前面 满足 key2大于10的部分 x 后者 key2小于1000的。

SELECT * FROM single_table AS s1

INNER JOIN single_table2 AS s2

WHERE s1.common_field > 'xyz';优化器只会猜 single_table 有多少条记录满足 common_field 大于 xyz条件。

SELECT * FROM single_table AS s1

INNER JOIN single_table2 AS s2

WHERE s1.key2 > 10 AND s1.key2 < 1000

AND s1.common_field > 'xyz';查询可以使用 idx_key2

索引,所以只需要从符合二级索引范围区间的记录中猜有多少条记录符合

common_field > 'xyz' 条件

SELECT * FROM single_table AS s1 INNER JOIN

single_table2 AS s2

WHERE s1.key2 > 10 AND s1.key2 < 1000

AND s1.key1 IN ('a', 'b', 'c') AND s1.common_field > 'xyz';在驱动表 s1 选取 idx_key2

索引执行查询后,优化器需要从符合二级索引范围区间的记录中猜有多少条记录符合下边两个条件:

key1 IN ('a', 'b', 'c') 和

common_field > 'xyz'

MySQL把这个猜的过程称为 condition filtering。

连接查询的成本计算公式

连接查询总成本 = 单次访问驱动表的成本 + 驱动表扇出数 x 单次访问被驱动表的成本对于左(外)连接和 右(外)连接查询,驱动表是固定的,想要得到最优的查询方案只需要:分别为驱动表和被驱动表选择成本最低的访问方法。

对于内连接,驱动表和被驱动表的位置是可以互换的,所以需要考虑两个方面的问题:

SELECT * FROM single_table AS s1 INNER JOIN

single_table2 AS s2

ON s1.key1 = s2.common_field

WHERE s1.key2 > 10 AND s1.key2 < 1000

AND s2.key2 > 1000 AND s2.key2 < 2000;可以选择的连接顺序有两种

s1表单表搜索条件,如果扇出数量少于s2的,肯定把s1放到前面,s1的删除连接s2时,

每次查s2 都是 常数 = s2.common_field 然后 判断条件

s2.key2 > 1000 AND s2.key2 < 2000。

所以使用 single_table 作为驱动表的成本

使用idx_key2访问s1的成本 + s1的扇出 × 使用idx_key2访问s2的成本使用single_table2作为驱动表的成本

使用idx_key2访问s2的成本 + s2的扇出 × 使用idx_key1访问s1的成本对于两表连接,比如表A和表B连接,AB、BA两种顺序

2x1,对于3个表 3x2x1,很明显是n的阶乘。

MySQL不会把n的阶乘种方法成本都计算的。

MySQL 在计算各种链接顺序的成本之前,会维护一个全局的变量,这个变量表示当前最小的连接查询成本。如果在分析某个连接顺序的成本时,该成本已经超过当前最小的连接查询成本,那就压根儿不对该连接顺序继续往下分析了。

系统变量 optimizer_search_depth,如果连接表的个数小于该值,那么就继续穷举分析每一种连接顺序的成本,否则只对与 optimizer_search_depth 值相同数量的表进行穷举分析。很明显越大越好,但会花费更多的分析时间。

启发式规则(就是根据以往经验指定的一些规则),凡是不满足这些规则的连接顺序压根儿就不分析,提供了一个系统变量 optimizer_prune_level 来控制到底是不是用这些启发式规则。

之前假设了读一个页面花费成本默认是1,检测一条记录是否符合搜索条件的成本默认是 0.2,其实除了这两个成本常数, MySQL 还支持好多呢,它们被存储到了 mysql 数据库。

mysql> SHOW TABLES FROM mysql LIKE '%cost%';

+--------------------------+

| Tables_in_mysql (%cost%) |

+--------------------------+

| engine_cost |

| server_cost |

+--------------------------+

2 rows in set (0.00 sec)这两张表提供的信息有助于分析查询执行过程中的瓶颈和优化方向。

mysql.server_cost 表用于存储与查询执行过程中服务器级别的成本估算信息。这些信息对于查询优化器非常重要,能够帮助 MySQL 选择最优的执行计划。该表包含了优化器在执行计划生成过程中估算的服务器成本数据。

mysql> select * from server_cost;

+------------------------------+------------+---------------------+---------+---------------+

| cost_name | cost_value | last_update | comment | default_value |

+------------------------------+------------+---------------------+---------+---------------+

| disk_temptable_create_cost | NULL | 2025-12-31 03:43:36 | NULL | 20 |

| disk_temptable_row_cost | NULL | 2025-12-31 03:43:36 | NULL | 0.5 |

| key_compare_cost | NULL | 2025-12-31 03:43:36 | NULL | 0.05 |

| memory_temptable_create_cost | NULL | 2025-12-31 03:43:36 | NULL | 1 |

| memory_temptable_row_cost | NULL | 2025-12-31 03:43:36 | NULL | 0.1 |

| row_evaluate_cost | NULL | 2025-12-31 03:43:36 | NULL | 0.1 |

+------------------------------+------------+---------------------+---------+---------------+

6 rows in set (0.002 sec)表字段解析:

主要配置项说明:

mysql.engine_cost 表主要存储与查询执行过程中的存储引擎相关的成本估算信息。这些信息包括存储引擎的 I/O 开销、内存使用情况、锁的竞争等因素。

mysql> select * from engine_cost;

+-------------+-------------+------------------------+------------+---------------------+---------+---------------+

| engine_name | device_type | cost_name | cost_value | last_update | comment | default_value |

+-------------+-------------+------------------------+------------+---------------------+---------+---------------+

| default | 0 | io_block_read_cost | NULL | 2025-12-31 03:43:36 | NULL | 1 |

| default | 0 | memory_block_read_cost | NULL | 2025-12-31 03:43:36 | NULL | 0.25 |

+-------------+-------------+------------------------+------------+---------------------+---------+---------------+

2 rows in set (0.002 sec)表字段解析:

主要配置项说明:

前面讲查询成本时经常用到一些统计数据,比如通过

SHOW TABLE STATUS

可以看到关于表的统计数据,这些统计数据是怎么来的呢?

先看下下面主要讲的什么,然后再具体看

永久性的统计数据,这种统计数据存储在磁盘上,也就是服务器重启之后这些统计数据还在。

非永久性的统计数据,这种统计数据存储在内存中,当服务器关闭时这些这些统计数据就都被清除掉了,等到服务器重启之后,在某些适当的场景下才会重新收集这些统计数据。

CREATE TABLE 表名 (...) Engine=InnoDB, STATS_PERSISTENT = (1|0);

ALTER TABLE 表名 Engine=InnoDB, STATS_PERSISTENT = (1|0);STATS_PERSISTENT为1,统计数据永久存到磁盘,为0将统计数据临时存到内存。

如果在创建表时未指定 STATS_PERSISTENT 属性,那默认采用系统变量 innodb_stats_persistent 的值作为该属性的值。

把某个表以及该表索引的统计数据存放到磁盘上,实际上是把这些统计数据存储到两个表里

mysql> SHOW TABLES FROM mysql LIKE 'innodb%';

+---------------------------+

| Tables_in_mysql (innodb%) |

+---------------------------+

| innodb_index_stats |

| innodb_table_stats |

+---------------------------+

2 rows in set (0.01 sec)innodb_table_stats 存储了关于表的统计数据,每一条记录对应着一个表的统计数据。

innodb_index_stats 存储了关于索引的统计数据,每一条记录对应着一个索引的一个统计项的统计数据。

下面看这个 innodb_table_stats 表中各列都是干什么的

mysql> desc innodb_table_stats;

+--------------------------+-----------------+------+-----+-------------------+-----------------------------------------------+

| Field | Type | Null | Key | Default | Extra |

+--------------------------+-----------------+------+-----+-------------------+-----------------------------------------------+

| database_name | varchar(64) | NO | PRI | NULL | |

| table_name | varchar(199) | NO | PRI | NULL | |

| last_update | timestamp | NO | | CURRENT_TIMESTAMP | DEFAULT_GENERATED on update CURRENT_TIMESTAMP |

| n_rows | bigint unsigned | NO | | NULL | |

| clustered_index_size | bigint unsigned | NO | | NULL | |

| sum_of_other_index_sizes | bigint unsigned | NO | | NULL | |

+--------------------------+-----------------+------+-----+-------------------+-----------------------------------------------+

6 rows in set (0.017 sec)mysql> select * from innodb_table_stats;

+---------------+--------------+---------------------+--------+----------------------+--------------------------+

| database_name | table_name | last_update | n_rows | clustered_index_size | sum_of_other_index_sizes |

+---------------+--------------+---------------------+--------+----------------------+--------------------------+

| dbname | dbuserrecord | 2026-01-23 02:51:44 | 4 | 1 | 1 |

| mysql | component | 2025-12-31 03:43:36 | 0 | 1 | 0 |

| sys | sys_config | 2025-12-31 03:43:37 | 6 | 1 | 0 |

+---------------+--------------+---------------------+--------+----------------------+--------------------------+

3 rows in set (0.004 sec)InnoDB 统计一个表中有多少行记录的套路是这样的:

按照一定算法(并不是纯粹随机的),选取几个叶子节点页面,计算每个页面中主键值记录数量,然后计算平均一个页面中主键的记录数量, 然后乘以全部叶子节点的数量就算是该表的 n_rows 值。

n_rows值精确与否取决于统计时采样的页面数量,MySQL 设计了一个名为 innodb_stats_persistent_sample_pages 的系统变量来控制使用永久性的统计数据时,计算统计数据时采样的页面数量。该值设置的越大,统计出的 n_rows 值越精确,但是统计耗时也就最久;该值设置的越小,统计出的 n_rows 值越不精确,但是统计耗时特别少。所以在实际使用是需要我们去权衡利弊,该系统变量的默认值是 20 。

也可以为某个单独的表单独设置

CREATE TABLE 表名 (...)

Engine=InnoDB, STATS_SAMPLE_PAGES = 具体的采样页面数量;

ALTER TABLE 表名 Engine=InnoDB, STATS_SAMPLE_PAGES = 具体的采样页面数量; 这两个统计项的收集过程:

从叶子节点和非叶子节点段的 Segment Header 中找到这两个段对应的 INODE Entry结构。

从对应的 INODE Entry 结构中可以找到该段对应所有零散的页面地址以及 FREE、NOT_FULL、FULL 链表的基节点。

直接统计零散的页面有多少个,然后从那三个链表的List Length字段中读出该段占用的区的大小, 每个区占用64个页面,就可以统计出整个段占用的页面。

分别计算聚簇索引的叶子结点段和非叶子节点段占用的页面数,它们的和就是 clustered_index_size 的值,按照同样的套路把其余索引占用的页面数都算出来,加起来之后就是 sum_of_other_index_sizes 的值。

一个段的数据在非常多时(超过32个页面),就会以区为单位申请空间,以区为单位申请空间中有一些页可能并没有使用,但是在统计 clustered_index_size 和 sum_of_other_index_sizes 时都把它们算进去了,所以说聚簇索引和其他的索引占用的页面数可能比这两个值要小一些。

mysql> desc innodb_index_stats;

+------------------+-----------------+------+-----+-------------------+-----------------------------------------------+

| Field | Type | Null | Key | Default | Extra |

+------------------+-----------------+------+-----+-------------------+-----------------------------------------------+

| database_name | varchar(64) | NO | PRI | NULL | |

| table_name | varchar(199) | NO | PRI | NULL | |

| index_name | varchar(64) | NO | PRI | NULL | |

| last_update | timestamp | NO | | CURRENT_TIMESTAMP | DEFAULT_GENERATED on update CURRENT_TIMESTAMP |

| stat_name | varchar(64) | NO | PRI | NULL | |

| stat_value | bigint unsigned | NO | | NULL | |

| sample_size | bigint unsigned | YES | | NULL | |

| stat_description | varchar(1024) | NO | | NULL | |

+------------------+-----------------+------+-----+-------------------+-----------------------------------------------+

8 rows in set (0.010 sec)mysql> select * from innodb_index_stats;

+---------------+--------------+------------+---------------------+--------------+------------+-------------+-----------------------------------+

| database_name | table_name | index_name | last_update | stat_name | stat_value | sample_size | stat_description |

+---------------+--------------+------------+---------------------+--------------+------------+-------------+-----------------------------------+

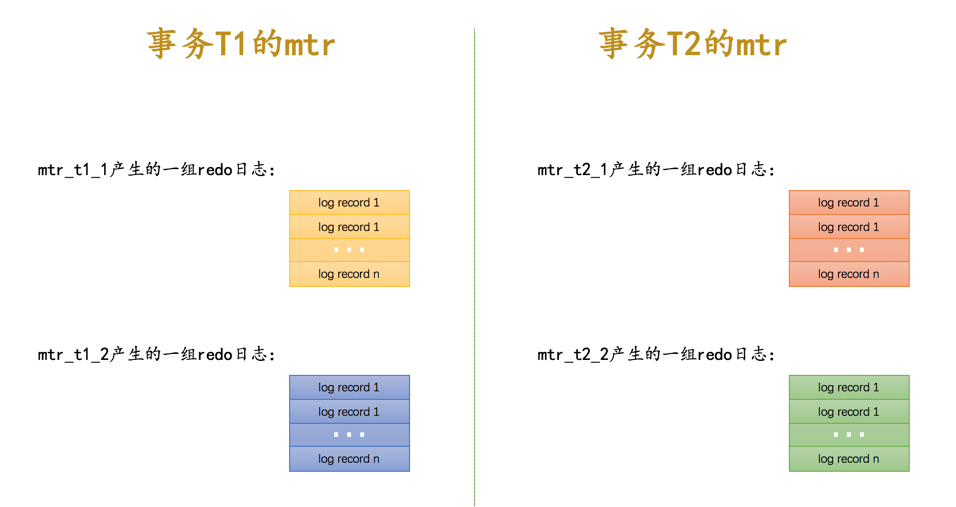

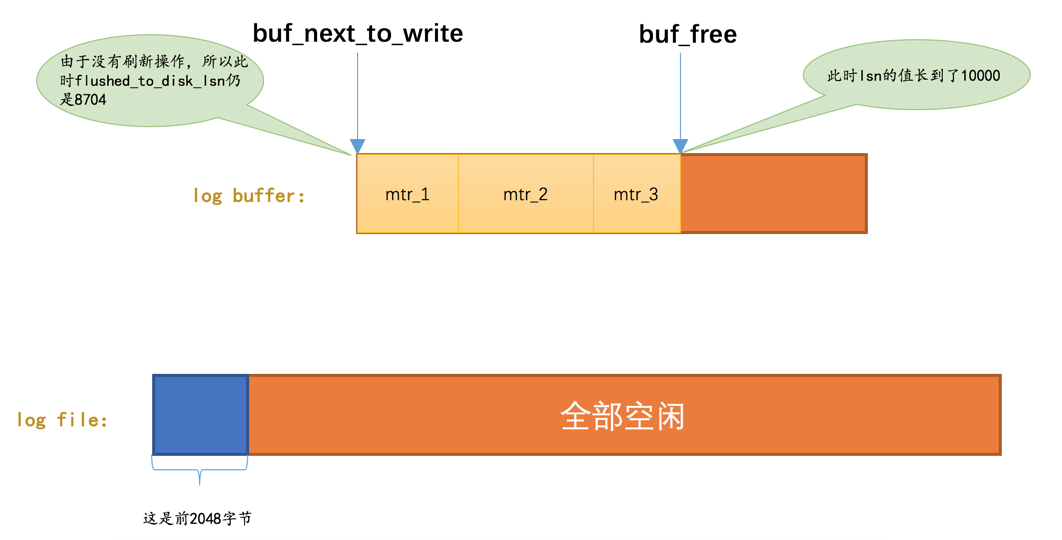

| dbname | dbuserrecord | PRIMARY | 2026-01-23 02:51:44 | n_diff_pfx01 | 4 | 1 | id |