《Kubernetes Up & Running Third Edition》

Kubernetes官网:https://kubernetes.io/docs/home/

Kubernetes中文官网:https://kubernetes.io/zh-cn/docs/home

《Kubernetes即学即用》第三版,作者的话 Dive into the Future of infrastructure(深入未来基础设施的世界)。

Kubernetes是一个用于部署容器化应用程序的开源编排器。

Kubernetes旨在极大地简化构建、部署和维护分布式系统地任务,它收到了数十年来 构建可靠系统地实际经验的启发,并且从头开始设计,以使这种体验至少是愉快的。

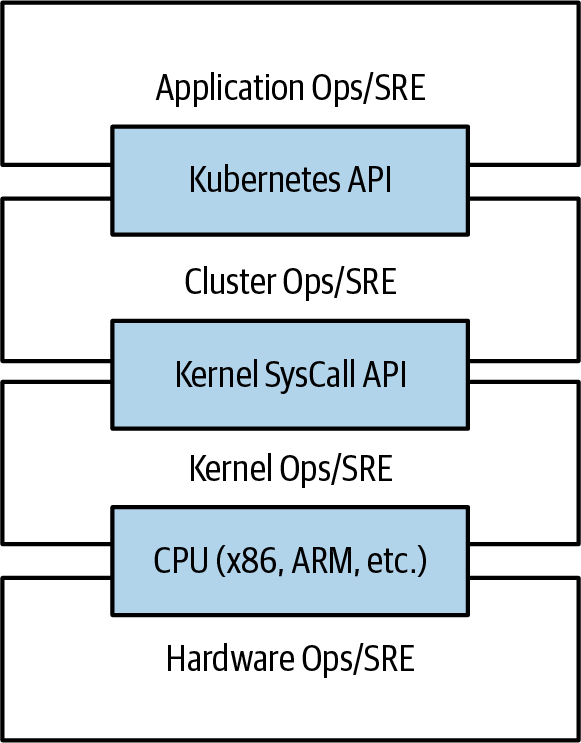

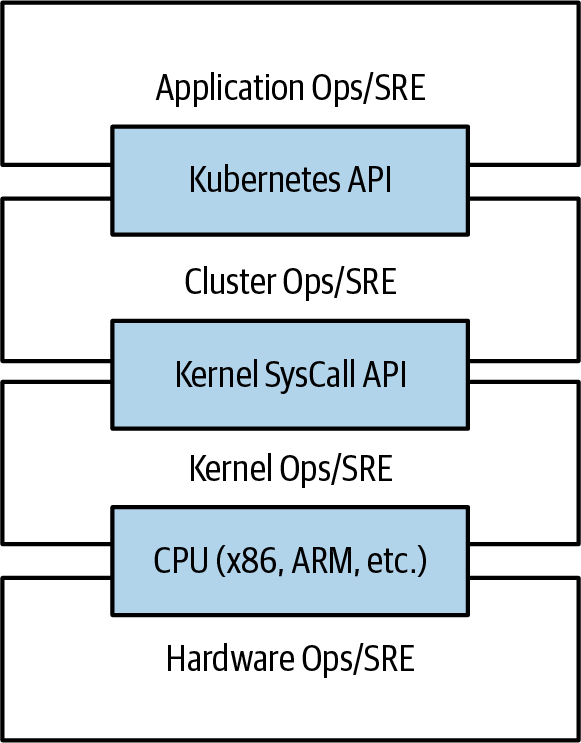

从最早的编程语言,到面向对象编程,再到虚拟化和云基础设施的发展,计算机科学的历史, 本质上就是不断创造抽象层的历史,这些抽象层的作用,是隐藏底层复杂性,让开发者 能够构建越来越复杂、越来越强大的应用程序。

容器以及像 Kubernetes 这样的容器编排API,已经被证明是一种重要的抽象层, 能够从根本上简化可靠、可扩展的分布式系统的开发。

说人话:

开发者不用天天跟服务器配置斗智斗勇,可以把精力放在程序本身,现实世界依旧会把你来回地面, 比如 YAML 写错一个空格,整个集群一起罢工。

前几章讲概念、中间讲对象、后面讲安全 存储 扩展、最后讲多集群。

Kubernetes 本质就三件事

提到 “可靠、可扩展的分布式系统”时。

如今越来越多的服务通过网络以API的形式提供,这些API通常由一个 分布式系统 来 实现,实现API的各个组件运行在不同的机器上,通过网络连接,并通过网络通信来 协调彼此的行为。

同样,在 软件发布(rollout)或其他 维护操作 期间,系统也必须保持可用性。

系统还必须具备 高度的可扩展性,能够随着使用量的持续增长而扩展容量,而不需要对 实现服务的分布式系统进行彻底的重新设计。意味着系统可以自动扩展或缩减容量, 从而使应用程序保持最高的资源使用效率。

速度几乎是当今所有软件开发中的核心要素。软件行业已经从过去通过盒装 CD 或 DVD 发布产品,演变为通过网络提供的 基于 Web 的服务,并且这些服务可能每小时都会更新。

与竞争对手之间的差距,往往体现在以下方面:

速度不是单纯的“快”,更在意 服务必须高度可靠

过去时代,每天午夜进行更新、服务短暂下线是可接受的,今天用户期望服务始终在线。

真正的速度:在不影响可用性的情况下持续发布软件的能力。

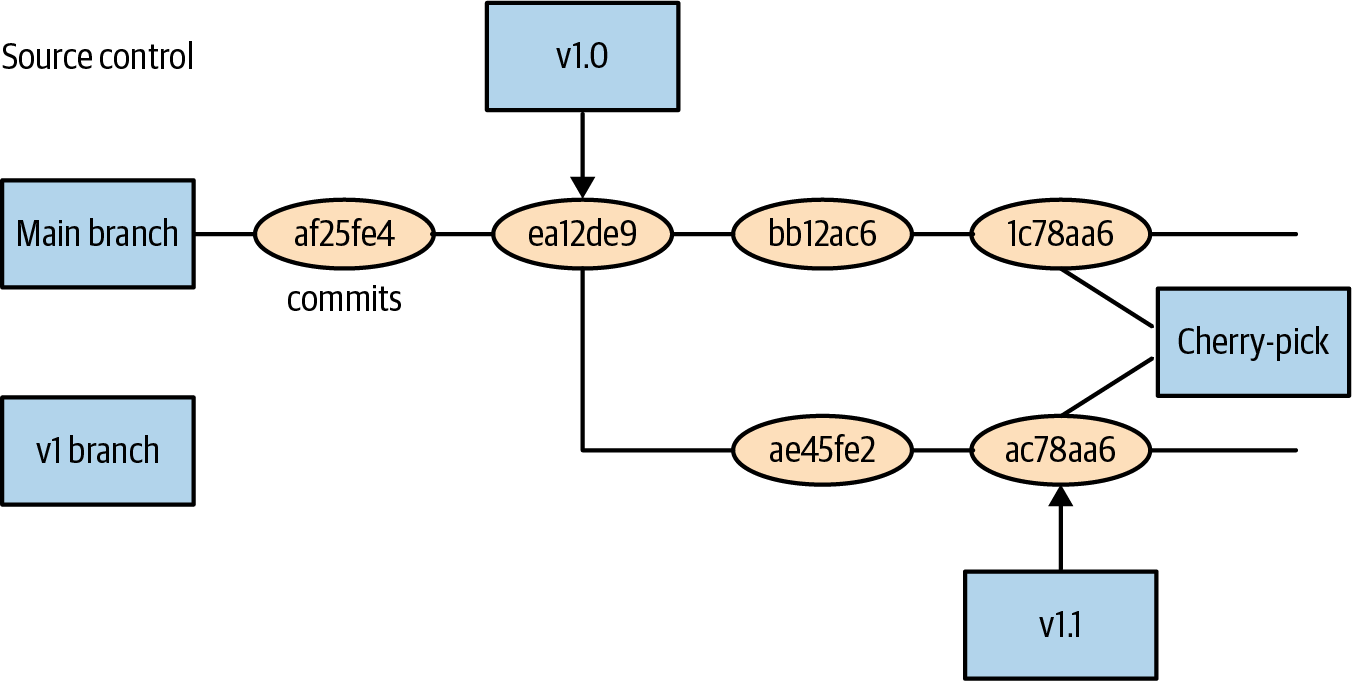

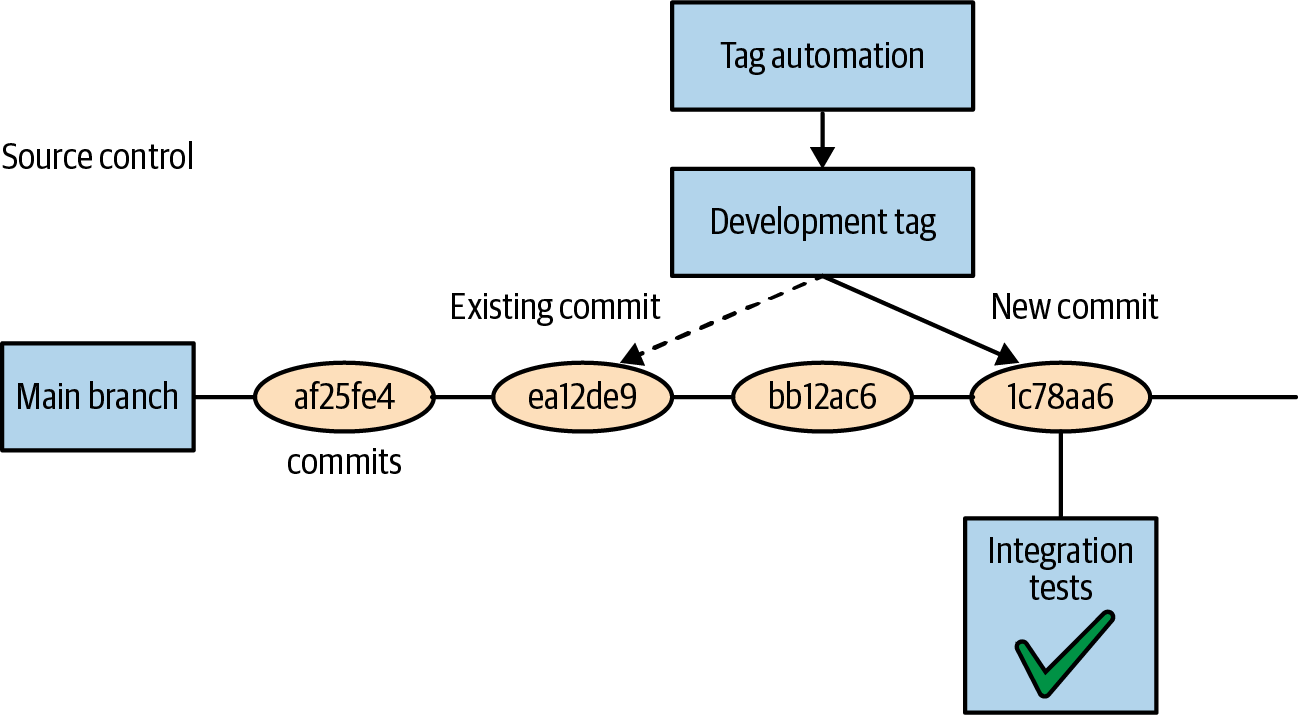

容器和Kubernetes鼓励开发人员构建遵循 不可变基础设施(Immutable Infrastructure)原则的分布式系统, 在不可变基础设施中,一旦系统中的某个构件(artifact)被创建出来,就不再通过用户修改进行改变。

在许多系统中,这些增量修改不仅来自系统升级,还来自运维人员的手动更改。此外,在由大型团队运行的系统中,这些更改很可能由许多人完成,而且在很多情况下根本没有任何记录。

在不可变系统中,更新并不是一系列增量修改。相反,会构建一个全新的完整镜像,然后通过一次操作直接用新镜像替换旧镜像。

两种升级软件方式对比:

方案一:

方案二:

不可变的容器镜像是 Kubernetes 中一切工作的核心,“不要修改服务器,直接换服务器”。

声明式配置(Declarative Configuration),在 Kubernetes 中,一切都是声明式配置对象(declarative configuration object),它表示系统的期望状态(desired state)。

Kubernetes 的任务就是确保现实中的实际状态与这个期望状态保持一致。

命令式配置与声明式配置的区别:

简单例子,假设想让某个软件运行3个副本

命令式方式会写成:

运行A

运行B

运行C而声明式方式则会写成,“我需要三个副本”:

replicas = 3把声明式配置存储在版本控制系统中的做法通常被称为:基础设施即代码(Infrastructure as Code,IaC)

叫 GitOps 的理念开始把 Infrastructure as Code 的时间进一步规范化,核心思想

把Git仓库当作唯一的真实来源(source of truth)。

当你采用GitOps时,对生产环境的所有修改都通过向 Git 仓库提交代码完成,自动化系统会把这些修改同步到 Kubernetes 集群中。

当声明式配置 + 版本控制系统结合时,再加上 Kubernetes 能自动让现实状态匹配声明状态,回滚(rollback)就变得非常简单。

自愈系统(Self-Healing Systems)

传统系统:

系统挂了 -> 告警 -> 运维被电话吵醒 -> 登录 -> 修Kubernetes:

系统挂了 -> 控制器发现状态不对 -> 自动拉起新 Pod从 半夜修服务器 到 写YAML。

随着产品不断增长,不可避免地需要同时扩展软件系统本身,以及开发这些软件的软对规模。

Kubernetes 可以在这两个方面提供帮助。系统被拆成一堆相对独立的小组件,它们之间通过明确的接口通信。

把一个巨大复杂的东西拆成很多小块,生活会轻松一点。

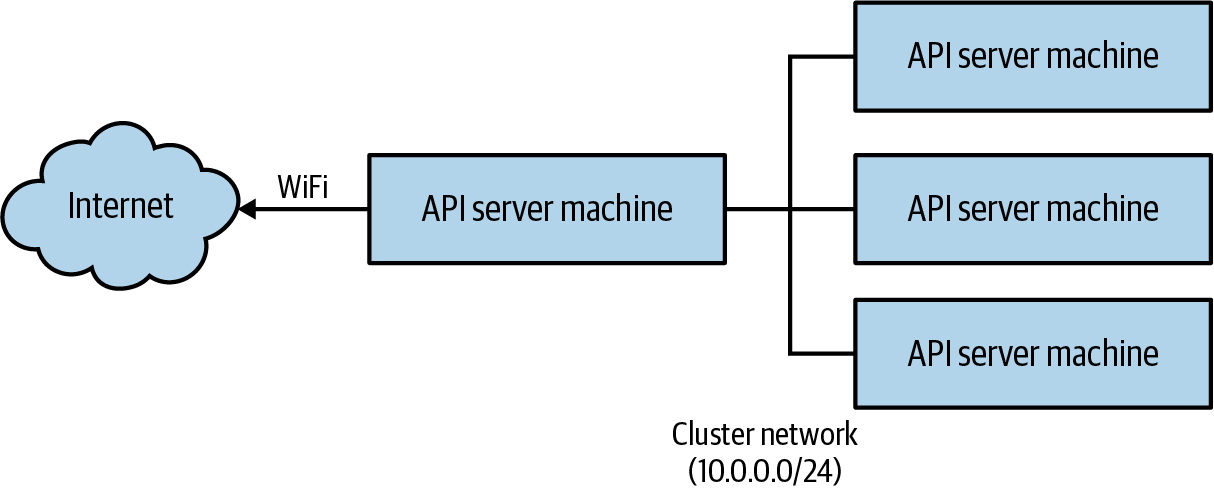

解耦(Decoupling),解耦架构,每个组件通过明确的API和服务负载均衡器 与 其他组件隔离开,API 和负载均衡器把系统的各个部分彼此隔开。

通过 负载均衡器对组件进行解耦,可以很容易扩展成服务的程序规模,当你需要增加程序的规模(也就是提升容量)时,只需要增加实例数量,而不需要调整或重新配置系统的其他层。

当你需要扩展你的服务时,Kubernetes 的不可变(immutable)和声明式(declarative)特性使得扩展实现起来非常简单。

向上扩展服务只需要做一件事:修改配置文件中的一个数字。

也可以配置自动扩缩容(autoscaling),让 Kubernetes 自动替你完成这些事情。

扩展的前提是,集群里有足够的资源可以使用,可以及时扩展机器,创建一台同类型的新机器将它加入集群。

理想的团队规模是所谓的“两块披萨团队(tow-pizza team)”,大约6到8个人,这种规模通常带来良好的知识共享, 快速决策以及共同的目标感。

更大的团队往往会遇到一些问题,如:

解决这种矛盾常见方法,是构建 解耦的、面向服务的团队结构。每个小团队负责构建 一个单独的微服务,每个团队负责其服务的设计和交付,而这个服务会被其他小团队使用。

SLA(Service Level Agreement) 服务级别协议。

比如,应用开发者,只关心 Pod能启动 Service 能访问 负载均衡正常。

至于,节点坏了 磁盘坏了 VM重启,那是 Kubernetes 运维团队的事。

Kubernetes 是一个用于创建、部署和管理分布式应用程序的平台。

关于容器,希望你会使用Docker、了解Docker后再学习 Kubernetes。

容器映像是由一系列文件系统层构成的,每一层都继承并修改之前的层

.

└── container A: a base operating system only, such as Debian

└── container B: build upon #A, by adding Ruby v2.1.10

└── container C: build upon #A, by adding Golang v1.6. (continuing from above)

└── container B: build upon #A, by adding Ruby v2.1.10

└── container D: build upon #B, by adding Rails v4.2.6

└── container E: build upon #B, by adding Rails v3.2.x容器可分为两大类

Dockerfile 可用于自动创建 Docker 容器镜像。

打包一个Node.js 的 Express服务器

package.json

{

"name": "simple-node",

"version": "1.0.0",

"description": "A sample simple application for Kubernetes Up & Running",

"main": "server.js",

"scripts": {

"start": "node server.js"

},

"author": ""

}server.js

var express = require('express');

var app = express();

app.get('/', function (req, res) {

res.send('Hello World!');

});

app.listen(3000, function () {

console.log('Listening on port 3000!');

console.log(' http://localhost:3000');

});将其打包成 Docker 镜像,还需要创建两个文件 .dockerignore

和 Dockerfile

.dockerignore

node_modulesDockerfile

# Start from a Node.js 16 (LTS) image

FROM node:16

# Specify the directory inside the image in which all commands will run

WORKDIR /usr/src/app

# Copy package files and install dependencies

COPY package*.json ./

RUN npm install

RUN npm install express

# Copy all of the app files into the image

COPY . .

# The default command to run when starting the container

CMD [ "npm", "start" ]运行以下命令创建 simple-node Docker映像

docker build -t simple-node .运行一个基于 simple-node 映像的容器

docker run --rm -p 3000:3000 simple-node--rm 表示

容器停止后自动删除。-p 主机端口:容器端口 端口映射。

首先记住,被系统后续层删除的文件实际上仍然存在于镜像中,只是无法访问而已。

.

└── layer A: contains a large file named 'BigFile'

└── layer B: removes 'BigFile'

└── layer C: builds on B by adding a static binary另一个陷阱是 镜像缓存和构建,每次更改一个图层都会更改后面的图层,更改前面图层意味着需要重新构建、重新推送和重新删除。

.

└── layer A: contains a base OS

└── layer B: adds source code server.js

└── layer C: installs the 'node' package与

.

└── layer A: contains a base OS

└── layer B: installs the 'node' package

└── layer C: adds source code server.js后者更好,更改代码后 layer B 不用重新执行,docker有构建缓存。

安全没有捷径可走,不要构建包含密码的容器,不仅包括最终层,还包括镜像中的任何层。

由于容器镜像只专注于运行单个应用程序,因此最佳做法是尽量减少容器镜像中的文件,镜像中的每一个额外库都会为应用程序中出现的漏洞提供一个潜在的载体。

Docker引入了多阶段构建,通过多阶段构建,一个Docker文件实际上可以生成多个镜像,而不是生成一个镜像。

FROM golang:1.17-alpine

# Install Node and NPM

RUN apk update && apk upgrade && apk add --no-cache git nodejs bash npm

# Get dependencies for Go part of build

RUN go get -u github.com/jteeuwen/go-bindata/...

RUN go get github.com/tools/godep

RUN go get github.com/kubernetes-up-and-running/kuard

WORKDIR /go/src/github.com/kubernetes-up-and-running/kuard

# Copy all sources in

COPY . .

# This is a set of variables that the build script expects

ENV VERBOSE=0

ENV PKG=github.com/kubernetes-up-and-running/kuard

ENV ARCH=amd64

ENV VERSION=test

# Do the build. This script is part of incoming sources.

RUN build/build.sh

CMD [ "/go/bin/kuard" ]下面是一个多阶段 Dockerfile

# STAGE 1: Build

FROM golang:1.17-alpine AS build

# Install Node and NPM

RUN apk update && apk upgrade && apk add --no-cache git nodejs bash npm

# Get dependencies for Go part of build

RUN go get -u github.com/jteeuwen/go-bindata/...

RUN go get github.com/tools/godep

WORKDIR /go/src/github.com/kubernetes-up-and-running/kuard

# Copy all sources in

COPY . .

# This is a set of variables that the build script expects

ENV VERBOSE=0

ENV PKG=github.com/kubernetes-up-and-running/kuard

ENV ARCH=amd64

ENV VERSION=test

# Do the build. Script is part of incoming sources.

RUN build/build.sh

# STAGE 2: Deployment

FROM alpine

USER nobody:nobody

COPY --from=build /go/bin/kuard /kuard

CMD [ "/kuard" ]上面 Dockerfile 会生成两个镜像,

第一个是构建镜像,其中包含 Go编译器、React.js 工具链和程序源代码。

第二个是部署镜像,它只包含编译后的二进制文件。

使用多级构建来构建容器镜像,可以讲最终容器镜像的大小减少百兆字节,从而加快部署时间,一般来说部署延迟取决于网络性能。

Docker Hub 是公共仓库平台, 就像Github一样存代码,Docker Hub 用来存Docker镜像。

登录Docker Hub

docker login打tag

docker tag kuard gcr.io/kuar-demo/kuard-amd64:blue将镜像推到Docker Hub

docker push gcr.io/kuar-demo/kuard-amd64:blue| 部分 | 含义 |

|---|---|

gcr.io |

远程镜像仓库地址(Google Container Registry) |

kuar-demo |

项目 / namespace |

kuard-amd64 |

镜像名 |

blue |

tag(版本标签) |

本地镜像

kuard

│

│ docker tag

▼

gcr.io/kuar-demo/kuard-amd64:blue

│

│ docker push

▼

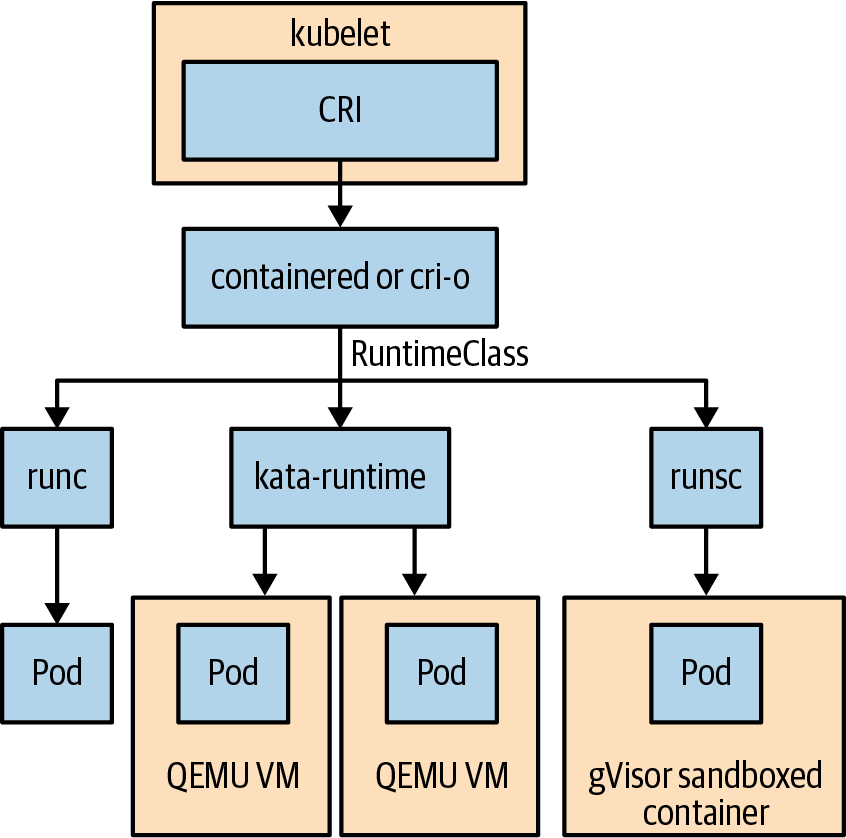

远程仓库 gcr.ioCRI API 由许多不同的程序实现,包括 Docker 构建的containerd-cri 和 Red Hat 贡献的cri-o 实现。安装 Docker 工具时,Docker 守护进程也会安装和使用containerd运行时。

从 Kubernetes 1.25 版开始,只有支持 CRI 的容器运行时才能与 Kubernetes 配合使用。 幸运的是,Kubernetes 托管服务提供商已为 Kubernetes 托管用户实现了几乎自动的过渡。

在 Kubernetes 中,容器通常由每个节点上名为 kubelet 的守护进程启动;

使用Docker命令工具更容易上手容器,Docker CLI工具可用于部署容器。

从 gcr.io/kuar-demo/kuard-amd64:blue 镜像部署容器

$ docker run -d --name kuard \

--publish 8080:8080 \

gcr.io/kuar-demo/kuard-amd64:blue-d 表示在后台运行,守护进程。

--publish 选项可简写为 -p。

--name kuard 给容器起了一个友好的名字。

Docker 通过公开 Linux 内核提供的底层 cgroup 技术,使应用程序能够使用更少的资源。

Kubernetes 同样使用这些功能来限制每个Pod使用的资源。

限制资源利用率,允许多个应用程序在同一硬件上共存,并确保公平使用。

例如限制 200MB 内存 和 1GB 交换空间,请在

docker run 命令中使用 --memory 和

--memory-swap 标志。

停止并删除当前名为 kuard 容器

$ docker stop kuard

$ docker rm kuard$ docker run -d --name kuard \

--publish 8080:8080 \

--memory 200m \

--memory-swap 1G \

gcr.io/kuar-demo/kuard-amd64:blue如果容器中的程序占用过多内存,就会被终止。

限制CPU的使用率 --cpu-shares。它表示

CPU调度权重,1024不是CPU数量,1024不是百分比,只是一个相对权重。

$ docker run -d --name kuard \

--publish 8080:8080 \

--memory 200m \

--memory-swap 1G \

--cpu-shares 1024 \

gcr.io/kuar-demo/kuard-amd64:blue完成构建镜像后,可以使用 docker rmi 命令删除镜像

docker rmi <tag-name>或

docker rmi <image-id>Docker 提供了一个名为 docker system prune

的工具,用于进行常规清理,它将移除所有停止的容器、所有未标记的镜像,

以及作为构建过程一部分缓存的所有未使用的镜像层。

应用程序容器为应用程序提供了一个简洁的抽象,当以 Docker 映像格式打包时,应用程序变得易于构建、部署和分发。容器还能隔离运行在同一台机器上的应用程序,有助于避免依赖冲突。

你需要一个能正常工作的 Kubernetes 集群。此时,大多数公有云中都有基于云的 Kubernetes 服务,只需几条命令行指令就能轻松创建一个集群。

minikube 工具提供了一种简单易用的方法,让本地 Kubernetes 集群在本地笔记本电脑或 台式机的虚拟机中启动运行。虽然这是一个不错的选择,但minikube 只能创建一个单节点集群,并不能完全展示完整 Kubernetes 集群的所有方面。

建议大家从基于 Cloud 的解决方案开始,除非它真的不适合自己的情况。

最近的一个替代方案是运行 Docker-in-Docker 集群,它可以在一台机器上启动一个多节点集群。

如 谷歌云平台 GCP 提供名为谷歌 Kubernetes 引擎(GKE)的托管 Kubernetes 即服务。

# 安装 gcloud 后 设置默认区域

$ gcloud config set compute/zone us-west1-a

# 创建一个集群

$ gcloud container clusters create kuar-cluster --num-nodes=3

# 获取群集的凭据

$ gcloud container clusters get-credentials kuar-clusterMicrosoft Azure 提供托管 Kubernetes 即服务,作为 Azure 容器服务的一部分。

亚马逊提供一种名为 “弹性 Kubernetes 服务(EKS)”的 Kubernetes 托管服务。

可以使用 minikube 安装一个简单的单节点集群。不推荐建议用kind。

https://minikube.sigs.k8s.io/docs/start

root@ser745692301841:/dev_dir# minikube version

minikube version: v1.38.1

commit: c93a4cb9311efc66b90d33ea03f75f2c4120e9b0启动集群

dev@ser745692301841:~$ minikube start

😄 minikube v1.38.1 on Ubuntu 24.04 (kvm/amd64)

✨ Automatically selected the docker driver

❗ Starting v1.39.0, minikube will default to "containerd" container runtime. See #21973 for more info.

🧯 The requested memory allocation of 3072MiB does not leave room for system overhead (total system memory: 3915MiB). You may face stability issues.

💡 Suggestion: Start minikube with less memory allocated: 'minikube start --memory=3072mb'

📌 Using Docker driver with root privileges

👍 Starting "minikube" primary control-plane node in "minikube" cluster

🚜 Pulling base image v0.0.50 ...

💾 Downloading Kubernetes v1.35.1 preload ...

> preloaded-images-k8s-v18-v1...: 910.66 KiB / 272.45 > preloaded-images-k8s-v18-v1...: 1.78 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 0 B [______________ > preloaded-images-k8s-v18-v1...: 2.61 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 1.60 KiB / 519.58 M > preloaded-images-k8s-v18-v1...: 3.17 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 65.75 KiB / 519.58 > preloaded-images-k8s-v18-v1...: 3.19 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 433.69 KiB / 519.58 > preloaded-images-k8s-v18-v1...: 3.66 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 929.64 KiB / 519.58 > preloaded-images-k8s-v18-v1...: 4.11 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 1.36 MiB / 519.58 M > preloaded-images-k8s-v18-v1...: 4.56 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 1.81 MiB / 519.58 M > preloaded-images-k8s-v18-v1...: 5.00 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 2.27 MiB / 519.58 M > preloaded-images-k8s-v18-v1...: 5.47 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 2.72 MiB / 519.58 M > preloaded-images-k8s-v18-v1...: 5.91 MiB / 272.45 M > gcr.io/k8s-minikube/kicbase...: 3.17 MiB / 519.58 M > > preloaded-images-k8s-v18-v1...: 57.00 MiB / 272.45 MiB 20.92% 2.15 MiB这将创建一个本地虚拟机,配置 Kubernetes,并创建指向该集群的本地kubectl 配置。 如前所述,这个集群只有一个节点,所以虽然它很有用,但与 Kubernetes 的大多数生产部署存在一些差异。

完成群集操作后,您可以使用以下命令停止虚拟机:

dev@ser745692301841:~$ minikube stop

✋ Stopping node "minikube" ...

🛑 Powering off "minikube" via SSH ...

🛑 1 node stopped.删除集群,可以运行

dev@ser745692301841:~$ minikube delete

🔥 Deleting "minikube" in docker ...

🔥 Deleting container "minikube" ...

🔥 Removing /home/dev/.minikube/machines/minikube ...

💀 Removed all traces of the "minikube" cluster.清理 minikube

dev@ser745692301841:/usr/local$ minikube delete --all --purge

🔥 Successfully deleted all profiles

💀 Successfully purged minikube directory located at - [/home/dev/.minikube]

dev@ser745692301841:/usr/local$最近开发的一种运行一个 Kubernetes 集群的不同方法,使用 Docker 容器模拟多个 Kubernetes 节点,而不是在虚拟机中运行一切。kind = Kubernetes IN Docker

Docker 容器 = Kubernetes节点

多个容器 = 一个 Kubernetes集群

你的电脑

│

├─ Docker

│ ├─ container (control-plane)

│ ├─ container (worker)

│ └─ container (worker)

│

└─ Kubernetes cluster也就是说你不用准备一堆虚拟机,就能在本地快速跑一个完整的 Kubernetes 集群。

安装docker,kind本质依赖Docker

sudo apt update

sudo apt install -y docker.io

sudo systemctl enable docker

sudo systemctl start docker确认

docker version安装 kubectl,没有 kubectl,Kubernetes等于没装。

curl -LO https://dl.k8s.io/release/stable.txt

VERSION=$(cat stable.txt)

curl -LO https://dl.k8s.io/release/${VERSION}/bin/linux/amd64/kubectl

install -o root -g root -m 0755 kubectl /usr/local/bin/kubectl

kubectl version --client

root@ser745692301841:~# kubectl version --client

Client Version: v1.35.2

Kustomize Version: v5.7.1

root@ser745692301841:~#安装kind

curl -Lo ./kind https://kind.sigs.k8s.io/dl/latest/kind-linux-amd64

chmod +x kind

sudo mv kind /usr/local/bin/

root@ser745692301841:~# kind version

kind v0.32.0-alpha+c62c35f841826f go1.25.7 linux/amd64

root@ser745692301841:~#创建一个简单的集群

root@ser745692301841:~# kind create cluster

Creating cluster "kind" ...

✓ Ensuring node image (kindest/node:v1.35.1) 🖼

✓ Preparing nodes 📦

✓ Writing configuration 📜

✓ Starting control-plane 🕹️

✓ Installing CNI 🔌

✓ Installing StorageClass 💾

Set kubectl context to "kind-kind"

You can now use your cluster with:

kubectl cluster-info --context kind-kind

Have a nice day! 👋检查,查看节点

root@ser745692301841:~# kubectl get nodes

NAME STATUS ROLES AGE VERSION

kind-control-plane Ready control-plane 42s v1.35.1kind的每个节点其实都是Docker容器

root@ser745692301841:~# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

cb81fdc1353b kindest/node:v1.35.1 "/usr/local/bin/entr…" About a minute ago Up About a minute 127.0.0.1:46063->6443/tcp kind-control-plane创建多节点集群

配置文件yaml

kind: Cluster

apiVersion: kind.x-k8s.io/v1alpha4

nodes:

- role: control-plane

- role: worker

- role: worker创建

kind create cluster --config cluster.yamlkind删除集群

删除默认集群,默认名字叫kind

kind delete cluster删除指定名字的集群,如果创建的时候用了名字

# 创建时

kind create cluster --name mycluster

# 删除时

kind delete cluster --name mycluster验证删除了

root@ser745692301841:/dev_dir/avant# kind get clusters

No kind clusters found.kind 集群在一台机器里跑,但想让公网用户直接访问 Kubernetes 里的 Service。

问题在于一个残酷现实:kind 本质就是 Docker 容器里的 Kubernetes。所以 Service 的 IP(ClusterIP、甚至 NodeIP)基本都在 Docker 网络内部,外面的人根本看不到。

最简单粗暴 NodePort + 宿主机端口映射

Kubernetes 本身支持 Kubernetes 的 NodePort,但在 kind 里 Node 也是容器,所以还得再映射一层端口。

创建 NodePort Service

apiVersion: v1

kind: Service

metadata:

name: web

spec:

type: NodePort

selector:

app: web

ports:

- port: 80

targetPort: 80

nodePort: 30080访问路径会变成

宿主机IP:30080,但问题是,kind的nodePort没有暴露到宿主机还在Docker容器内。

创建kind集群时映射端口,建集群时写config

# kind-config.yaml

kind: Cluster

apiVersion: kind.x-k8s.io/v1alpha4

nodes:

- role: control-plane

extraPortMappings:

- containerPort: 30080

hostPort: 80

protocol: TCPkind create cluster --config kind-config.yaml标准点的方案Ingress

安装NGINX Ingress Controller

kubectl apply -f https://raw.githubusercontent.com/kubernetes/ingress-nginx/main/deploy/static/provider/kind/deploy.yaml然后在 kind config里映射 80/443

nodes:

- role: control-plane

extraPortMappings:

- containerPort: 80

hostPort: 80

- containerPort: 443

hostPort: 443之后外部访问流程

Internet

│

│ 80

▼

Host Machine

│

│ port mapping

▼

kind control-plane container

│

│ Ingress

▼

Service

│

▼

Podroot@ser745692301841:/dev_dir/k8s# kind delete cluster

Deleting cluster "kind" ...

Deleted nodes: ["kind-worker2" "kind-control-plane" "kind-worker"]

root@ser745692301841:/dev_dir/k8s# cat cluster.yaml

kind: Cluster

apiVersion: kind.x-k8s.io/v1alpha4

nodes:

- role: control-plane

extraPortMappings:

- containerPort: 30000

hostPort: 80

protocol: TCP

- role: worker

- role: worker

root@ser745692301841:/dev_dir/k8s# kind create cluster --config cluster.yaml

Creating cluster "kind" ...

✓ Ensuring node image (kindest/node:v1.35.1) 🖼

✓ Preparing nodes 📦 📦 📦

✓ Writing configuration 📜

✓ Starting control-plane 🕹️

✓ Installing CNI 🔌

✓ Installing StorageClass 💾

✓ Joining worker nodes 🚜

Set kubectl context to "kind-kind"

You can now use your cluster with:

kubectl cluster-info --context kind-kind

Not sure what to do next? 😅 Check out https://kind.sigs.k8s.io/docs/user/quick-start/

root@ser745692301841:/dev_dir/k8s# kubectl get nodes

NAME STATUS ROLES AGE VERSION

kind-control-plane Ready control-plane 30s v1.35.1

kind-worker NotReady <none> 16s v1.35.1

kind-worker2 NotReady <none> 15s v1.35.1

root@ser745692301841:/dev_dir/avant# cat avant-deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: avant-deployment

spec:

replicas: 3

selector:

matchLabels:

app: avant

template:

metadata:

labels:

app: avant

spec:

volumes:

- name: avant-data

hostPath:

path: /var/www/html

containers:

- name: avant

image: gaowanlu/avant:latest

imagePullPolicy: IfNotPresent

ports:

- containerPort: 20023

name: http

protocol: TCP

resources:

requests:

cpu: "1000m"

memory: "128Mi"

limits:

cpu: "2000m"

memory: "512Mi"

volumeMounts:

- name: avant-data

mountPath: "/avant_static"

livenessProbe:

httpGet:

path: /

port: 20023

initialDelaySeconds: 120

timeoutSeconds: 10

periodSeconds: 30

failureThreshold: 5

readinessProbe:

httpGet:

path: /

port: 20023

initialDelaySeconds: 120

timeoutSeconds: 10

periodSeconds: 30

failureThreshold: 5

---

apiVersion: v1

kind: Service

metadata:

name: avant-service

spec:

type: NodePort

externalTrafficPolicy: Cluster

selector:

app: avant

ports:

- protocol: TCP

port: 80

targetPort: 20023

nodePort: 30000

root@ser745692301841:/dev_dir/avant# kubectl apply -f avant-deployment.yaml

deployment.apps/avant-deployment created

service/avant-service created

# 公网能访问kind搭建的k8s集群的service了

root@ser745692301841:/dev_dir/avant# curl http://0.0.0.0:80

hello worldKubernetes的官方客户端是kubectl,一个与Kubernetes API交互的命令行工具。

kubectl 可以管理大多数 Kubernetes 对象,如 Pod、ReplicaSets、Services,也可以用于探索和验证集群的整体健康状况。

检查集群状态

root@ser745692301841:/dev_dir/note# kubectl version

Client Version: v1.35.2

Kustomize Version: v5.7.1

Server Version: v1.35.1可以对集群进行简单的诊断,这是验证集群总体健康状况的好方法

root@ser745692301841:/dev_dir/note# kubectl get componentstatuses

Warning: v1 ComponentStatus is deprecated in v1.19+

NAME STATUS MESSAGE ERROR

scheduler Healthy ok

controller-manager Healthy ok

etcd-0 Healthy ok 这里可以看到组成 Kubernetes 集群的各个组件。

controller-manager

负责运行调节集群行为的各种控制器,如确保服务的所有副本都可以用且健康。scheduler 负责将不同的Pod放到集群中的不同节点上。etcd

服务器是集群的存储设备,所有API对象都存储在这里。可以列出集群中的所有节点

root@ser745692301841:/dev_dir/note# kubectl get nodes

NAME STATUS ROLES AGE VERSION

kind-control-plane Ready control-plane 12m v1.35.1这是一个运行了12分钟的1节点集群。在 Kubernetes中,节点被分为

Kubernetes一般不会将工作调度到 control-plane节点上,以确保用户工作负载不会损害集群的整体运行。

可以使用 kubectl describe 命令获取有关特定节点的更多信息,如 kube1

root@ser745692301841:/dev_dir/note# kubectl describe nodes kind-control-plane

Name: kind-control-plane

Roles: control-plane

Labels: beta.kubernetes.io/arch=amd64

beta.kubernetes.io/os=linux

kubernetes.io/arch=amd64

kubernetes.io/hostname=kind-control-plane

kubernetes.io/os=linux

node-role.kubernetes.io/control-plane=

Annotations: node.alpha.kubernetes.io/ttl: 0

volumes.kubernetes.io/controller-managed-attach-detach: true

CreationTimestamp: Wed, 11 Mar 2026 11:41:11 +0000

Taints: <none>

Unschedulable: false

Lease:

HolderIdentity: kind-control-plane

AcquireTime: <unset>

RenewTime: Wed, 11 Mar 2026 11:56:34 +0000

Conditions:

Type Status LastHeartbeatTime LastTransitionTime Reason Message

---- ------ ----------------- ------------------ ------ -------

MemoryPressure False Wed, 11 Mar 2026 11:52:59 +0000 Wed, 11 Mar 2026 11:41:08 +0000 KubeletHasSufficientMemory kubelet has sufficient memory available

DiskPressure False Wed, 11 Mar 2026 11:52:59 +0000 Wed, 11 Mar 2026 11:41:08 +0000 KubeletHasNoDiskPressure kubelet has no disk pressure

PIDPressure False Wed, 11 Mar 2026 11:52:59 +0000 Wed, 11 Mar 2026 11:41:08 +0000 KubeletHasSufficientPID kubelet has sufficient PID available

Ready True Wed, 11 Mar 2026 11:52:59 +0000 Wed, 11 Mar 2026 11:41:35 +0000 KubeletReady kubelet is posting ready status

Addresses:

InternalIP: 172.18.0.2

Hostname: kind-control-plane

Capacity:

cpu: 4

ephemeral-storage: 50620216Ki

hugepages-1Gi: 0

hugepages-2Mi: 0

memory: 4009176Ki

pods: 110

Allocatable:

cpu: 4

ephemeral-storage: 50620216Ki

hugepages-1Gi: 0

hugepages-2Mi: 0

memory: 4009176Ki

pods: 110

System Info:

Machine ID: a571291cce3a40dd97170c3d6b97b59c

System UUID: a7abdd46-57c6-413f-be98-f4b43b810536

Boot ID: 6019958d-3d9a-47be-bbb8-b9efb77d3bcb

Kernel Version: 6.8.0-90-generic

OS Image: Debian GNU/Linux 13 (trixie)

Operating System: linux

Architecture: amd64

Container Runtime Version: containerd://2.2.1

Kubelet Version: v1.35.1

Kube-Proxy Version:

PodCIDR: 10.244.0.0/24

PodCIDRs: 10.244.0.0/24

ProviderID: kind://docker/kind/kind-control-plane

Non-terminated Pods: (9 in total)

Namespace Name CPU Requests CPU Limits Memory Requests Memory Limits Age

--------- ---- ------------ ---------- --------------- ------------- ---

kube-system coredns-7d764666f9-9ct7w 100m (2%) 0 (0%) 70Mi (1%) 170Mi (4%) 15m

kube-system coredns-7d764666f9-hr26r 100m (2%) 0 (0%) 70Mi (1%) 170Mi (4%) 15m

kube-system etcd-kind-control-plane 100m (2%) 0 (0%) 100Mi (2%) 0 (0%) 15m

kube-system kindnet-5x9l9 100m (2%) 100m (2%) 50Mi (1%) 50Mi (1%) 15m

kube-system kube-apiserver-kind-control-plane 250m (6%) 0 (0%) 0 (0%) 0 (0%) 15m

kube-system kube-controller-manager-kind-control-plane 200m (5%) 0 (0%) 0 (0%) 0 (0%) 15m

kube-system kube-proxy-zxp5z 0 (0%) 0 (0%) 0 (0%) 0 (0%) 15m

kube-system kube-scheduler-kind-control-plane 100m (2%) 0 (0%) 0 (0%) 0 (0%) 15m

local-path-storage local-path-provisioner-84669cbbb8-mw7l8 0 (0%) 0 (0%) 0 (0%) 0 (0%) 15m

Allocated resources:

(Total limits may be over 100 percent, i.e., overcommitted.)

Resource Requests Limits

-------- -------- ------

cpu 950m (23%) 100m (2%)

memory 290Mi (7%) 390Mi (9%)

ephemeral-storage 0 (0%) 0 (0%)

hugepages-1Gi 0 (0%) 0 (0%)

hugepages-2Mi 0 (0%) 0 (0%)

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal RegisteredNode 15m node-controller Node kind-control-plane event: Registered Node kind-control-plane in Controller

root@ser745692301841:/dev_dir/note# 其中 Name、Role、Labels 可以看到,节点正在什么处理器上运行Linux操作系统。

Conditions 可以看到运行信息。Capacity 状态现实节点磁盘和内存空间信息,System Info 显示 Docker版本、Kubernetes和Linux内核版本等等。

Non-terminated Pods 当前在该节点上运行的Pod的信息。

可以看到节点上的Pod(如,为集群提供DNS服务的 kube-dns Pod)、每个 Pod 向节点请求的 CPU 和内存,以及请求的总资源。

Kubernetes 会同时跟踪在机器上运行的每个 Pod 的资源请求和上限。

Pod 请求的资源保证存在于节点上,而 Pod 的限制则是 Pod 可以消耗的给定资源的最大数量。Pod 的限制可能高于其请求,在这种情况下,额外的资源会尽力提供。不保证节点上一定有这些资源。

组成Kubernetes集群的许多组件实际上是使用Kubernetes本身部署的。所有这些组件都在

kube-system 命名空间中运行。

Kubernetes代理负责将网站流量路由到 Kubernetes

集群中的负载平衡服务。代理存在于集群中的每个节点上, Kubernetes

有一个名为 DaemonSet 的API对象。

查看 kube-system 命令空间里的 kube-proxy

DaemonSet 装。

root@ser745692301841:/dev_dir/note# kubectl get daemonSets --namespace=kube-system kube-proxy

NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE NODE SELECTOR AGE

kube-proxy 1 1 1 1 1 kubernetes.io/os=linux 31mKubernetes还运行了一个DNS服务器,为集群中定义的服务提供命名和发现功能。

DNS 服务器也作为集群上的复制服务运行。根据集群的规模,您可能会看到一个或多个 DNS 服务器在集群中运行。DNS 服务作为 Kubernetes 部署运行,由 Kubernetes 来管理这些副本(这也可能被命名为 或其他变体):coredns

root@ser745692301841:/dev_dir/note# kubectl get deployments --namespace=kube-system coredns

NAME READY UP-TO-DATE AVAILABLE AGE

coredns 2/2 2 2 44m

root@ser745692301841:/dev_dir/note# kubectl get svc -n kube-system

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kube-dns ClusterIP 10.96.0.10 <none> 53/UDP,53/TCP,9153/TCP 44m这表明集群的DNS服务地址为

10.96.0.10,如果登录集群中的容器,就会发现该地址已被填入容器

/etc/resolv.conf 文件中。

大多数云提供商都会把可视化集成到其云的图形用户界面。集群仪表盘。还可以用 Visual Studio Code 等开发环境的扩展,查看集群的状态。

此时已经建立了运行一个(或三个)Kubernetes集群,使用了一些命令探索创建的集群。下面将会学习掌握 kubectl 工具。

kubectl 命令行工具,可以用它来创建对象并于Kubernetes API交互。

Kubernetes 使用命名空间来组织集群中的对象。

默认情况下,kubectl 命令行工具与 default 命名空间交互。可以传递

--namespace 标志 如 --namespace=mystuff 引用

mystuff 命名空间中的对象。也可以使用 -n 缩写标记。

与所有命名空间交互,可以传递 --all-namespace 标志。

kubectl 会把集群连接信息、用户认证信息、上下文等内容都存到一个文件里。

说人话,context 上下文 本质就是一条配置,告诉 kubectl三件事,连接哪个集群?用哪个用户身份认证?默认使用哪个 namespace?

root@ser745692301841:/dev_dir/note# cat $HOME/.kube/config里面主要内容包含三类

context = cluster + user + namespace创建一个新的 context,一个叫 my-context 的 context 默认namespace 设为 mystuff。这只是写进配置文件,还没有启用。

root@ser745692301841:/dev_dir/note# kubectl config set-context my-context --namespace=mystuff

Context "my-context" created.启用这个 context

root@ser745692301841:/dev_dir/note# kubectl config use-context my-context

Switched to context "my-context".

root@ser745692301841:/dev_dir/note# 从这一刻,所有 kubectl 命名默认都会在 mystuff namespace 里执行。

例如

kubectl get pods

# 实际等价于

kubectl get pods -n mystuff

# 查看当前context

root@ser745692301841:/dev_dir/note# kubectl config current-context

my-context

# 查看所有context

root@ser745692301841:/dev_dir/note# kubectl config get-contexts

CURRENT NAME CLUSTER AUTHINFO NAMESPACE

kind-kind kind-kind kind-kind

* my-context mystuff

# 切换context

root@ser745692301841:/dev_dir/note# kubectl config use-context kind-kind

Switched to context "kind-kind".

# 删除context

root@ser745692301841:/dev_dir/note# kubectl config delete-context my-context

deleted context my-context from /root/.kube/config

# 查看所有context

root@ser745692301841:/dev_dir/note# kubectl config get-contexts

CURRENT NAME CLUSTER AUTHINFO NAMESPACE

* kind-kind kind-kind kind-kind kubectl 本质是 Kubernetes API 的客户端。

kubectl

↓

HTTP 请求

↓

Kubernetes API Server

↓

REST API 对象在 Kubernetes 中,所有内容都被标识为 RESTful 资源。这些资源被称为 Kubernetes 对象(Kubernetes Objects)。

每个 Kubernetes 对象都有一个唯一的HTTP路径,如

https://your-k8s.com/api/v1/namespaces/default/pods/my-pod这个URL表示,namespace是default,资源类型为 pods,pod名称为

my-pod, 也就是这个地址对应 default 命名空间里的

my-pod Pod对象。

kubectl 命名其实就是在向这些URL发送HTTP请求,从而获取或操作Kubernetes对象。

查看 Kubernetes 对象

最基础的命令是

kubectl get <resource-name>

# 例如

root@ser745692301841:/dev_dir/note# kubectl get pods

No resources found in default namespace.

# 如果想要查看具体对象

kubectl get <resource-name> <obj-name>

# 例如

kubectl get pods my-pod输出格式

默认情况,kubectl 会使用可读格式显示数据,为了让每个对象只占一行,它会隐藏很多字段。

kubectl get pods -o wide其中 -o wide 会显示更多字段,例如 Pod

IP、Node、Image。

查看完整对象

如果想看完整数据结构,可以输出

# JSON

kubectl get pod my-pod -o json

# YAML

kubectl get pod my-pod -o yaml去掉表头

有时需要配合Linux管道,比如

kubectl get pods | awk ...这时表头反而是干扰。

可以

--no-headers

# 例如

kubectl get pods --no-headers提取特定字段JSONPath

有时只想拿对象里的某个字段,例如 Pod IP

kubectl支持JSONPath查询语言

kubectl get pods my-pod -o jsonpath --template={.status.podIP}

10.244.1.12

# 意思是 .status.podID 这个字段同时查看多种资源

可以用 逗号分隔,同时列出 Pods、Services

root@ser745692301841:/dev_dir/note# kubectl get pods,services

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 19h查看对象详细信息

想看更详细的说明,可以用

kubectl describe <resource-name> <obj-name>

# 例如

root@ser745692301841:/dev_dir/note# kubectl describe services kubernetes

Name: kubernetes

Namespace: default

Labels: component=apiserver

provider=kubernetes

Annotations: <none>

Selector: <none>

Type: ClusterIP

IP Family Policy: SingleStack

IP Families: IPv4

IP: 10.96.0.1

IPs: 10.96.0.1

Port: https 443/TCP

TargetPort: 6443/TCP

Endpoints: 172.18.0.2:6443

Session Affinity: None

Internal Traffic Policy: Cluster

Events: <none>查看字段说明,如果不知道某个资源有哪些字段,可以用

kubectl explain pods

# 例如

kubectl explain pods.spec实时监控资源变化

有时需要持续观察资源变化,如:Pod重启、Deployment rollout、Job完成

可以用

--watch

# 例子

root@ser745692301841:/dev_dir/note# kubectl get services --watch

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 19h80%的排错都在用

kubectl get

kubectl describe

kubectl logs回到现实,所有东西其实就是一堆 JSON、YAML文件配置,Kubernetes也没例外,它把这些文件叫做 Kubernetes 对象(Objects)

Kubernetes对象的表示方式

在Kubernetes API中,对象通常用两种格式表示:

这些文件可能来自两种地方:

Kubernetes的世界基本就是:写 YAML → 发给 API Server → 服务器保存状态

创建对象

例如有一个 obj.yaml,创建对象的命令

apiVersion: v1

kind: Pod

metadata:

name: mypod创建对象的命令,不要慌 我们还没学yaml怎么写,有哪些字段,先直到 kubectl 的大致命令就好

root@ser745692301841:/dev_dir/k8s# kubectl apply -f obj.yaml

The Pod "mypod" is invalid: spec.containers: Required value其中 -f 表示file,

不需要指定资源类型,因为YAML里面已经写了.

更新对象

修改 obj.yaml 后,再执行一次

kubectl apply -f obj.yamlapply的行为是:只更新有变化的部分

如果对象:

预览 apply(dry-run)

如果你不确定 apply 会做什么,可以先预览:

kubectl apply -f obj.yaml --dry-run=client效果:不会真的发送到服务器,只会在终端显示结果,等于 Kubernetes的 “试运行模式”

交互式编辑对象

如果你不想修改本地YAML,可以直接编辑集群里的对象

kubectl edit <resource> <name>

# 例如

kubectl edit deployment nginx流程:

查看apply历史

kubectl apply 会把最后一次配置记录在对象的 annotation 里。

| 命令 | 作用 |

|---|---|

view-last-applied |

查看最后一次 apply |

edit-last-applied |

编辑最后一次 apply |

set-last-applied |

手动设置 |

# 示例

kubectl apply -f myobj.yaml view-last-applied

# 会显示

kubectl.kubernetes.io/last-applied-configuration

# 里面就是上次的YAML删除对象

kubectl delete -f obj.yaml不会提示确认,命令执行后对象就没了,人们经常在生产环境打出这个命令后瞬间沉默三秒。

通过资源名删除

kubectl delete <resource> <name>例如

# 删除 Pod

kubectl delete pod nginx

# 删除 Deployment

kubectl delete deployment web用 kubectl 的人,基本天天用的就是这几个

kubectl get

kubectl describe

kubectl apply

kubectl delete

kubectl logsLabel(标签) 和 Annotation(注解) 本质上都是给 Kubernetes 对象打的“标记”。

例如,给一个叫 bar 的Pod添加一个 color=red 的标签。

kubectl label pods bar color=red

# annotation 的语法完全一样默认情况下,kubectl label 和

kubectl annotate 不会覆盖已存在的标签。非要改的话

kubectl label pods bar color=blue --overwrite删除Label

kubectl label pods bar color-

# 意思是 删除 Pod bar上的color标签Kubernetes提供了一些 kubectl 命令,用来查看日志、进入容器、复制文件、端口转发、查看事件和资源使用情况。基本所有线上问题都离不开这些命令。

查看容器日志

查看某个Pod中容器的日志

kubectl logs <pod-name>例如

kubectl logs my-pod如果一个Pod里有多个 container,需要指定容器

kubectl logs <pod-name> -c <container-name>

# 例如

kubectl logs my-pod -c nginx实时查看日志,默认只打印当前日志然后退出,如果想 持续输出日志

kubectl logs -f <pod-name>在容器中执行命令

作用:进入运行中的容器执行命令

kubectl exec -it <pod-name> -- bash| 参数 | 作用 |

|---|---|

-i |

保持 stdin 打开 |

-t |

分配终端 |

-- |

后面是容器里的命令 |

示例

kubectl exec -it my-pod -- bash

# 如果容器没有bash,很多alpine镜像没有

kubectl exec -it my-pod -- shattach到容器进程

kubectl attach -it <pod-name>它的作用是:连接到容器当前运行的进程,类似

docker attach| 命令 | 作用 |

|---|---|

| logs | 只看输出 |

| attach | 可以输入 |

前提:容器程序必须读取 stdin,很多web服务用不上这个。

复制文件

复制文件(Pod ↔︎ 本地)。

从容器复制文件到本地:

kubectl cp <pod-name>:</path/to/remote/file> </path/to/local/file>

# 例子

kubectl cp my-pod:/tmp/test.log ./test.log从本地复制到容器

kubectl cp ./text.log my-pod:/tmp/test.log支持 目录复制

Pod端口转发

kubectl port-forward <pod-name> 8080:80意思是,本地 8080 转发到 Pod 80,访问 localhost:8080

就等于访问 Pod:80。

Service端口转发

kubectl port-forward service/<service-name> 8080:80只会转发到一个Pod,不会走 Service 的负载均衡。

查看Kubernetes事件

查看最新10个事件,比如 Pod创建、Pod调度、Pod启动失败、镜像拉取失败。

kubectl get events实时查看事件,持续输出

kubectl get events --watch查看所有 namespace:

kubectl get events -A查看资源使用情况

查看 节点资源,输出 CPU 使用量、内存使用量、使用百分比。

NAME CPU(cores) CPU% MEMORY(bytes) MEMORY%

node-1 300m 15% 1.2Gi 40%查看Pod资源

# 默认只显示当前 namespace

kubectl top pods

# 查看所有

kubectl top pods --all-namespaceskubectl top 能不能用取决于

metrics-server,是否安装,没装会报错

root@ser745692301841:/dev_dir/k8s# kubectl top nodes

error: Metrics API not available

root@ser745692301841:/dev_dir/k8s# kubectl top pods

error: Metrics API not available大多数 云 Kubernetes 都自带,EKS、GKE、AKS,自己搭的集群如 minikube、kubeadm 可能都要手动安装。

准备修服务器时,先把活儿挪走再动刀子。 不然容器直接被你干掉,业务就跟着躺平。

kubectl也能管理集群节点

kubectl 不只是用来看 Pod、Service 这些对象,它还可以 管理整个集群的节点(Node)。最常见的两个

场景:服务器硬件维修、系统升级、Kubernetes 节点维护、机器要重启

cordon:给节点挂个 暂停营业的牌子

kubectl cordon <node-name>禁止新的Pod被调度到这个节点上,已经在运行的Pod不会动,只会以后不让新Pod来。像饭店挂个牌子,今日不接新客、但店里正在吃饭的人你总不能赶出去。

drain:把这个节点的 Pod 全部赶走,把节点上所有 Pod 都迁移走。

kubectl drain <node-name>Kubernetes 先删除这些 Pod、然后调度器会在其他节点重新创建。有些Pod不让删比如 DaemonSet、没控制器的裸Pod,所以通常会这么写:

kubectl drain <node-name> --ignore-daemonsets修完之后:uncordon,把停止营业牌子去掉,调度器可以像这个节点分配Pod

kubectl uncordon node1kubectl 支持 Shell 自动补全。

例如

kubectl get po<Tab>

# 会自动补全成

kubectl get pods如果资源很多,Tab还能列出候选项。

apt-get install bash-completion临时启用kubectl自动补全

source <(kubectl completion bash)效果:当前terminal有自动补全,关闭terminal就没了。

| 方式 | 工具 | 特点 |

|---|---|---|

| 命令行 | kubectl | 最标准、最强大 |

| IDE 插件 | VS Code / IntelliJ / Eclipse | 开发体验好 |

| 图形界面 | Rancher / Headlamp / 云平台控制台 | 可视化管理 |

kubectl 是一个非常强大的命令行工具,用来管理你在 Kubernetes 集群中的 应用程序和资源。

上面只是展示了 kubectl 的一些常见用法,实际上还有很多很多其他功能。

kubectl help例如

kubectl help get

kubectl help apply

kubectl help logs| 命令 | 作用 |

|---|---|

kubectl help |

查看所有命令 |

kubectl help get |

查看某个命令 |

kubectl get --help |

另一种查看方式 |

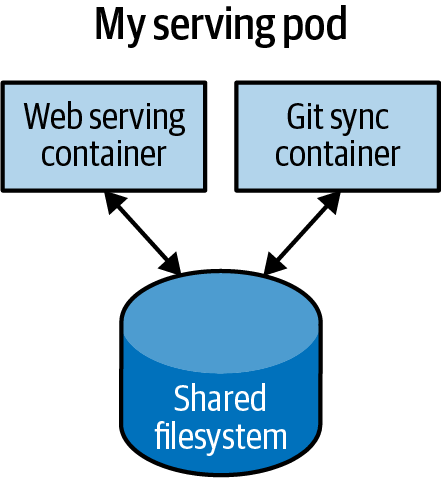

容器化应用程序的实际部署中,通常希望多个应用程序集中到一个原子单元中,并调度到 一台机器上。

例如下面的 Pod,其中包含一个为网络请求提供服务的容器和一个将文件系统与远程Git仓库同步的容器。

这两个容器是相当共生的,在一台机器上调度网络服务器, 在另一台机器上调度Git同步器是没有意义的。Kubernetes 将多个容器组合成一个原子单元,称为Pod。

Pod是在同一执行环境中运行的应用程序容器和卷的集合。

Pod 是 Kubernetes 集群中最小的可部署工件,而不是容器。这意味着 Pod 中的所有容器始终位于同一台机器上。

Pod 中的每个容器都在自己的 cgroup 中运行,但它们共享一些 Linux 命名空间。

同Pod中运行的应用程序

不同Pod中的应用程序是相互隔离的,它们拥有不同的IP地址、主机名等。

在同一节点上运行的不同Pod中的容器,也可能在不同的服务器上。

当人们开始使用Kubernetes时,最常见的问题之一是:

“我应该把什么放进一个Pod里?”

共生关系

例如 WorldPress 和 数据库 并不是共生关系,分别放在不同机器上,它们通过网络连接依然可以工作,把它们硬塞到一个Pod并没有必要。

扩缩容策略

WordPress和MySQL的扩展方式不同

WordPress基本是无状态,可以增加Pod来扩容。MySQL是有状态且扩展很复杂,通常做法是增加单个数据库实例的资源CPU和内存,或者做复杂的数据库集群。

把它们放进一个Pod里,显然是非常扯淡的。

设计Pod的正确思考方式

应该问自己:如果这些容器被调度到不同机器上,它们还能正常工作吗?

简单规则,“必须在同一台机器上才能正常工作的容器,才应该放进同一个 Pod”

Pod是通过 Pod Manifest来描述的,本质上就是 Kubernetes API对象的一种文本文件表示。

Kubernetes强调 声明式配置 思想,把系统“期望达到的状态”写在一个配置文件里,然后把这个配置提交给某个服务,由这个服务负责采取各种操作,让系统最终达到这个期望状态。

Kubernetes调度器会尽量把同一个应用的Pod分散到不同机器上,从而提高系统在发生故障时的可靠性。

一旦Pod被调度到某个节点,它不会自动迁移到别的节点,如果需要换节点必须 销毁Pod、重新调度创建新Pod。

想运行多个Pod实例,推荐使用 ReplicaSet,来管理多个Pod副本。

总之,写YAML(描述你想要什么),Kubernetes自动帮你实现,如果坏了它会自己“修”。

创建Pod最简单的方法,是使用 命令式 的 kubectl run

命令。

例如

root@ser745692301841:/dev_dir/note# kubectl run kuard \

--image=nginx

pod/kuard created

root@ser745692301841:/dev_dir/note# kubectl get pods

NAME READY STATUS RESTARTS AGE

kuard 0/1 ContainerCreating 0 11s

root@ser745692301841:/dev_dir/note# kubectl get pods

NAME READY STATUS RESTARTS AGE

kuard 1/1 Running 0 64s

# 删除Pod

root@ser745692301841:/dev_dir/note# kubectl delete pod kuard

pod "kuard" deleted from default namespace

root@ser745692301841:/dev_dir/note# kubectl get pods

No resources found in default namespace.可以使用YAML和JSON来编写Pod的清单文件,更推荐YAML。

Pod配置通常包含几个关键字段和属性

例如 docker 部署的

$ docker run -d --name kuard \

--publish 8080:8080 \

gcr.io/kuar-demo/kuard-amd64:blue写一个 Pod 配置文件,kuard-pod.yaml,然后使用 kubectl 命令把该配置加载到 Kubernetes 集群中。

kuard-pod.yaml

apiVersion: v1

kind: Pod

metadata:

name: kuard

spec:

containers:

- name: kuard

image: gcr.io/kuar-demo/kuard-amd64:blue

ports:

- containerPort: 8080

name: http

protocol: TCP显示几乎没人直接用Pod,因为Pod 不会自动重启、不会自动扩容、不会滚动升级,真实环境一般用 Deployment 来管理Pod。

可以用pod的yaml启动一个运行kuard的Pod,使用 kubectl apply 命令

$ kubectl apply -f kuard-pod.yaml这个 Pod 配置文件 会被提交到 Kubernetes API Server,系统把这个Pod调度到集群中 的某个健康节点(node)上运行。在该节点上,kubelet 守护进程 会持续监控这个 Pod 的运行状态。

Nginx Pod示例

nginx-pod.yaml

apiVersion: v1

kind: Pod

metadata:

name: nginx-pod

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx:latest

ports:

- containerPort: 80

protocol: TCP创建一个 nginx-pod Pod实例

root@ser745692301841:/dev_dir/k8s# kubectl apply -f nginx-pod.yaml

pod/nginx-pod created查看运行状态

root@ser745692301841:/dev_dir/k8s# kubectl get pods

NAME READY STATUS RESTARTS AGE

nginx-pod 1/1 Running 0 34s

root@ser745692301841:/dev_dir/k8s# kubectl delete pod nginx-pod

pod "nginx-pod" deleted from default namespace你会发现不能访问,Pod默认不能直接从外部访问,进行端口转发

root@ser745692301841:/dev_dir/k8s# kubectl port-forward pod/nginx-pod 7777:80

Forwarding from 127.0.0.1:7777 -> 80

Forwarding from [::1]:7777 -> 80

root@ser745692301841:/dev_dir/k8s# curl http://127.0.0.1:20030/root@ser745692301841:/dev_dir/k8s# kubectl get pods

NAME READY STATUS RESTARTS AGE

nginx-pod 1/1 Running 0 34s现在有了一个正在运行的Pod,可以看到Pod的名称 nginx-pod,是在 yaml

metadata.name 起的名字。已就绪容器的数量

1/1,输出还显示了Pod的状态、重启次数、Pod年龄。

root@ser745692301841:/dev_dir/k8s# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx-pod 1/1 Running 0 26s 10.244.0.9 kind-control-plane <none> <none>可以选择以 JSON格式 和 YAML格式 输出结果。

kubectl get pods -o json

kubectl get pods -o yaml有更加详细的信息可以使用 kubectl describe

root@ser745692301841:/dev_dir/k8s# kubectl describe pods nginx-pod

Name: nginx-pod

Namespace: default

Priority: 0

Service Account: default

Node: kind-control-plane/172.18.0.2

Start Time: Thu, 12 Mar 2026 14:26:57 +0000

Labels: app=nginx

Annotations: <none>

Status: Running

IP: 10.244.0.9

IPs:

IP: 10.244.0.9

Containers:

nginx:

Container ID: containerd://c1fe99e2feff8ceb8c2c1e32f5af48d9e477735ba3572bae9d8a6de066c36288

Image: nginx:latest

Image ID: docker.io/library/nginx@sha256:bc45d248c4e1d1709321de61566eb2b64d4f0e32765239d66573666be7f13349

Port: 80/TCP

Host Port: 0/TCP

State: Running

Started: Thu, 12 Mar 2026 14:26:58 +0000

Ready: True

Restart Count: 0

Environment: <none>

Mounts:

/var/run/secrets/kubernetes.io/serviceaccount from kube-api-access-96s25 (ro)

Conditions:

Type Status

PodReadyToStartContainers True

Initialized True

Ready True

ContainersReady True

PodScheduled True

Volumes:

kube-api-access-96s25:

Type: Projected (a volume that contains injected data from multiple sources)

TokenExpirationSeconds: 3607

ConfigMapName: kube-root-ca.crt

Optional: false

DownwardAPI: true

QoS Class: BestEffort

Node-Selectors: <none>

Tolerations: node.kubernetes.io/not-ready:NoExecute op=Exists for 300s

node.kubernetes.io/unreachable:NoExecute op=Exists for 300s

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal Scheduled 5m38s default-scheduler Successfully assigned default/nginx-pod to kind-control-plane

Normal Pulling 5m38s kubelet spec.containers{nginx}: Pulling image "nginx:latest"

Normal Pulled 5m37s kubelet spec.containers{nginx}: Successfully pulled image "nginx:latest" in 441ms (441ms including waiting). Image size: 62960551 bytes.

Normal Created 5m37s kubelet spec.containers{nginx}: Container created

Normal Started 5m37s kubelet spec.containers{nginx}: Container started

root@ser745692301841:/dev_dir/k8s# 顶部是Pod的基本信息、Containers部分有Pod中运行的容器信息、还有一些与Pod相关的事件, 何时拉镜像、是否何时因健康检查失败而必须重新启动Pod。

root@ser745692301841:/dev_dir/k8s# kubectl get pods

NAME READY STATUS RESTARTS AGE

nginx-pod 1/1 Running 0 25m

root@ser745692301841:/dev_dir/k8s# kubectl delete pods/nginx-pod

pod "nginx-pod" deleted from default namespace当删除Pod时,Pod不会立即被杀死,如果运行

kubectl get pods 可能会看到 Pod 处于 Terminating 状态。所有

Pod 都有一个终止宽限期,默认为30秒。

当Pod过渡到 Terminating 时,不再接收新请求。删除 Pod 时,存储在与 Pod 相关联的容器中的任何数据也将被删除。 如果要在 Pod 的多个实例中持久保存数据,则需要使用 PersistentVolumes。

root@ser745692301841:/dev_dir/k8s# kubectl logs nginx-pod

/docker-entrypoint.sh: /docker-entrypoint.d/ is not empty, will attempt to perform configuration

/docker-entrypoint.sh: Looking for shell scripts in /docker-entrypoint.d/

/docker-entrypoint.sh: Launching /docker-entrypoint.d/10-listen-on-ipv6-by-default.sh

10-listen-on-ipv6-by-default.sh: info: Getting the checksum of /etc/nginx/conf.d/default.conf

10-listen-on-ipv6-by-default.sh: info: Enabled listen on IPv6 in /etc/nginx/conf.d/default.conf

/docker-entrypoint.sh: Sourcing /docker-entrypoint.d/15-local-resolvers.envsh

/docker-entrypoint.sh: Launching /docker-entrypoint.d/20-envsubst-on-templates.sh

/docker-entrypoint.sh: Launching /docker-entrypoint.d/30-tune-worker-processes.sh

/docker-entrypoint.sh: Configuration complete; ready for start up

2026/03/12 14:55:41 [notice] 1#1: using the "epoll" event method

2026/03/12 14:55:41 [notice] 1#1: nginx/1.29.6

2026/03/12 14:55:41 [notice] 1#1: built by gcc 14.2.0 (Debian 14.2.0-19)

2026/03/12 14:55:41 [notice] 1#1: OS: Linux 6.8.0-90-generic

2026/03/12 14:55:41 [notice] 1#1: getrlimit(RLIMIT_NOFILE): 1073741816:1073741816

2026/03/12 14:55:41 [notice] 1#1: start worker processes

2026/03/12 14:55:41 [notice] 1#1: start worker process 36

2026/03/12 14:55:41 [notice] 1#1: start worker process 37

2026/03/12 14:55:41 [notice] 1#1: start worker process 38

2026/03/12 14:55:41 [notice] 1#1: start worker process 39使用 -f 标志可以使日志流持续不断

root@ser745692301841:/dev_dir/k8s# kubectl logs nginx-pod -f但企业生产环境,一般都用 日志聚合服务,比如 Fluentd 和 Elasticsearch,以及众多云日志提供商。 这些日志服务容量大,可存储更长时间,提供丰富的日志搜索和过滤功能。许多服务还能将 多个Pod 的日志聚合到一个 视图中。

有时仅查看日志是不够的,需要直接在容器的运行环境中执行命令。

root@ser745692301841:/dev_dir/k8s# kubectl exec nginx-pod -- date

Thu Mar 12 15:05:57 UTC 2026如果希望获得一个交互式终端会话,可以加上 -it 参数

root@ser745692301841:/dev_dir/k8s# kubectl exec -it nginx-pod -- sh

# ls

bin docker-entrypoint.d home media proc root srv usr

boot docker-entrypoint.sh lib mnt product_name run sys var

dev etc lib64 opt product_uuid sbin tmp向容器中复制文件其实是一种反模式,更推荐的做法是把容器内存当作不可变的。

kubectl cp 示例

# 复制文件到Pod

kubectl cp local.txt mypod:/app/local.txt

# 从Pod复制出来

kubectl cp mypod:/app/log.txt ./log.txtKubernetes中以容器形式运行应用时,系统会通过进程健康检查自动帮你保持应用存活。

仅检查进程是否存在是不够的,只能检查进程是否存活但程序逻辑有问题也是不健康的,Kubernetes引入了 应用存活检查,会执行一些与应用相关的逻辑,例如

确认,应用不仅还在运行,而且确实能够正常工作。

| 检查类型 | Kubernetes 做什么 | 问题 |

|---|---|---|

| 进程检查 | 只看进程在不在 | 程序卡死也看不出来 |

| Liveness 检查 | 真正访问应用功能 | 能判断应用是否真的还能用 |

存活探针是按容器定义的,Liveness Probe(存活探针),Pod里的每个容器都会单独进行健康检查。

apiVersion: v1

kind: Pod

metadata:

name: kuard

spec:

containers:

- image: gcr.io/kuar-demo/kuard-amd64:blue

name: kuard

livenessProbe:

httpGet:

path: /healthy

port: 8080

initialDelaySeconds: 5

timeoutSeconds: 1

periodSeconds: 10

failureThreshold: 3

ports:

- containerPort: 8080

name: http

protocol: TCP上面yaml内容解释,会对kuard容器的8080端口的 /healthy

接口发送HTTP GET请求。

存活探针失败默认会重启,但实际行为由 Pod 的 restartPolicy 控制,有3种策略

存活检查 liveness 和 就绪检查 readiness 是两个不同概念。

逻辑换为人话:一个负责生死,一个负责接活。

当一个Pod启动时,startup probe 会 在任何其他探针运行之前先执行。

startup probe 会持续执行检查,直到发生以下两种情况之一:

| 阶段 | 负责的探针 | 作用 |

|---|---|---|

| 容器刚启动 | Startup Probe | 判断应用是否完成启动 |

| 启动完成后 | Liveness Probe | 判断应用是否仍然活着 |

说人话:

有效能防止应用还没启动就把它当成死人重启。

出来HTTP检查之外,还支持tcpSocket健康检查,还允许使用exec探针,常见三种套路

大多数人开始使用容器和Kubernetes这样的编排系统,是因为它们在镜像打包和可靠部署方面 带来了巨大的进度。还能提高集群计算节点的整体利用率。

利用率的定义

实际正在使用的资源量 / 已购买的资源总量

Kubernetes的两种资源配置

Resource Requests 资源请求、Resource Limits 资源上限。

资源请求:运行应用所需要的最小资源量,调度器根据这个值决定Pod可以被调度到哪台节点上, 节点是否有足够资源运行这个Pod。requests = 调度保证。

资源上线:应用程序最多可以使用多少资源,如果容器尝试超过这个值的资源,CPU会被限制,内存 可能会被OOM kill。limits = 运行时上限。

Kubernetes资源单位

直接数字 如

12345,millicores(毫核)100m。

| CPU 表达 | 含义 |

|---|---|

1 |

1 个 CPU 核 |

500m |

0.5 CPU |

100m |

0.1 CPU |

内存单位的区别,Kubernetes种有两种不同的单位体系

| 单位 | 类型 | 含义 |

|---|---|---|

| MB / GB / PB | 二进制 | 1 MB = 1024 KB |

| MiB / GiB / PiB | 十进制 | 1 MiB = 1000 KiB |

400m = 0.4MB 而不是 400MB。

当Pod为器容器请求资源时,Kubernetes会保证这些资源在节点上是可用的。

最常见资源:CPU、Memory、GPU。

例如,如果希望 kuard 容器运行在,至少0.5个CPU,128MB内存的机器上

apiVersion: v1

kind: Pod

metadata:

name: kuard

spec:

containers:

- image: gcr.io/kuar-demo/kuard-amd64:blue

name: kuard

resources:

requests:

cpu: "500m"

memory: "128Mi"

ports:

- containerPort: 8080

name: http

protocol: TCP| 配置 | 含义 |

|---|---|

cpu: 500m |

请求 0.5 个 CPU |

memory: 128Mi |

请求 128MB 内存 |

资源是按Container申请的

资源请求是 按容器计算的,不是按Pod。

Pod资源 = 所有容器资源 requests 之和Kubernetes调度器会根据 requests 来决定Pod放在哪个节点。调度规则:节点上所有Pod的 requests总和不能超过节点容量。requests是Kubernetes的调度依据。

requests是最小值,不是最大值。最少保证。

CPU Requests的实现原理,在Linux中通过 cpu-shares 机制实现,本质是按权重公平分配CPU。

Memory Requests的重要区别,内存和CPU有一个关键不同点,CPU可以随时减少,而内存不能随便拿走。 当系统内存不足OOM时,kubelet会 终止那些内存使用大于request的容器,然后自动重启容器。

一句话 “requests = Kubernetes保证给你的最少资源”。生产环境一定要同时设置 requests和limits。

可以通过资源限制设置Pod资源使用的最大值。

kuard-pod-reslim.yaml

apiVersion: v1

kind: Pod

metadata:

name: kuard

spec:

containers:

- image: gcr.io/kuar-demo/kuard-amd64:blue

name: kuard

resources:

requests:

cpu: "500m"

memory: "128Mi"

limits:

cpu: "1000m"

memory: "256Mi"

ports:

- containerPort: 8080

name: http

protocol: TCPCPU会限制,内存超了会OOM。

访问持久磁盘存储是健康应用的重要组成部分。Kubernetes 就是这样的持久性存储模型。

先看配置 kuard-pod-vol.yaml,创建一个叫

kuard-data的volume,它映射的是宿主机目录 /var/lib/kuard

宿主机

/var/lib/kuard

│

▼

容器

/dataapiVersion: v1

kind: Pod

metadata:

name: kuard

spec:

volumes:

- name: "kuard-data"

hostPath:

path: "/var/lib/kuard"

containers:

- image: gcr.io/kuar-demo/kuard-amd64:blue

name: kuard

volumeMounts:

- mountPath: "/data"

name: "kuard-data"

ports:

- containerPort: 8080

name: http

protocol: TCP其中 spec.valumes 数组是Pod内容器可以访问的所有卷。containers.volumeMounts数组定义了挂载到特定容器中的卷以及每个卷 的挂载路径。Pod中的两个不同容器可以在不同的挂载路径上挂载同一个卷。

在应用程序中使用数据有多种方式

| 使用方式 | Volume 类型 | 生命周期 |

|---|---|---|

| 容器通信 | emptyDir | Pod |

| 缓存 | emptyDir | Pod |

| 持久数据 | NFS / 云存储 | 独立于 Pod |

| 访问宿主机 | hostPath | Node |

说人话

容器之间通信同步

两个容器通过共享Volume来协同工作,如

它们共享一个 emptyDir 类型的 Volume。

特点:

缓存数据

有些数据不是必须的,但能提高性能。例如

希望容器重启时缓存仍然存在,但不需要长期保存。emptyDir 也非常适合做缓存:

持久数据

有些数据必须长期保存,并且不依赖Pod声明周期。

要求:Pod重启后仍存在,Pod调度到其他节点时仍可访问。因此 Kubernets支持远程存储器。

| 存储类型 | 说明 |

|---|---|

| NFS | 网络文件系统 |

| iSCSI | 块存储协议 |

| Amazon EBS | AWS 块存储 |

| Azure Disk / Azure File | Azure 存储 |

| Google Persistent Disk | GCP 持久磁盘 |

volumes:

- name: kuard-data

nfs:

server: my.nfs.server.local

path: "/exports"含义:

my.nfs.server.local挂载宿主机文件系统

有些应用需要直接访问节点的文件系统。

/dev把Node上的目录挂载到容器

volumes:

- name: kuard-data

hostPath:

path: /var/lib/kuardhostPath有风险,Pod绑定到某个节点,不可移植,可能影响宿主机安全。

总结机制

apiVersion: v1

kind: Pod

metadata:

name: kuard

spec:

volumes:

- name: kuard-data

nfs:

server: my.nfs.server.local

path: "/exports"

containers:

- name: kuard

image: gcr.io/kuar-demo/kuard-amd64:blue

ports:

- containerPort: 8080

name: http

protocol: TCP

resources:

requests:

cpu: "500m"

memory: "128Mi"

limits:

cpu: "1000m"

memory: "256Mi"

volumeMounts:

- name: kuard-data

mountPath: "/data"

livenessProbe:

httpGet:

path: /healthy

port: 8080

initialDelaySeconds: 5

timeoutSeconds: 1

periodSeconds: 10

failureThreshold: 3

readinessProbe:

httpGet:

path: /ready

port: 8080

initialDelaySeconds: 30

timeoutSeconds: 1

periodSeconds: 10

failureThreshold: 3标签是键值对,可附加到Pod和ReplicaSets、Deployment、Service、Node、Namespace等Kubernetes对象上。标签可以是任意的,有助于为Kubernetes对象附加识别信息。标签是对对象进行分组的基础。

注解提供了一种类似标签的存储机制:键值对旨在保存工具和库可以利用的非识别信息。与标签不同, 注解并不用于查询、过滤或其他方式区分Pod。

| 类型 | 用途 |

|---|---|

| Label | 用来分类、筛选、选择对象 |

| Annotation | 用来存储额外信息 |

说人话:Label(标签)像仓库里给箱子贴的分类标签,Annotation(注解)像箱子上写的备注说明。

它是一个key/value 键值对

key: valueLabel Key 结构

可以分为两个部分,前缀可选,名称必须

[prefix/]nameprefix,必须是DNS子域名,最大长度253个字符,例如

acme.com/

kubernetes.io/

example.org/name规则,key的name部分必须存在,最大63个字符,必须以字母或数字开头结尾,中间允许

- _ .Label Value规则

value也是字符串,限制:最大63个字符、规则和key的name相同

示例Label

| Key | Value |

|---|---|

| acme.com/app-version | 1.0.0 |

| appVersion | 1.0.0 |

| app.version | 1.0.0 |

| kubernetes.io/cluster-service | true |

控制器依赖 label selector,找到带某些标签的一组Pod,然后对它们做点事情。

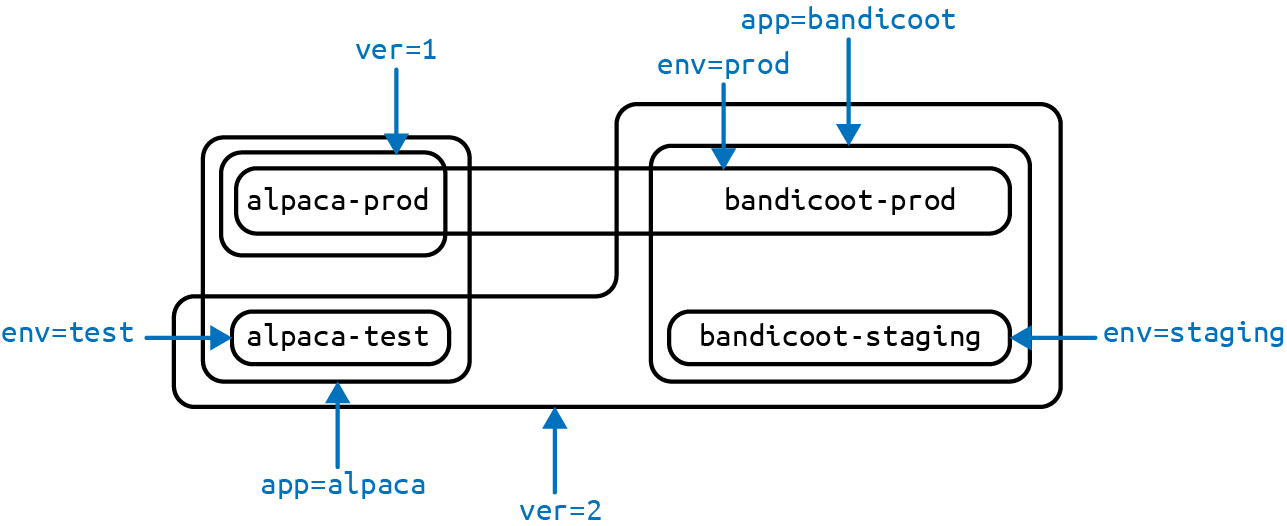

创建几个 Deployment(一种用于创建一组Pod的方式),并为它们添加一些有意思的标签(labels)

创建 alpaca-prod Deployment,并设置 ver、app、env标签。

$ kubectl run alpaca-prod \

--image=gcr.io/kuar-demo/kuard-amd64:blue \

--replicas=2 \

--labels="ver=1,app=alpaca,env=prod"创建 alpaca-test Deployment,并使用对应的值设置 ver、app、env标签。

$ kubectl run alpaca-test \

--image=gcr.io/kuar-demo/kuard-amd64:green \

--replicas=1 \

--labels="ver=2,app=alpaca,env=test"为 bandicoot创建两个 Deployment

$ kubectl run bandicoot-prod \

--image=gcr.io/kuar-demo/kuard-amd64:green \

--replicas=2 \

--labels="ver=2,app=bandicoot,env=prod"

$ kubectl run bandicoot-staging \

--image=gcr.io/kuar-demo/kuard-amd64:green \

--replicas=1 \

--labels="ver=2,app=bandicoot,env=staging"目前,应该有了4个 Deployment

运行查看Deployment

$ kubectl get deployments --show-labels

NAME ... LABELS

alpaca-prod ... app=alpaca,env=prod,ver=1

alpaca-test ... app=alpaca,env=test,ver=2

bandicoot-prod ... app=bandicoot,env=prod,ver=2

bandicoot-staging ... app=bandicoot,env=staging,ver=2

在对象创建之后,也可以给对象添加或更新标签

$ kubectl label deployments alpaca-test "canary=true"注意,这个例子 kubectl label 命令只会修改 Deployment 本身的标签。它不会影响 Deployment 创建的其他对象,例如 ReplicaSet 和 Pod。

可以使用 kubectl get 的 -L

选项,把某个标签的值显示为一列

$ kubectl get deployments -L canary

NAME DESIRED CURRENT ... CANARY

alpaca-prod 2 2 ... <none>

alpaca-test 1 1 ... true

bandicoot-prod 2 2 ... <none>

bandicoot-staging 1 1 ... <none>CANARY列显示的是每个Deployment的canary标签值。

删除标签,可以在标签名后面加一个 -

$ kubectl label deployments alpaca-test "canary-"Label 定义在 Kubernetes 对象的 metadata.labels 字段里。

apiVersion: v1

kind: Pod

metadata:

name: nginx-pod

labels:

app: nginx

env: prod

version: v1

spec:

containers:

- name: nginx

image: nginx:latest标签选择器(Label Selectors)用于根据一组标签来筛选 Kubernetes 对象。

每个Deployment通过ReplicaSet都会创建一组Pods,这些Pods的标签来自Deployment内部模板中定义的labels

$ kubectl get pods --show-labels

NAME ... LABELS

alpaca-prod-3408831585-4nzfb ... app=alpaca,env=prod,ver=1,...

alpaca-prod-3408831585-kga0a ... app=alpaca,env=prod,ver=1,...

alpaca-test-1004512375-3r1m5 ... app=alpaca,env=test,ver=2,...

bandicoot-prod-373860099-0t1gp ... app=bandicoot,env=prod,ver=2,...

bandicoot-prod-373860099-k2wcf ... app=bandicoot,env=prod,ver=2,...

bandicoot-staging-1839769971-3ndv ... app=bandicoot,env=staging,ver=2,...可能会注意,有个标签 pod-template-hash ,这个标签是

Deployment自动添加的,用于记录每个Pod是由 哪个版本的Pod模板生成的。这样

Deployment 在进行 更新(rolling update) 时就可以正确地管理不同版本的

Pods。

使用Selector过滤对象

如果只想查看 ver=2 的Pods,可以使用

--selector

kubectl get pods --selector="ver=2"

NAME READY STATUS RESTARTS AGE

alpaca-test-1004512375-3r1m5 1/1 Running 0 3m

bandicoot-prod-373860099-0t1gp 1/1 Running 0 3m

bandicoot-prod-373860099-k2wcf 1/1 Running 0 3m

bandicoot-staging-1839769971-3ndv5 1/1 Running 0 3m可以指定多个selector 用逗号分隔开,只有同时满足所有条件的对象才会返回。

kubectl get pods --selector="app=bandicoot,ver=2"

NAME READY STATUS RESTARTS AGE

bandicoot-prod-373860099-0t1gp 1/1 Running 0 4m

bandicoot-prod-373860099-k2wcf 1/1 Running 0 4m

bandicoot-staging-1839769971-3ndv5 1/1 Running 0 4m还可以查询,某个标签是否属于一组值中的一个,下面会返回

app=alpaca 或 app=bandicoot 的Pods。

kubectl get pods --selector="app in (alpaca,bandicoot)"

NAME READY STATUS RESTARTS AGE

alpaca-prod-3408831585-4nzfb 1/1 Running 0 6m

alpaca-prod-3408831585-kga0a 1/1 Running 0 6m

alpaca-test-1004512375-3r1m5 1/1 Running 0 6m

bandicoot-prod-373860099-0t1gp 1/1 Running 0 6m

bandicoot-prod-373860099-k2wcf 1/1 Running 0 6m

bandicoot-staging-1839769971-3ndv5 1/1 Running 0 6m可以判断,某个标签是否存在,例如查询所有带 canary 标签的 deployment

kubectl get deployments --selector="canary"

NAME DESIRED CURRENT UP-TO-DATE AVAILABLE AGE

alpaca-test 1 1 1 1 7mSelector 操作符

| 操作符 | 说明 |

|---|---|

key=value |

key 等于 value |

key!=value |

key 不等于 value |

key in (value1,value2) |

key 的值是 value1 或 value2 |

key notin (value1,value2) |

key 的值不是 value1 或 value2 |

key |

key 存在 |

!key |

key 不存在 |

# 查询 ver=2 且 canary标签不存在 的Pod

kubectl get pods -l 'ver=2,!canary'一个Kubernetes对象可以使用 标签选择器 来引用一组其他 Kubernetes 对象。

例如,一个选择器

app=alpaca,ver in (1, 2)在API中会被转换为如下结构

selector:

matchLabels:

app: alpaca

matchExpressions:

- {key: ver, operator: In, values: [1, 2]}!= 运算符 无法直接表示,必须转换为 NotIn

表达式,并且只包含一个值

ver != 1

# 转换

operator: NotIn

values: [1]旧版本选择器语法,只支持 = 运算符。

app=alpaca,ver=1

# YAML表示

selector:

app: alpaca

ver: 1| 选择器类型 | 能力 | 使用场景 |

|---|---|---|

| 旧 selector | 只支持 = |

老 API:ReplicationController、Service |

| 新 selector | 支持 In / NotIn / Exists / DoesNotExist 等 |

Deployment、ReplicaSet 等 |

apiVersion: apps/v1

kind: Deployment

metadata:

name: web

spec:

replicas: 3

selector:

matchLabels:

app: web

template:

metadata:

labels:

app: web

spec:

containers:

- name: nginx

image: nginxDeployment 通过 label selector 找到它管理的Pod。如果selector写错,Deployment 找不到 Pod,集群 就会开始疯狂创建Pod。

Deployment

↓ selector

ReplicaSet

↓ selector

Pods例如更复杂的案例

selector:

matchLabels:

app: payment

matchExpressions:

- key: version

operator: In

values:

- v1

- v2

# 意思是

app = payment

AND

version ∈ {v1, v2}出让用户能阻止自己的基础设施以外,标签(Labels)在连接各种相关的Kubernetes对象方面起着 关键作用。

标签是一种强大且无处不再的“胶水”机制,把Kubernetes应用中的各个组件连接在一起。

Annotations 注解,提供了一种地方,用于为Kubernetes对象存储额外元数据,而这些 元数据的唯一目的是为了辅助工具和库的使用。

Labels用于识别和分组对象,而Annotations则用于提供关于对象的额外信息。

如果不确定,就先把信息存成annotation,如果后来发现需要用它做selector,在把它提升为label。

Annotation的Key规则,和Label完全一样。

Annotation的Value规则,是一个自由格式字符串,可以存任意数据,不会验证其格式。

Annotation的YAML定义,定义在所有Kubernetes对象的metadata部分

metadata:

annotations:

example.com/icon-url: "https://example.com/icon.png"kubectl delete deployments --allLabel = 用来“找对象” Annotation = 用来“记笔记”

| 类型 | 本质作用 | 给谁用 |

|---|---|---|

| Label | 用来 筛选、分组、关联资源 | Kubernetes 自己 + 用户 |

| Annotation | 用来 存储额外信息 | 工具、系统、脚本 |

metadata:

labels:

app: nginx

env: prod

annotations:

prometheus.io/scrape: "true"

scheduler.alpha.kubernetes.io/name: "custom-scheduler"Kubernetes是一个高度动态的系统,系统负责将Pod调度到各个节点上,确保它们正常运行,并在 需要时重新调度它们,还有一些机制可以根据系统负载自动调整 Pod 的数量。

Kubernetes引入了击中解决方案:

“在Kubernetes这种Pod随时可能消失的世界里,应用之间怎么相互找到对方。”

“在Kubernetes这种Pod随时可能消失的世界里,应用之间怎么相互找到对方。”

这类问题和解决方案的统称叫做服务发现 Service Disconvery。

服务发现工具用来解决这样一个问题:如何找到某个服务对应的进程,以及这鞋进程正在监听哪些网络地址。

好的服务发现系统具备以下特点:

DNS 与 服务发现

互联网中,传统的服务发现系统是 Domain Name System(DNS),被设计用于,相对稳定的名称解析,广泛且高效的缓存机制。

但在 动态变化的 Kubernetes 环境中,DNS显得不太合适。

很多系统在解析DNS名称时,会

导致客户端缓存过期的地址映射,客户端可能继续连接到错误的IP地址。

即使设置较短的 TTL Time-To-Live,并且客户端行为良好,也仍然存在一个自然延迟,DNS记录已经改变,客户端却还没意识到。

DNS查询在可返回的信息类型和数量上有天然限制,一个名称对应20-30个IP地址(A记录),系统变得不稳定,当DNS返回多个IP 时,大多数客户端处理方式是,只使用第一个IP,依赖DNS服务器对记录顺序进行随机化或轮询。

在Kubernetes中,真正的服务发现(service disconvery)是从 Service 对象开始的。

下面创建一些 Deployment 和 Service

# 创建Deployment

$ kubectl create deployment alpaca-prod \

--image=gcr.io/kuar-demo/kuard-amd64:blue \

--port=8080

# 扩容Pod数量

$ kubectl scale deployment alpaca-prod --replicas 3

# 创建Service

$ kubectl expose deployment alpaca-prod

# 创建Deployment

$ kubectl create deployment bandicoot-prod \

--image=gcr.io/kuar-demo/kuard-amd64:green \

--port=8080

# 扩容Pod数量

$ kubectl scale deployment bandicoot-prod --replicas 2

# 创建Service

$ kubectl expose deployment bandicoot-prod查看当前 Service

$ kubectl get services -o wide

NAME CLUSTER-IP ... PORT(S) ... SELECTOR

alpaca-prod 10.115.245.13 ... 8080/TCP ... app=alpaca

bandicoot-prod 10.115.242.3 ... 8080/TCP ... app=bandicoot

kubernetes 10.115.240.1 ... 443/TCP ... <none>有三个Service,其中 alpaca-prod 和 bandicoot-prod 是刚才创建的,kubernetes 这个Service是系统自动创建的, 其作用是让集群内部的应用可以找到并访问 Kubernetes API Server。

Service会被分配一个新的虚拟IP,叫做 Cluster IP,Cluster IP是一种特殊的IP地址,系统会使用它对selector匹配到的 所有 Pod 进行负载均衡。

Service (ClusterIP)

│

▼

Pod1 Pod2 Pod3Service 本质

Service ≈ 名字 + label selector + 负载均衡 + 虚拟IP它解决的问题只有一个,Pod IP会变,但 Service IP永远不变。

# Deployment创建Pod

Deployment

│

▼

ReplicaSet

│

▼

Pods (3个)

# Service 发现Pod

# Service 不会创建Pod,只是找到Pod

Service

│

selector

│

▼

Pods由于 Cluster IP是虚拟IP,是稳定的,适合为它分配一个DNS地址。

在同一命名空间内,只需要使用Service名称,就可以连接到该Service所标识的一组Pod中的某一个。

Kubernetes为运行在集群中的Pod提供了DNS服务,这个DNS服务在创建集群时作为系统组件安装。

Kubernetes 的 DNS 服务会为 Cluster IP 提供 DNS 名称解析。

如 Service alpaca-prod 的DNS完整名称是:

alpaca-prod.default.svc.cluster.local.Kubernetes做了非常使用的事

| 功能 | 作用 |

|---|---|

| Service | 提供稳定的虚拟 IP |

| DNS | 给 Service 提供稳定域名 |

| Pod | 可以直接用域名访问 Service |

Pod之间通信变成了

curl http://service-name一个应用在刚启动时不能立即处理请求,一般都会有初始化过程。

Kubernetes的Service对象有一个实用功能,可以通过 readiness check(就绪检查),来跟踪哪些Pod 已经准备好接收流量。

可以修改 deployment,为Pod添加一个 readiness check

$ kubectl edit deployment/alpaca-prod添加以下配置

spec:

...

template:

...

spec:

containers:

...

name: alpaca-prod

readinessProbe:

httpGet:

path: /ready

port: 8080

periodSeconds: 2

initialDelaySeconds: 0

failureThreshold: 3

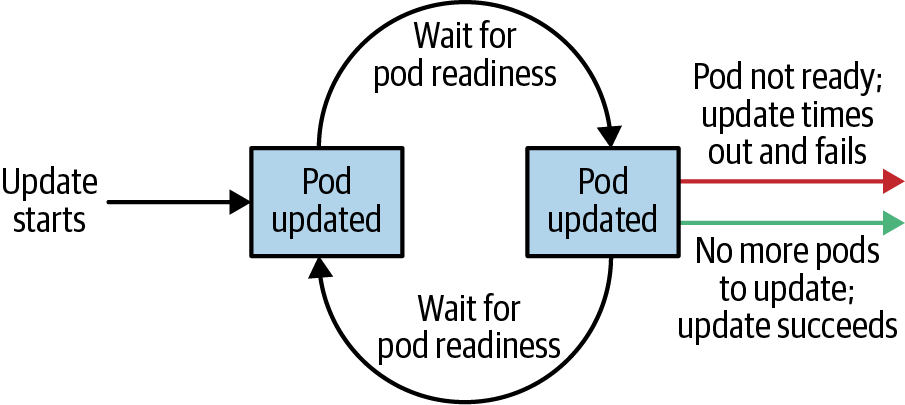

successThreshold: 1Deployment更新后的行为,当更新deployment配置后,现有的 alpaca Pod会被删除并重建。

观察Service的Endpoints

$ kubectl get endpoints alpaca-prod --watchEndpoints是一种更底层的机制,用于查看Service实际把流量发给哪些Pod。

目前,本章讨论的内容都是关于在Kubernetes集群内部保留服务,很多时候,Pod的IP地址只能在集群内访问。

实现新的流量从外部流入,最通用最可移植的方法是 NodePort 的功能,进一步增强Service的能力。

kubectl edit service alpaca-prod

# 把sepc.type字段改成NodePort

# 在创建Service时也可以直接指定,系统随后会为该 Service 分配一个新的 NodePort

kubectl expose --type=NodePort查看Service信息

kubectl describe service alpaca-prod

Name: alpaca-prod

Namespace: default

Labels: app=alpaca

Annotations: <none>

Selector: app=alpaca

Type: NodePort

IP: 10.115.245.13

Port: <unset> 8080/TCP

NodePort: <unset> 32711/TCP

Endpoints: 10.112.1.66:8080,10.112.2.104:8080,10.112.2.105:8080

Session Affinity: None

No events.系统为该 Service 分配了 32711 端口。现在可以通过任意一个集群节点的IP + 这个端口访问该服务。

如果你和集群节点在同一个网络中,可以访问

http://<node-ip>:32711如果集群部署在云上,可以通过SSH隧道访问,例如

ssh <node> -L 8080:localhost:32711然后在浏览器访问,就会连接到该Service

http://localhost:8080负载均衡行为,每次发送请求时,请求都会被随机转发到实现该 Service 的某一个Pod。

NodePort本质

外部请求

↓

NodeIP:NodePort

↓

Service

↓

随机转发

↓

Pods所以访问路径其实是:

浏览器 → NodeIP:32711 → Service → PodLoadBalancer是在NodePort类型的基础上构建的,它会额外让云平台创建一个新的负载均衡器, 并把流量转发到集群中的节点。

修改 alpaca-prod Service

kubectl edit service alpaca-prod

# 把 sepc.type 修改为 LoadBalancer创建 LoadBalancer类型的Service会把这个服务暴露到公共互联网。

立即执行

kubectl get services

# 会看到 alpaca-prod的EXTERNAL-IP显示<pending>一会,云平台会分配一个公网地址$ kubectl describe service alpaca-prod

Name: alpaca-prod

Namespace: default

Labels: app=alpaca

Selector: app=alpaca

Type: LoadBalancer

IP: 10.115.245.13

LoadBalancer Ingress: 104.196.248.204

Port: <unset> 8080/TCP

NodePort: <unset> 32711/TCP

Endpoints: 10.112.1.66:8080,10.112.2.104:8080,10.112.2.105:8080

Session Affinity: None

Events:

FirstSeen ... Reason Message

--------- ... ------ -------

3m ... Type NodePort -> LoadBalancer

3m ... CreatingLoadBalancer Creating load balancer

2m ... CreatedLoadBalancer Created load balancer上面例子是 Google Cloud Platform的GKE创建和管理的集群,不同云平台创建负载均衡器的方式是不同的。

上面的例子是 外部负载均衡器(External Load Balancer)连接到公共互联网的负载均衡器,这种方式适合把服务暴露给全世界。

很多情况希望,在私有网络内部访问应用程序,可以使用 内部负载均衡器(Internal Load Balancer)

通常通过 Service Annotation 对象注解来配置。

在 Azure Kubernetes Service (AKS) 中创建内部负载均衡器,需要添加 annotation:

service.beta.kubernetes.io/azure-load-balancer-internal: "true"Amazon Web Services

service.beta.kubernetes.io/aws-load-balancer-internal: "true"Alibaba Cloud

service.beta.kubernetes.io/alibaba-cloud-loadbalancer-address-type: "intranet"Google Cloud Platform

cloud.google.com/load-balancer-type: "Internal"当你给 Service 添加这个 annotation 时,配置会像这样:

...

metadata:

...

name: some-service

annotations:

service.beta.kubernetes.io/azure-load-balancer-internal: "true"

...创建带有这些 annotation 的 Service 后:系统会创建一个仅在内部网络可访问的负载均衡器,而不是暴露到公网。

有些程序希望在不适用 Cluster IP的情况下使用服务,为此,Kubernetes 提供了另一种对象类型,叫做 Endpoints 对象。

对于每一个 Service 对象,Kubernetes 都会自动创建一个对应的 Endpoints 对象,其中包含该服务所对应的 IP 地址列表:

$ kubectl describe endpoints alpaca-prod

Name: alpaca-prod

Namespace: default

Labels: app=alpaca

Subsets:

Addresses: 10.112.1.54,10.112.2.84,10.112.2.85

NotReadyAddresses: <none>

Ports:

Name Port Protocol

---- ---- --------

<unset> 8080 TCP

No events.要使用某个服务,一个更高级的应用程序可以直接与 Kubernetes API 交互,查询这些 endpoints,然后直接调用它们。

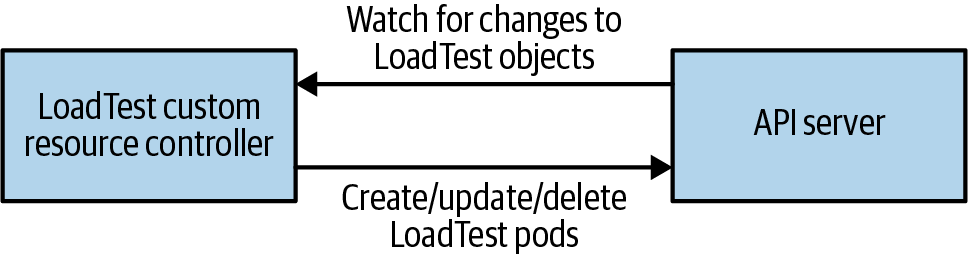

Kubernetes API 甚至支持一种叫做 “watch(监听)” 的能力,可以在对象发生变化时立即收到通知。

这样一来,当与某个服务关联的 IP 地址发生变化时,客户端可以立刻做出响应。

示例

一个终端窗口中运行以下命令,并保持它持续运行

$ kubectl get endpoints alpaca-prod --watch它会输出当前的endpoint状态,然后命令会挂起等待变化

NAME ENDPOINTS AGE

alpaca-prod 10.112.1.54:8080,10.112.2.84:8080,10.112.2.85:8080 1m打开其他终端,删除并重建 alpaca-prod 提供服务的Deployment

$ kubectl delete deployment alpaca-prod

$ kubectl create deployment alpaca-prod \

--image=gcr.io/kuar-demo/kuard-amd64:blue \

--port=8080

$ kubectl scale deployment alpaca-prod --replicas=3随着这些Pods被删除并重新创建,命令观察endpoints输出中的IP地址列表会实时更新

NAME ENDPOINTS AGE

alpaca-prod 10.112.1.54:8080,10.112.2.84:8080,10.112.2.85:8080 1m

alpaca-prod 10.112.1.54:8080,10.112.2.84:8080 1m

alpaca-prod <none> 1m

alpaca-prod 10.112.2.90:8080 1m

alpaca-prod 10.112.1.57:8080,10.112.2.90:8080 1m

alpaca-prod 10.112.0.28:8080,10.112.1.57:8080,10.112.2.90:8080 1m核心思想总结:

Kubernetes 的 Service 是建立在对Pod的标签选择器之上的。

使完全不使用 Service 对象,你也可以通过 Kubernetes API 实现一种最基础的服务发现机制。

$ kubectl get pods -o wide --show-labels

NAME ... IP ... LABELS

alpaca-prod-12334-87f8h ... 10.112.1.54 ... app=alpaca

alpaca-prod-12334-jssmh ... 10.112.2.84 ... app=alpaca

alpaca-prod-12334-tjp56 ... 10.112.2.85 ... app=alpaca

bandicoot-prod-5678-sbxzl ... 10.112.1.55 ... app=bandicoot

bandicoot-prod-5678-x0dh8 ... 10.112.2.86 ... app=bandicoot只查看alpaca应用的Pod

$ kubectl get pods -o wide --selector=app=alpaca

# 输出示例

NAME ... IP ...

alpaca-prod-3408831585-bpzdz ... 10.112.1.54 ...

alpaca-prod-3408831585-kncwt ... 10.112.2.84 ...

alpaca-prod-3408831585-l9fsq ... 10.112.2.85 ...到这,已经具备最基本的服务发现能力

现实很快会给你一巴掌。因为维护正确的 label 集合并让客户端同步使用它们其实很麻烦。 这正是 Service 对象被设计出来的原因。

手动服务发现

Label → 找 Pod → 拿 IPService的作用把这套流程自动化

Service

↓

自动根据 label 找 Pod

↓

提供稳定的访问入口 (ClusterIP / DNS)Cluster IP是一种稳定的虚拟IP地址,会把流量负载均衡到某个Servce的所有Endpoints(后端Pod)上。

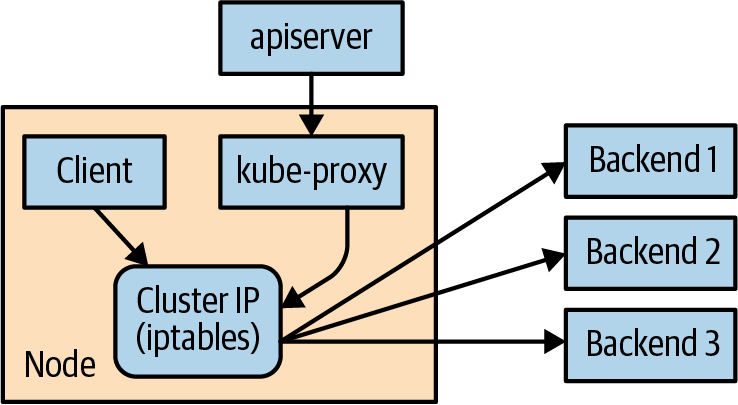

这种“魔法”由运行在集群每个节点上的组件 kube-proxy 完成的。

kube-proxy 会通过 API Server 持续监听集群中新创建的Service。 一旦发现新Service,就在该节点Linux内核中配置一组 iptables 规则, 这些规则会重写数据包的目标地址,从而把请求转发到Service的某一个Endpoint。

如果某个 Service 的 Endpoints 发生变化

那么对应的 iptables 规则也会被重新写入和更新。

Cluster IP 的分配,是在 Service 创建时由 API Server 自动分配的。但也能用户手动指定一个 Cluster IP,一旦cluster IP 被设置,就不能再修改。

想修改,只能

Kubernetes 的 Service IP 地址范围是通过 kube-apiserver

启动参数配置的:

--service-cluster-ip-range这个地址范围必须满足几个条件:

--service-cluster-ip-range 指定的范围,不能已经被其他

Service 使用虽然大多数用户应该用DNS服务来查找Cluster IP,仍存在一些较旧的及其被使用,一种方法是 再Pod启动时向其注入一组环境变量。

不要用,不要用,知道就好了。

虽然在 Kubernetes 集群内部拥有服务发现功能非常方便,但在现实世界中,很多应用实际上需要把 部署在 Kubernetes 中的云原生应用 与 部署在传统(legacy)环境中的应用 进行集成。

Kubernetes 解决了 集群内部通信,但 跨环境通信(cloud ↔︎ on-prem ↔︎ legacy) 依然是工程师每天头疼的地方。

后来出来一堆东西:

都在解决一个问题:不同环境里的服务怎么优雅地互相说话。

需要让 Kubernetes 访问集群外部的旧系统(legacy resources) 时,可以使用一种叫做 无 selector 的 Service(selector-less service) 的方式。

允许你声明一个 Kubernetes Service,并为它 手动指定一个位于集群外部的 IP 地址。这样做的好处是:

创建无selector的Service

删除 sepc.selector 字段,但保留 metadata 和 ports

配置。

因为这个Service没有selector,Kubernetes不会自动创建 Endpoints,所以你必须手动创建 Endpoints。

手动添加Endpoints

通常情况下,你添加的 endpoint 会是一个固定 IP,例如:

因为 IP 通常不会变,所以一般只需要添加一次。但如果 IP 地址发生变化,你就必须 更新对应的 Endpoints 资源。

创建Endpoints示例

可以创建或更新一个 Endpoints 资源,例如:

apiVersion: v1

kind: Endpoints

metadata:

# 这个名字必须和 Service 的名字完全一致

name: my-database-server

subsets:

- addresses:

# 把这个 IP 替换成你的真实服务器 IP

- ip: 1.2.3.4

ports:

# 替换为你需要暴露的端口

- port: 1433这套机制的实际效果:

假设有 service my-database-server

Pod访问

my-database-server.default.svc.cluster.localDNS 解析没问题,但流量实际上走的是:

Pod -> Service -> Endpoint -> 1.2.3.4:1433

Kubernetes Pod

↓

Kubernetes Service

↓

手动 Endpoints

↓

外部数据库服务器将外部资源连接到 Kubernetes 集群内部的服务会稍微复杂一些。

如果你的云服务提供商支持,最简单的方法是创建一个“内部(internal)负载均衡器”。正如前面介绍的那样,这种负载均衡器运行在你的虚拟私有网络(VPC)中,并可以通过一个固定 IP 地址 把流量转发到 Kubernetes 集群内部。

如果没有内部负载均衡器可用,你可以使用 NodePort Service,把服务暴露到集群节点的 IP 地址上。

接下来有两种方式可以把流量分发到这些节点:

如果以上两种方案都不适合你的场景,还可以使用更复杂的方案,例如:

在外部资源机器上运行完整的 kube-proxy,并配置该机器使用 Kubernetes 集群内部的 DNS 服务器。

不过这种方案非常难正确配置,因此通常只建议在 本地部署(on-premise)环境中使用。

外部系统访问 Kubernetes 服务的常见方案,从简单到复杂:

删除 label 有 app的service与deployment

$ kubectl delete services,deployments -l appService 解决“服务在哪”

Ingress是英语单词,意思 进入、入口、进入的通道。反义词是 Egress 出口、离开。Ingress 就是“进入集群的流量入口规则”。

任何应用的一个关键部分都是让网络流量进出该应用程序,Kubernetes有一套功能,可以让服务暴露在集群之外。

Service对象工作在OSI模型的第四层 L4,意味着它只能转发 TCP 和 UDP连接,不会查看这些连接的内部内容。

| 层级 | 名称 | 主要作用 | 常见协议 / 技术 |

|---|---|---|---|

| 7 | 应用层(Application) | 给应用程序提供网络服务 | HTTP、HTTPS、FTP、SMTP、DNS |

| 6 | 表示层(Presentation) | 数据格式转换、加密、压缩 | TLS/SSL、JPEG、MPEG |

| 5 | 会话层(Session) | 建立、管理、终止会话连接 | NetBIOS、RPC |

| 4 | 传输层(Transport) | 端到端传输、可靠性控制 | TCP、UDP |

| 3 | 网络层(Network) | 路由选择、IP寻址 | IP、ICMP、IPsec |

| 2 | 数据链路层(Data Link) | MAC地址、帧传输、差错检测 | Ethernet、PPP |

| 1 | 物理层(Physical) | 比特流传输,电信号 | 网线、光纤、无线电 |

以前,在单个IP地址上托管多个HTTP网站,通常做法是使用负载均衡器或反向代理来接受HTTP(80端口)和 HTTPS(443)的入站连接。

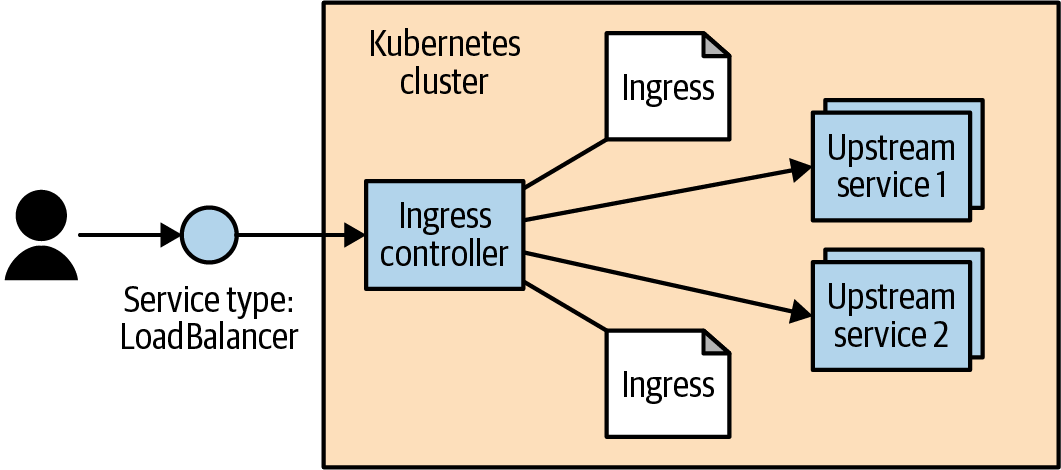

Kubernetes 将其基于 HTTP 的负载均衡系统统称为 Ingress。

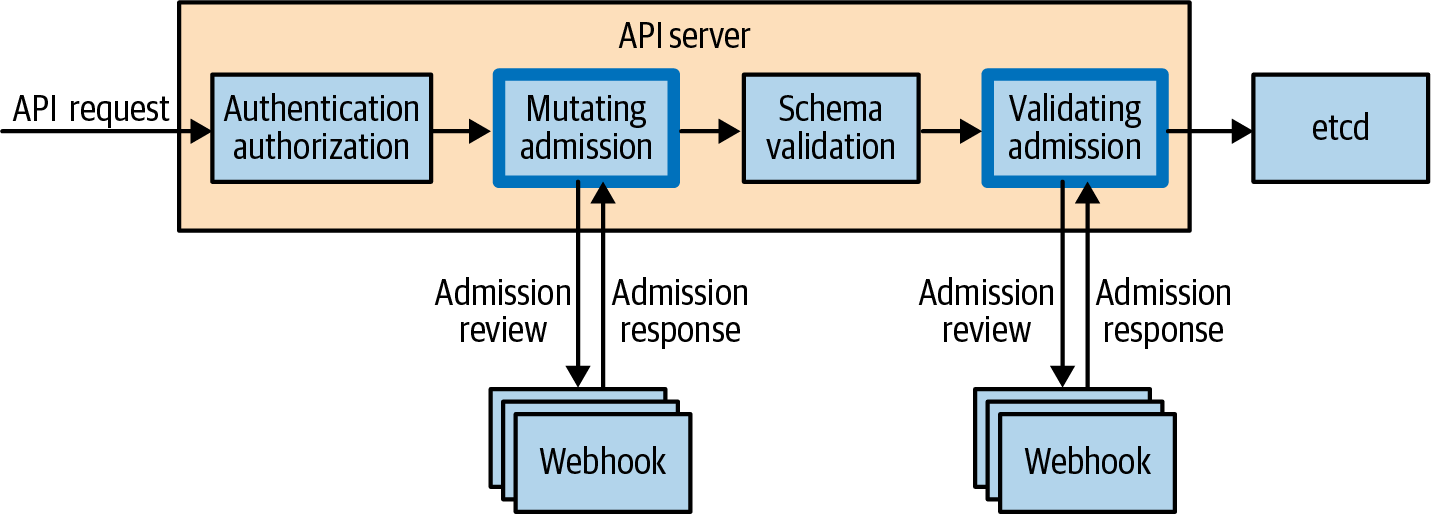

Ingress控制器由两部分组成:

Ingress被拆分为两部分:通用资源规范(Ingress Spec)和 控制器实现(Ingress Controllers)。

Kubernetes本身并不内置“标准”Ingress控制器,用户必须自行安装众多可选实现之一。

Contour 是一个用于配置开源负载均衡器 Envoy(CNCF 项目)的控制器。Envoy 是通过 API 动态配置的。Contour Ingress 控制器负责将 Ingress 对象转换为 Envoy 能理解的配置。

https://github.com/projectcontour/contour

# 这条命令需要由具有 cluster-admin 权限的用户执行

$ kubectl apply -f https://projectcontour.io/quickstart/contour.yaml它会创建一个名为 projectcontour 的命名空间,在该命名空间内,会创建一个Deployment(副本数为2)以及一个面向 外部的LoadBalancer类型的Service。

它会通过服务账户设置正确的权限,并安装一个 CustomResourceDefinition。

安装完成后,可以通过以下命令获取 Contour 的外部地址:

$ kubectl get -n projectcontour service envoy -o wide

NAME CLUSTER-IP EXTERNAL-IP PORT(S) ...

contour 10.106.53.14 a477...amazonaws.com 80:30274/TCP ...查看 EXTERNAl-IP 列,可以是IP地址(在GCP或Azure上) 或

主机名(AWS上)。

如果你的Kubernetes集群不支持LoadBalancer类型的Service,需要修改Contour安装YAML,将Service类型改为NodePort, 并通过适合你环境的方式将流量路由到集群内的节点。

如果使用 minikube,通常 EXTERNAL-IP

不会显示任何值,解决方法是在另一个终端执行

minikube tunnel这会配置网络路由,使每个 LoadBalancer 类型的 Service 都能分配到唯一的 IP 地址。

为了让 Ingress 正常工作,你需要将 DNS 条目指向负载均衡器的外部地址。

ExternalDNS 项目是一个可以帮你管理 DNS 记录的集群附加组件。ExternalDNS 会监控你的 Kubernetes 集群,并将 Kubernetes Service 资源的 IP 地址同步到外部 DNS 提供商。ExternalDNS 支持多种 DNS 提供商,包括传统域名注册商以及公共云服务提供商。

也就是让集群的Ingress EXTERNAL-IP

同步到自己的域名商DNS解析去。

https://github.com/kubernetes-sigs/external-dns

如果你没有域名,正在使用像minikube这样的本地解决方案,可以通过

/etc/hosts 文件进行本地配置

启动 ip-address 就是 Contour的 EXTERNAL-IP

外部IP地址。

<ip-address> alpaca.example.com bandicoot.example.com配置好了 Ingress 控制器,首先创建几个上游服务进行试验

# 创建deployment

$ kubectl create deployment be-default \

--image=gcr.io/kuar-demo/kuard-amd64:blue \

--replicas=3 \

--port=8080

# 为deployment暴露service

$ kubectl expose deployment be-default

$ kubectl create deployment alpaca \

--image=gcr.io/kuar-demo/kuard-amd64:green \

--replicas=3 \

--port=8080

$ kubectl expose deployment alpaca

$ kubectl create deployment bandicoot \

--image=gcr.io/kuar-demo/kuard-amd64:purple \

--replicas=3 \

--port=8080

$ kubectl expose deployment bandicoot

$ kubectl get services -o wide有以下Service列表,每个Deployment都对应一个Service,Ingress将用这些服务来路由外部流量。

| NAME | CLUSTER-IP | PORT(S) | SELECTOR |

|---|---|---|---|

| alpaca | 10.115.245.13 | 8080/TCP | run=alpaca |

| bandicoot | 10.115.242.3 | 8080/TCP | run=bandicoot |

| be-default | 10.115.246.6 | 8080/TCP | run=be-default |

| kubernetes | 10.115.240.1 | 443/TCP |

Ingress最简单的用法是将它看到的所有请求“原样”转发到上游服务器。

simple-ingress.yaml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: simple-ingress

spec:

defaultBackend:

service:

name: alpaca

port:

number: 8080可以使用 kubectl apply 创建这个 Ingress

$ kubectl apply -f simple-ingress.yaml

ingress.extensions/simple-ingress created

$ kubectl get ingress

NAME HOSTS ADDRESS PORTS AGE

simple-ingress * 80 13m

$ kubectl describe ingress simple-ingress

Name: simple-ingress

Namespace: default

Address:

Default backend: alpaca:8080

(172.17.0.6:8080,172.17.0.7:8080,172.17.0.8:8080)

Rules:

Host Path Backends

---- ---- --------

* * alpaca:8080 (172.17.0.6:8080,172.17.0.7:8080,172.17.0.8:8080)

Annotations:

...

Events: <none>这就意味着,任何访问 Ingress 控制器的HTTP请求都会转发到 alpaca 服务,此时, 可以通过服务的任意原始IP或CNAME访问alpaca实例。

在这一阶段,这种配置相比直接使用 type: LoadBalancer

的服务并没有太大优势。

当根据请求的属性来引导流量时,最常见的例子是让Ingress系统查看HTTP的Host头,并根据该头来引导流量。

再创建一个Ingresss

host-ingress.yaml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: host-ingress

spec:

defaultBackend:

service:

name: be-default

port:

number: 8080

rules:

- host: alpaca.example.com

http:

paths:

- pathType: Prefix

path: /

backend:

service:

name: alpaca

port:

number: 8080alpaca.example.comhttp.paths: 匹配请求路径

pathType: Prefix: 前缀匹配,标识请求路径以

/ 开头的都会匹配path: /: 匹配的路径前缀backend.service.name: 匹配到这个 host + path

的请求会转发到名为 alpaca 的Servicebackend.service.port.number: 服务端口号,8080kubectl apply 创建这个 Ingress。

$ kubectl apply -f host-ingress.yaml

ingress.extensions/host-ingress created

$ kubectl get ingress

NAME HOSTS ADDRESS PORTS AGE

host-ingress alpaca.example.com 80 54s

simple-ingress * 80 13m

$ kubectl describe ingress host-ingress

Name: host-ingress

Namespace: default

Address:

Default backend: be-default:8080 (<none>)

Rules:

Host Path Backends

---- ---- --------

alpaca.example.com

/ alpaca:8080 (<none>)

Annotations:

...

Events: <none>不仅根据主机名,还根据HTTP请求中的路径来引导流量。

例如,将所有进入 http://bandicoot.example.com

的流量引导到 bandicoot 服务,但将

http://bandicoot.example.com/a 的流量引导到 alpaca

服务。这种场景可以在单个域的不同路径上托管多个服务。

path-ingress.yaml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: path-ingress

spec:

rules:

- host: bandicoot.example.com

http:

paths:

- pathType: Prefix

path: "/"

backend:

service:

name: bandicoot

port:

number: 8080

- pathType: Prefix

path: "/a/"

backend:

service:

name: alpaca

port:

number: 8080上面例子,以 /a/ 开头的流量会转发到 alpaca 服务,其他以

/ 开头的流量会被转发到 bandicoot 服务。

当请求被代理到上游服务时,路径保持不变。

$ kubectl delete ingress host-ingress path-ingress simple-ingress

$ kubectl delete service alpaca bandicoot be-default

$ kubectl delete deployment alpaca bandicoot be-default存在多种Kubernetes Ingress控制器实现,而且在同一个集群中运行多个Ingress控制器也是常见需求。

为了解决这种情况,引入了 IngressClass 资源,当创建 Ingress 资源时,可以通过字段

sepc.ingressClassName指定使用哪一个 IngressClass。

Kubernetes 1.18之前,IngressClassName 字段并不存在,使用 annotation 来指定控制器

kubernetes.io/ingress.class如果Ingress资源中没设置 spec.ingressClassName 则会使用 默认的 Ingress 控制器。默认控制器的 指定方式是在 对应的 IngressClass 资源上添加 annotation

ingressclass.kubernetes.io/is-default-class比如,集群里同时跑

可以这样选择

spec:

ingressClassName: nginx或者

spec:

ingressClassName: traefik这样不同的 Ingress 规则就会被不同控制器处理。

说人话,“多个Ingress controller 抢活干,所以Kubernetes给它们发了工作标签”

如果定义了多个Ingress对象,Ingress控制器通常会读取所有这些对象,并尝试把它们合并成一个一致的配置。

如果你在这些 Ingress 对象中定义了重复或互相冲突的配置,那么系统的行为就是未定义的。

“多个Ingress可以一起使用,但别写冲突配置,否则结果看运气。”